OpenAI本周四向所有登录网页端的ChatGPT用户推送了“对话分支”功能——这一被用户呼吁多年的更新,不仅解决了线性对话的效率痛点,更以直观的形式提醒我们:AI聊天机器人并非拥有固定立场的“人”,而是可回溯、可多向引导的灵活工具。

什么是对话分支功能?怎么用?

简单来说,对话分支功能允许用户在不破坏原始对话的前提下,从任意聊天节点衍生出全新的并行对话线程,本质是“基于历史上下文的多路径探索”。

1. 核心操作流程

使用步骤非常简洁,无需复杂设置:

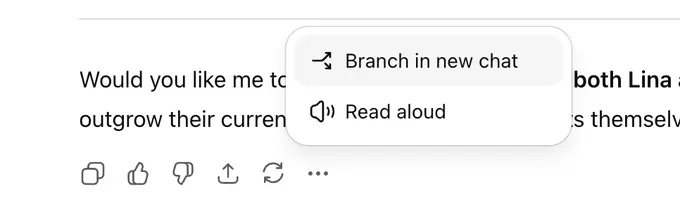

- 打开ChatGPT网页端的任意对话,将鼠标悬停在你想“分支”的某条消息上;

- 点击弹出的“更多操作”选项,选择“在新聊天中分支”;

- 系统会自动创建一个新对话——该对话包含原始聊天截至分支点的所有上下文,但后续操作不会影响原始线程。

2. 形象类比:像“复制文档”一样管理对话

这个功能可以类比为“文档编辑”:原始对话是“初稿”,分支对话是“修改稿”——你可以在修改稿中自由调整内容,同时保留初稿的完整性。

例如:

- 营销团队头脑风暴时,可从“产品卖点梳理”节点分支,分别测试“正式商务”“年轻幽默”“极简直白”三种文案风格;

- 学生写论文时,能从“文献综述”节点衍生出“侧重理论分析”和“侧重案例论证”两条思路,无需反复删除或复制内容。

为什么需要对话分支?解决了哪些老问题?

在此之前,ChatGPT的线性对话模式存在明显局限:若想尝试不同思路,要么修改历史提示(覆盖原有对话),要么重新开启新聊天(重复输入上下文)。而对话分支功能的推出,精准击中了效率与体验的核心痛点。

1. 降低认知负担,提升多任务效率

清华大学与北京理工大学2024年的联合研究指出:线性对话界面在“头脑风暴、结构化知识学习、大项目分析”等复杂场景中存在明显不足——用户需反复比较、复制历史内容,不仅增加操作成本,更会分散注意力、降低思考效率。

对话分支则通过“并行线程”解决了这一问题:所有思路基于同一上下文衍生,无需重复铺垫,用户可专注于内容本身的迭代。

2. 适配“工具属性”,支持“如果式”探索

与人类对话不同,AI聊天机器人的核心价值在于“可试错、可多向输出”。对话分支功能让这种价值落地:你可以轻松探索“如果换一种提问方式,答案会如何变化”“如果补充这个条件,分析角度是否不同”等场景,而不必担心破坏已有成果。

3. 行业内的“查漏补缺”:并非全新创新

值得注意的是,对话分支并非OpenAI首创。Anthropic的Claude已上线该功能超过一年,用户可通过导航箭头在不同分支间快速切换。此次ChatGPT跟进,更多是对用户核心需求的回应,也是AI产品界面设计的“同质化优化”。

功能背后的关键提醒:别把AI当“人”,要当“工具”用

OpenAI在推送功能时,并未强调“技术突破”,而是通过产品设计传递了一个核心认知:AI聊天机器人的“类人感”是模拟出来的,其本质是可调度的工具,而非有固定立场的对话者。

1. 警惕“拟人化陷阱”:别被“个性”迷惑

如今许多用户会下意识地与ChatGPT“对话”——询问它的“意见”、将回答视为“权威结论”,甚至对其产生情感依赖。这种拟人化认知会限制AI的价值:它本可以提供10种思路,你却只接受了最“像人”的那一种。

正如行业共识所言:AI的“个性”是提示词与训练数据的结合体,并非固定属性。你需要的不是“咨询一个有立场的对象”,而是“调度一个能多向输出的工具”。

2. 对话分支是“多视角探索”的最佳载体

AI输出的权威性并非“与生俱来”,而是由用户的提示词引导、训练数据支撑的。对话分支功能恰好为“多视角探索”提供了载体:

- 写方案时,可分支测试“成本导向”“效果导向”“风险导向”三种论证逻辑;

- 学知识时,能从“基础概念”节点衍生出“案例解释”“公式推导”“应用场景”三条学习路径。

这种探索方式,才是AI作为“增强人类能力工具”的核心价值所在。

3. 工具再好用,也要警惕“固有缺陷”

需要明确的是,对话分支功能仅优化了“交互体验”,并未解决AI的本质局限:在数据覆盖不足的领域,ChatGPT仍可能“编造信息”;在专业度较高的场景,其输出仍需人工校验。因此,无论用何种分支探索,最终决策仍需依赖人类的判断与验证。

行业类比:像Git一样管理AI对话

不少开发者将ChatGPT的对话分支功能与代码版本控制系统Git相提并论——两者逻辑高度相似:

- Git允许程序员创建“代码分支”,测试修改后再合并到主分支,避免影响核心代码;

- ChatGPT的对话分支则允许用户在“副线程”中测试思路,成熟后再应用到主对话,保留原始上下文。

这种类比也再次印证了AI的“工具属性”:它和代码编辑器、文档软件一样,是辅助人类高效完成工作的“生产力工具”,而非需要“平等对话”的对象。

相关文章