来自特拉维夫大学和赖希曼大学的研究团队推出B-LoRA(Block Low-Rank Adaptation),它能够将单张图片中的风格和内容分离,从而实现高质量的图像风格化处理。图像风格化是指在保持图片原有对象、结构和概念(内容)的基础上,改变其视觉外观和纹理(风格)的过程。

- 项目主页:https://b-lora.github.io/B-LoRA

- GitHub:https://github.com/yardenfren1996/B-LoRA

- DEMO:https://huggingface.co/spaces/Yardenfren/B-LoRA

- ComfyUI插件:https://github.com/liusida/ComfyUI-B-LoRA

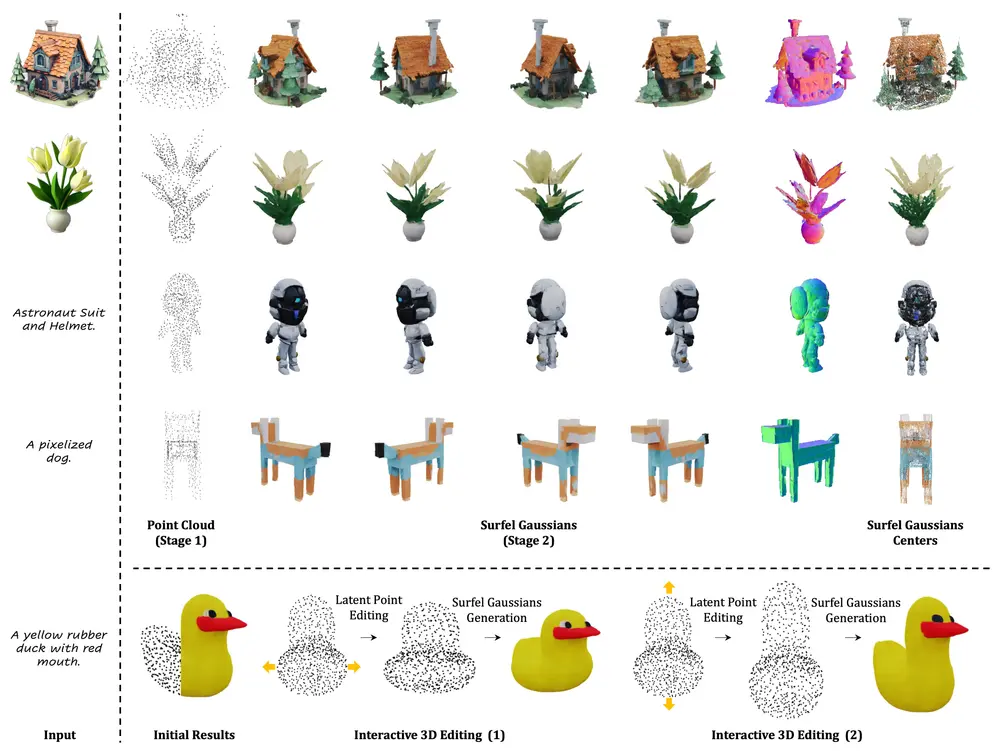

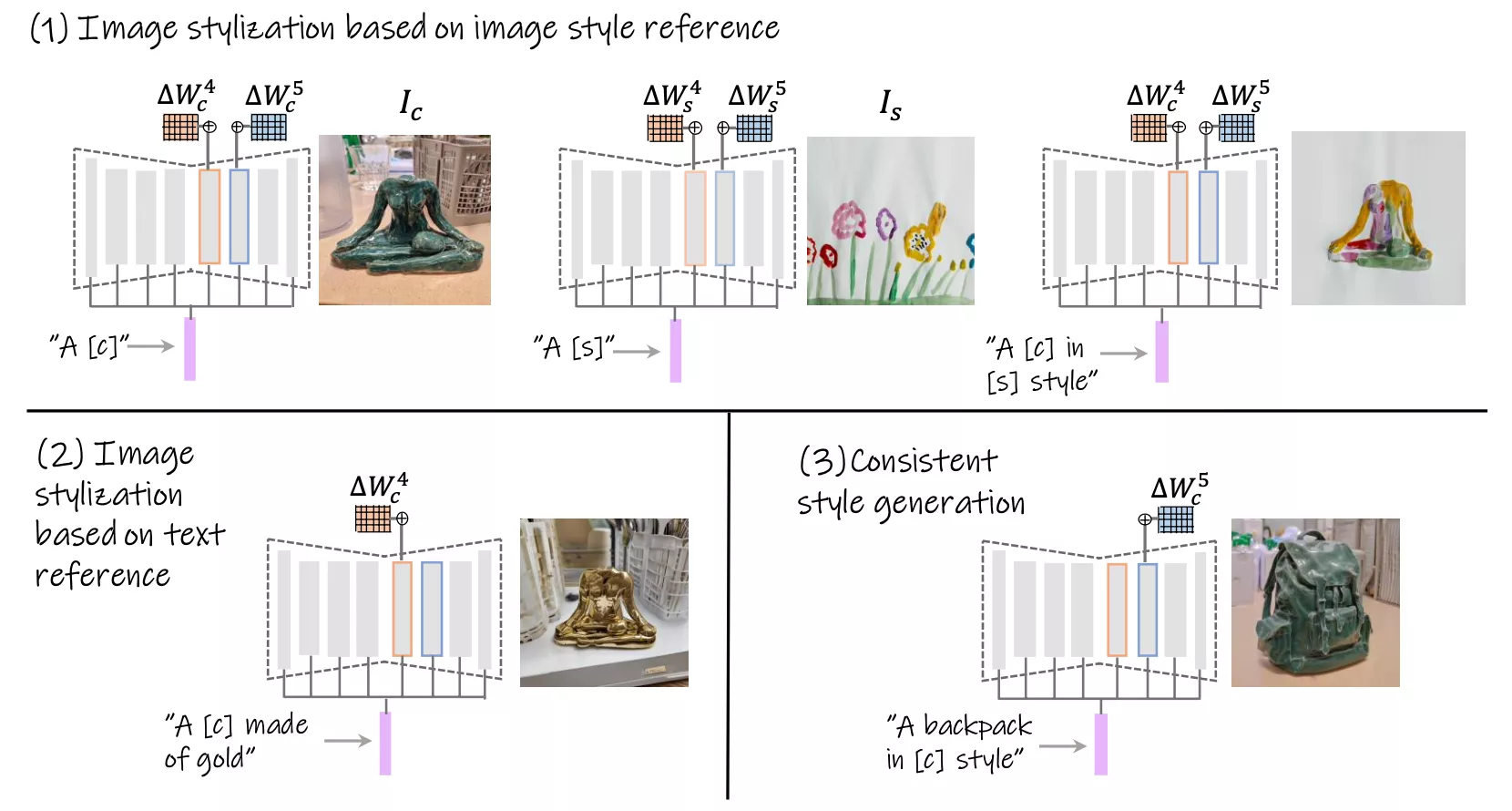

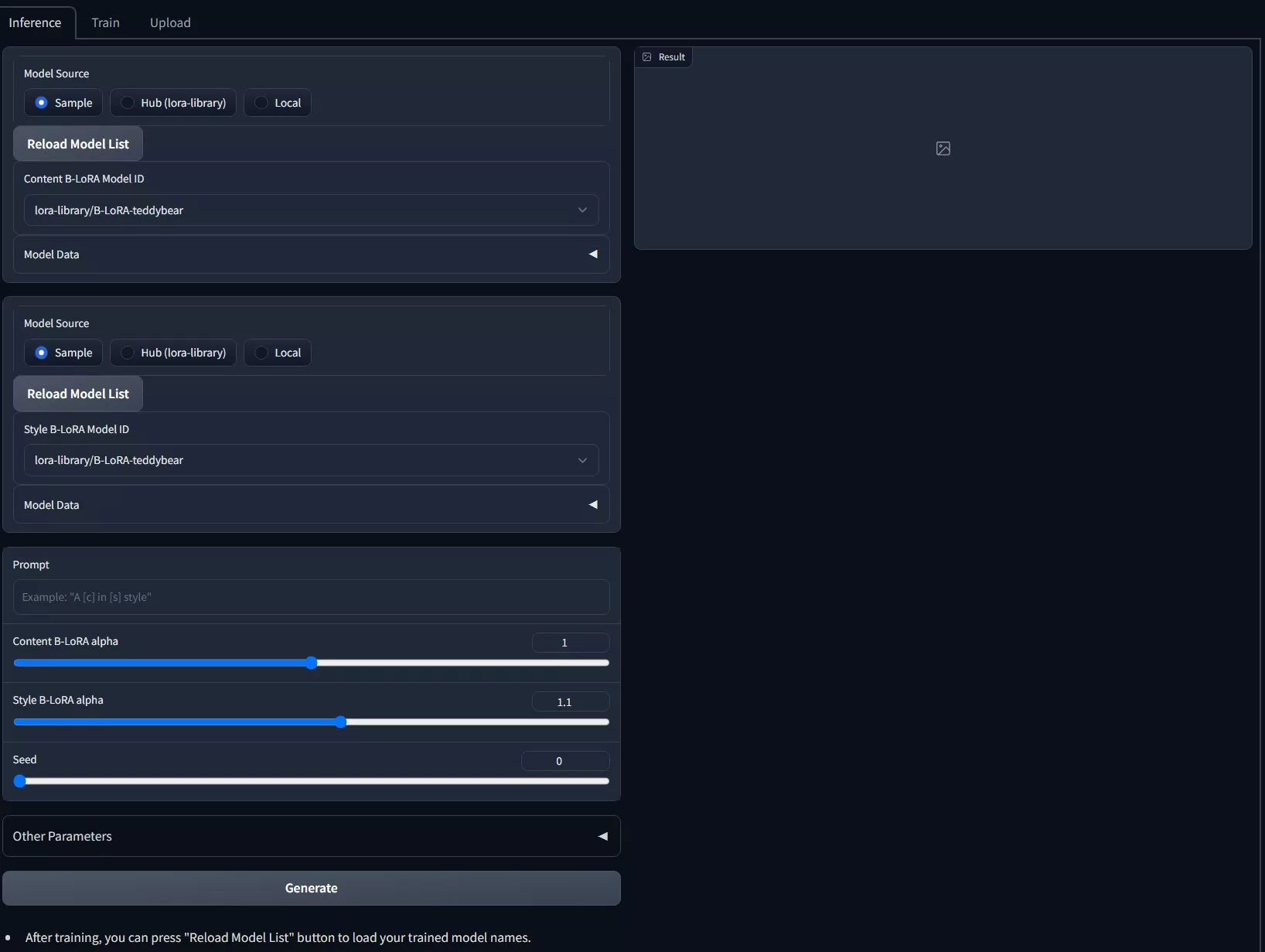

该方法利用LoRA(低秩适应)技术,能够隐式地将图像的风格和内容组件分开,从而支持多种图像风格化任务。通过深入分析SDXL与LoRA相结合的架构,研究团队发现,同时学习两个特定块(我们称之为B-LoRAs)的LoRA权重,能够实现比单独训练每个B-LoRA更好的风格与内容分离效果。这种将训练集中在仅两个块上,并明确区分风格和内容的方法,显著提升了风格操纵的效果,并有效解决了模型微调过程中常见的过拟合问题。一旦训练完成,这两个B-LoRAs可以作为独立的组件,用于执行各种图像风格化任务,包括但不限于图像风格迁移、基于文本的图像风格化、一致的风格生成以及风格与内容的混合等。

例如,如果你想将一幅画的风格应用到一张照片上,你可以使用B-LoRA方法。首先,你需要提供一张风格参考图像和一张内容图像(即你想要保留内容的照片)。然后,B-LoRA会分析这两张图像,并训练出两个B-LoRA,分别捕获风格和内容。最后,你可以将这两个B-LoRA组合起来,生成一张新图像,它将内容图像的主体以风格参考图像的风格呈现。这样,你就可以得到一张既保留了原始内容又具有新风格的照片。

主要功能和特点:

- 风格和内容的隐式分离: B-LoRA通过优化两个特定的Transformer块(称为B-LoRAs),实现了风格和内容的分离,这比单独训练每个B-LoRA更有效。

- 提高风格操控性: 通过分离风格和内容,B-LoRA显著提高了风格操控的能力,并克服了与模型微调相关的过拟合问题。

- 灵活性: 一旦训练完成,两个B-LoRAs可以作为独立组件使用,支持各种图像风格化任务,如图像风格迁移、基于文本的图像风格化、一致风格生成和风格-内容混合。

工作原理:

- 分析SDXL架构: 通过分析Stable Diffusion XL(SDXL)模型的架构,研究者们发现两个特定的Transformer块可以用于分离输入图像的风格和内容。

- 使用LoRA进行训练: 利用LoRA(Low-Rank Adaptation)方法,研究者们仅针对这两个Transformer块训练更新矩阵,这些矩阵捕获了输入图像的风格和内容。

- 风格和内容的独立使用: 训练完成后,可以单独或组合使用这两个B-LoRA,以适应不同的图像风格化应用。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...