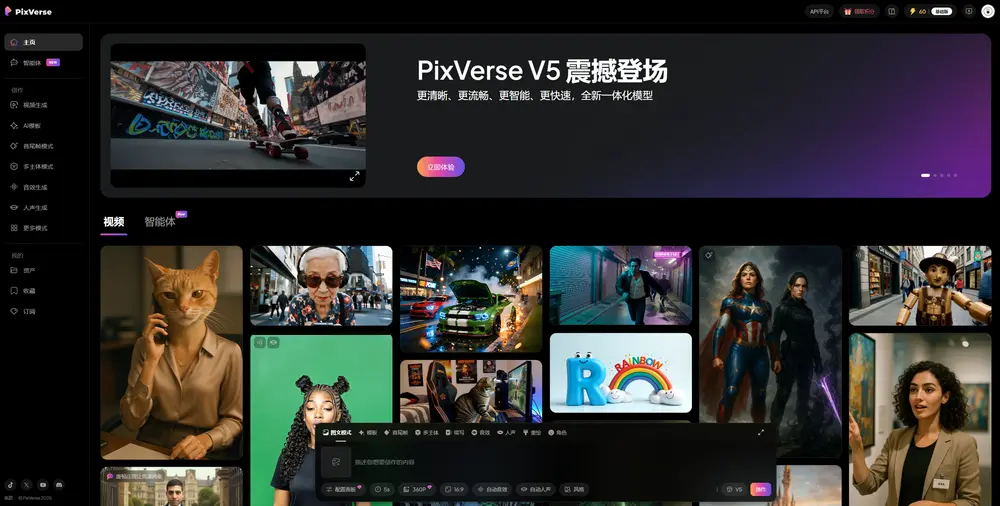

爱诗科技(PixVerse)正式推出新一代视频生成大模型 PixVerse V5,并同步上线 Agent 创作助手。此次更新不仅是功能迭代,更是一次在生成速度、视觉真实感与语义理解能力上的系统性升级。

产品上线首日,全球超百万用户完成更新并体验新版本,创下历代版本发布首日活跃新高。目前,PixVerse(拍我AI)全球用户规模已突破 1亿,成为全球领先的AI视频生成平台之一。

三大核心升级:快、真、准

PixVerse V5 并非小修小补,而是从底层技术出发,实现了三个关键突破。

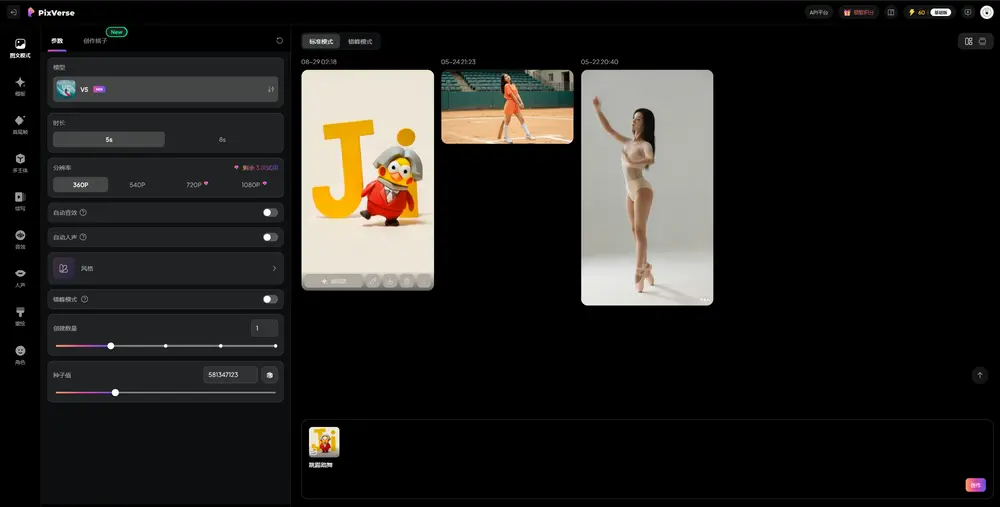

1. 极速生成:从“分钟级”到“秒级”

PixVerse 一直以生成速度快著称,V5 版本通过模型蒸馏与推理优化,进一步压缩生成耗时:

- 5秒内生成一段 360p 高质量短视频;

- 60秒内完成 1080p 高清视频生成。

这一速度已接近“准实时”水平,极大提升了创作效率,尤其适合内容创作者快速试错与批量生产。

2. 更少“AI味”:让视频更像真实拍摄

过去,AI生成视频常被诟病“塑料感强”“动作僵硬”“光影失真”。PixVerse V5 通过以下手段显著改善:

- 扩充高质量美学训练数据集,覆盖更多真实场景与艺术风格;

- 引入人类偏好对齐(RLHF) 技术,让模型学习“什么是好看的视频”;

- 优化运动建模能力,提升人物肢体动作、镜头推拉、物体位移的自然度。

无论是复杂的人物转身、宠物奔跑,还是光影变化、材质反光,V5 都表现出更强的真实感,逐步逼近实拍效果。

3. 指哪打哪:统一特征空间,提升语义理解

“AI听不懂人话”是生成模型的普遍痛点。PixVerse V5 采用统一特征空间技术,实现多模态输入的精准映射:

- 输入一句话(“一只猫从书架跳到沙发”),模型能准确还原动作逻辑;

- 上传一张图(如复古海报),可将其风格迁移到动态场景中;

- 提供一段参考视频,模型可模仿其节奏、运镜与情绪表达。

无论文本、图像还是视频,都被映射到同一语义空间,确保意图理解一致,减少“跑偏”现象。

Agent 创作助手:零基础也能做出有故事的视频

除了核心模型升级,PixVerse 还推出了全新的 Agent 创作助手,旨在降低AI视频创作门槛。

它的特点是:

- 只需上传一张图片,无需编写复杂提示;

- 自动生成 5–30 秒的完整短片,包含情节发展、运镜变化与音效建议;

- 内置多种创意模板,帮助用户快速启动。

上线当日,最受欢迎的五大创意模板为:

- 巨大宠物和小小人

- 穿破次元壁

- 萌宠罪犯档案

- 未来发型学家

- 宠物的野外之旅

这些模板兼具趣味性与传播性,已在 TikTok、Instagram 等平台引发大量二次创作。

技术背后:持续迭代的工程积累

PixVerse 的快速进步并非偶然。自 V1 版本以来,团队已连续推出多个重要版本(V2、V2.5、V3、V3.5、V4),逐步构建起完整的视频生成技术栈。

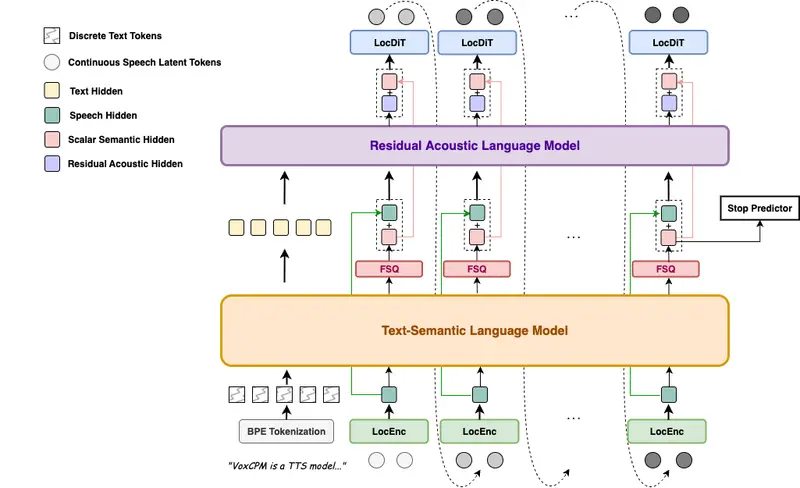

V5 的成功,建立在以下几个关键技术方向的长期投入之上:

- 大规模参数模型训练:提升动作建模与细节还原能力;

- 高效推理引擎:支持端到端加速,保障生成速度;

- 多模态对齐架构:打通图文视频语义鸿沟;

- 用户反馈闭环:基于海量真实使用数据持续优化模型偏好。

这种“技术驱动+产品落地”的双轮模式,使其在竞争激烈的AI视频赛道中保持领先。

全平台上线,支持多种使用方式

目前,PixVerse V5 与 Agent 创作助手已全面上线:

- 🌐 国际版:https://app.pixverse.ai/

- 🇨🇳 国内版:https://pai.video/

支持:

- 网页端直接使用

- iOS / Android App

- 开放平台 API 接入

开发者可通过 API 将 PixVerse 的视频生成能力集成至自有应用或工作流中。

相关文章