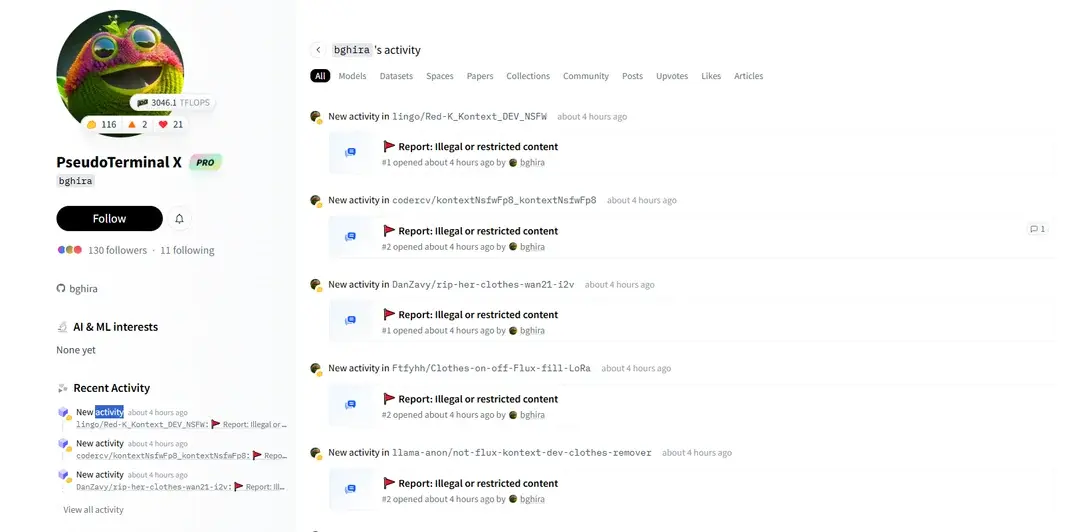

近日,知名 LoRA 训练工具 Simpletuner 的创建者 bghira 被曝出在 Hugging Face 上大规模举报 NSFW(不适合工作场合的内容)LoRA,导致多个模型被平台下架。这一行为迅速引发了社区关注和质疑,并揭露出更深层次的问题——包括他对开源许可的违反、对批评者的封锁、以及他本人也在训练并发布 NSFW 内容的事实。

Reddit 用户 TechnoByte_ 整理了一份详尽的时间线,帮助社区了解整个事件的发展脉络。以下是对该事件的整理与分析:

一、事件起因:bghira 开始举报 NSFW LoRAs

- 2025年7月4日 13:43

bghira 突然开始在 Hugging Face 平台上大量举报 NSFW LoRA 模型,这些模型多为社区成员训练并上传,主要用于图像生成中的成人内容相关用途。 - 2025年7月4日 17:44

Reddit 用户 u/More_Bid_2197 在 r/StableDiffusion 子版块上对此行为提出质疑,指出这种举报行为缺乏透明度和一致性。 - 2025年7月4日 21:08

一位用户试图通过评论 @bghira 请求解释其举报动机,却被对方迅速封锁,未获得任何回应。

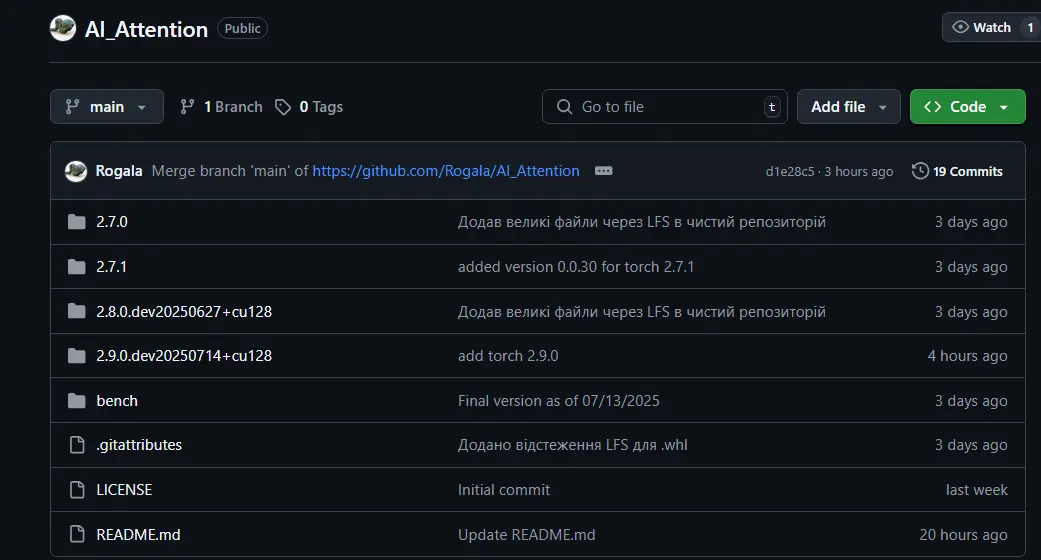

二、调查揭示:Simpletuner 项目本身涉嫌许可违规

在对 Simpletuner 项目的进一步调查中,发现该项目存在严重的开源许可问题:

- AGPLv3 与 Apache 2.0 许可证冲突

Simpletuner 声称使用的是 AGPLv3 和 Apache 2.0 双许可,但实际代码实现中并未遵循这两个许可证的兼容性要求,构成明显的合规漏洞。 - GitHub 问题被删除

有用户在 GitHub 上开启 issue 指出这些问题后,bghira 删除了该 issue,并同时将 Hugging Face 上的仓库下架,以避免更多人看到其举报行为。 - Discord 社区封闭

bghira 还将其公共 Discord 服务器的邀请链接失效,阻止外界对其行为的讨论。

三、矛盾升级:bghira 自身也发布 NSFW LoRA

在事件发酵过程中,有网友在其 Civitai 账号中发现了一个由 bghira 自行训练并发布的 NSFW LoRA 模型,用于 FLUX 模型的微调。这直接与其举报他人 NSFW 模型的行为形成强烈反差。

- FLUX 许可限制

FLUX 模型明确禁止用于 NSFW 内容训练,而 bghira 发布的 LoRA 明显违反了该许可条款。 - 回应充满嘲讽

当网友指出其双重标准时,bghira 的回应充满了讽刺和人身攻击:“我觉得你昨天花了这么多时间了解我真是挺可爱的。你是我的头号粉丝!”

“哦,所以你承认你的东西都违反了许可证,谢谢你,technoweenie。”

四、虚假举报与报复行为曝光

事件继续升级,bghira 被指发起恶意虚假举报,其中包括:

- 2025年7月5日 14:55

bghira 对一名用户上传的 SD1.5 模型发起举报,指控其“基于非法内容训练”,但实际上该模型是基于合法数据集合并而成,无额外训练数据。 - 2025年7月5日 16:18

用户向 Hugging Face 提交举报,控诉 bghira 的骚扰、辱骂及虚假举报行为。 - 2025年7月5日 17:26

一个名为 EnforcementMan 的新账号出现,疑似为 bghira 马甲,举报了 Chroma(另一款 AI 工具)。

五、社区反思:谁来监督“举报者”?

此次事件不仅暴露了个别开发者的道德风险,也引发了社区对以下几个核心问题的思考:

- 开源许可的执行是否到位?

- Simpletuner 是否真的符合其所宣称的许可?

- 社区是否有机制识别并纠正此类违规行为?

- 平台审核机制是否被滥用?

- 举报系统是否被用于打压竞争对手或不同声音?

- 如何防止举报机制沦为个人情绪宣泄的工具?

- NSFW 内容的边界在哪里?

- 社区应如何平衡自由创作与内容安全?

- 是不是所有 NSFW 内容都应该被清除?还是需要建立更清晰的分类与标签体系?

六、后续影响与社区动向

随着 Hugging Face 开始下架部分 NSFW LoRA,社区成员正在寻找新的平台来分享具有争议性的模型。一些用户已转向 Civitai、Patreon、私人论坛等渠道。

此外,Simpletuner 项目的信任度受到严重打击,不少开发者表示将重新评估其依赖关系。(来源)

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...