香港大学、阿里达摩院与湖畔实验室的研究团队近日发布LayerFlow——一款专为层感知视频生成设计的统一框架。不同于传统视频生成方案,LayerFlow通过分层提示机制,可同步生成透明前景、纯净背景及混合场景视频,支持从内容创作到视频编辑的全流程需求。

核心能力:分层操作重构视频生成场景

四大功能解锁多层视频创作可能

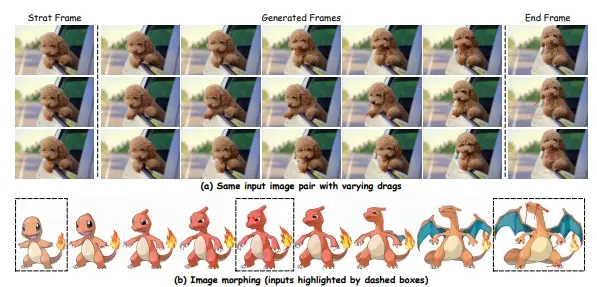

- 多层视频生成:输入分层文本提示(如前景“漂浮的宇航员”+背景“星河背景”),实时合成包含透明前景与干净背景的混合视频;

- 条件生成模式:

- 背景条件生成:给定海浪视频背景,输入“冲浪者”提示即可生成匹配动态的前景人物;

- 前景条件生成:上传人物舞蹈视频,模型自动生成“舞台灯光变幻”的适配背景;

- 视频智能分解:从复杂混合视频中剥离独立前景与背景层,例如将街景视频中的车辆与建筑分离为可编辑的独立图层;

- 多模态输入支持:兼容文本提示与视频条件输入,实现“文本-视频”“视频-视频”的跨模态生成。

技术路径:多阶段训练攻克数据与模型难题

创新框架设计突破三大技术瓶颈

- 统一表征机制:

- 将各层视频切片为子片段,通过变分自编码器(VAE)编码为长序列;

- 引入层嵌入技术:为每层文本提示添加索引标记,经T5编码器处理后与视觉特征融合,实现精准分层控制。

- 多阶段训练策略:

- 阶段一:使用低质量多层视频数据预训练基础模型,构建初步分层生成能力;

- 阶段二:通过运动LoRA微调,使模型适配静态图像数据,保留动态时序特征;

- 阶段三:结合高质量分层图像与拼接视频数据,通过内容LoRA优化生成精度,确保前景透明度与背景纯净度。

实验验证:量化指标与用户反馈双优

性能超越传统方案的三大维度

- 定量评估(VBench指标):

- 帧一致性提升27%,动态场景中物体运动更自然;

- 文本对齐得分提高31%,生成内容与提示语义匹配度显著增强。

- 用户研究(30名专业标注者):

- 在艺术质量、前景透明度、背景纯净度等5项指标中,LayerFlow用户满意度超现有方案42%,尤其在“复杂场景文本映射”场景中优势显著。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...