OpenAI今天宣布对其智能代理 Operator 进行重要升级,将其核心 AI 模型从 GPT-4o 的定制版本切换为最新推出的 o3 模型。

Operator 是一个能够在云端虚拟机中自主浏览网页、运行软件并完成用户指令的 AI 代理。此次升级意味着它将具备更强的推理能力与更精细的安全控制。

Operator 是什么?

Operator 是 OpenAI 推出的一种“计算机使用代理(Computer Use Agent)”,可以模拟人类操作:

- 在浏览器中搜索信息

- 打开和编辑文档

- 使用特定软件执行任务

- 自主决策并完成复杂流程

这类代理是当前 AI 研究的重要方向之一。随着各大公司竞相推出高度自动化、低干预的任务代理系统,AI 正在从“辅助工具”向“自主执行者”演进。

Operator 升级要点

✅ 新模型:基于 o3 构建

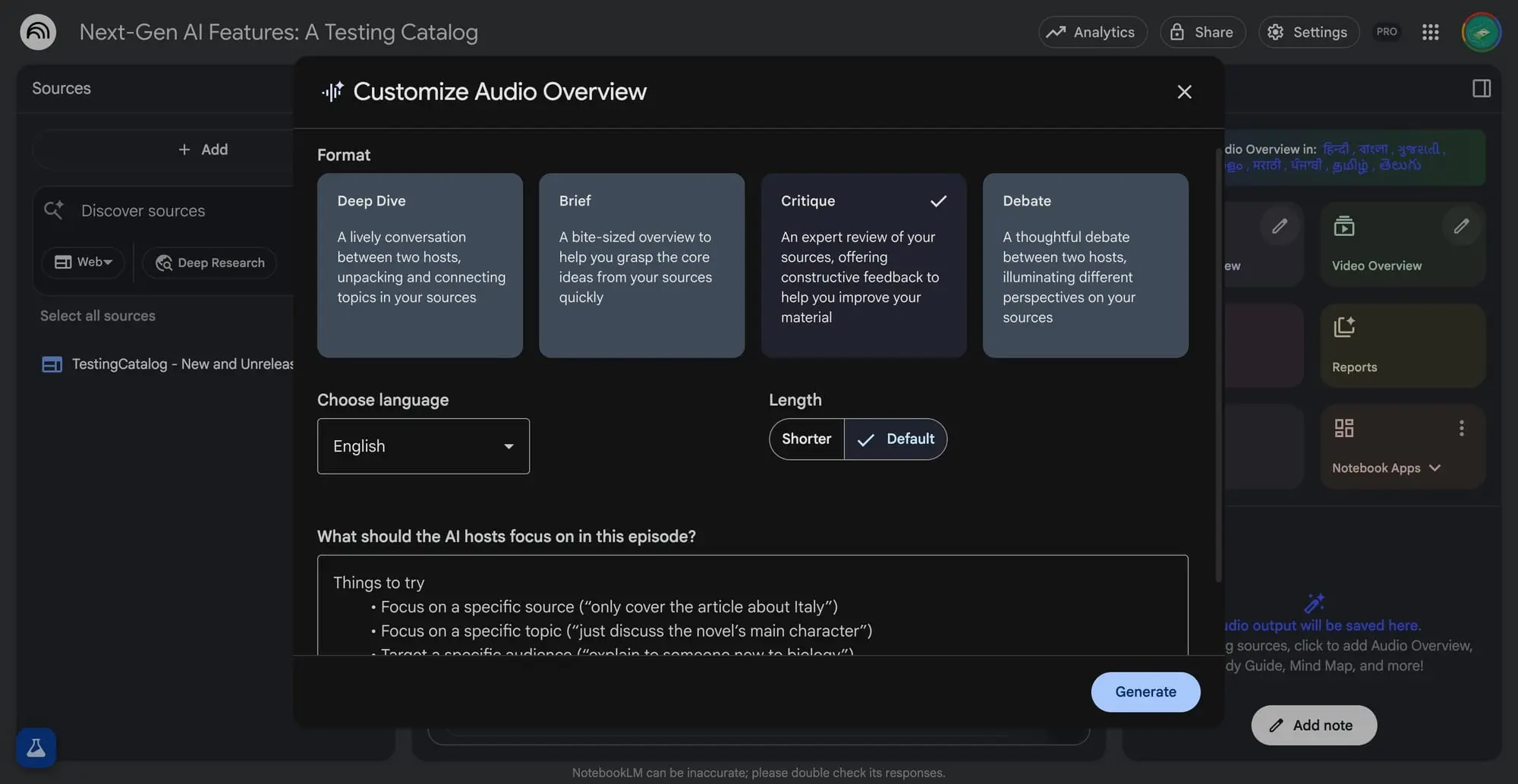

Operator 将不再依赖此前的 GPT-4o 定制版本,而是采用 OpenAI 最新的 o3 模型——这是 o 系列推理模型中的最新成员。

据 OpenAI 报道,o3 在数学和逻辑推理任务上表现更为出色,并通过了额外的训练数据微调,以提升其在计算机使用场景下的安全性和稳定性。

API 版本 Operator 仍将基于 GPT-4o,但面向终端用户的代理体验将优先采用 o3。

✅ 更强的安全机制

OpenAI 表示,新款 o3 Operator 经历了专门针对“计算机使用”的安全强化训练,包括:

- 教导模型理解哪些行为应拒绝执行(如非法请求)

- 提高对敏感个人数据查询的警惕性

- 增强抵御提示注入攻击的能力

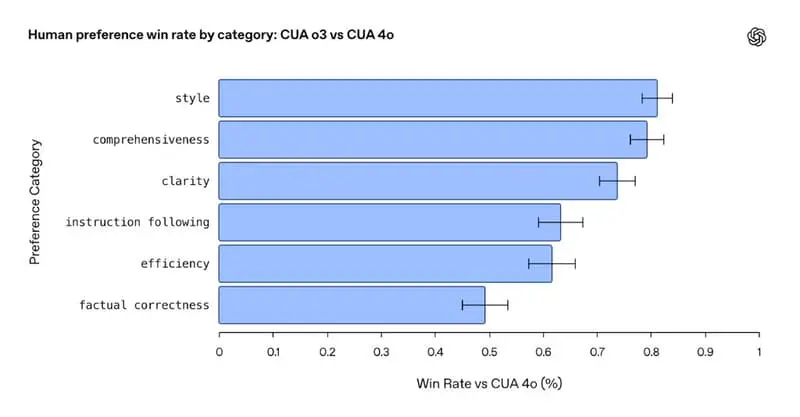

在一份技术报告中,OpenAI 展示了 o3 Operator 在多项安全评估中的表现:

| 指标 | o3 Operator 相比 GPT-4o Operator |

|---|---|

| 对非法请求的拒绝率 | 更高 |

| 对敏感个人信息的访问尝试 | 更少 |

| 对提示注入攻击的防御能力 | 更强 |

尽管 o3 具备强大的编码能力,但 OpenAI 明确表示:

“o3 Operator 并不具备原生访问代码环境或终端的权限。”

用户关心的问题

尽管 Operator 的升级带来了更强的能力和更高的安全性,但仍有不少开发者和企业关注以下几个问题:

- 模型如何判断哪些请求属于“非法”或“危险”?

- 如果被误判,用户是否有申诉机制?

- 是否会在未明确授权的情况下访问或修改系统?

OpenAI 强调,Operator 仍遵循其多层安全策略,并不会擅自执行超出授权范围的操作。同时,他们也在持续优化模型的边界判断能力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...