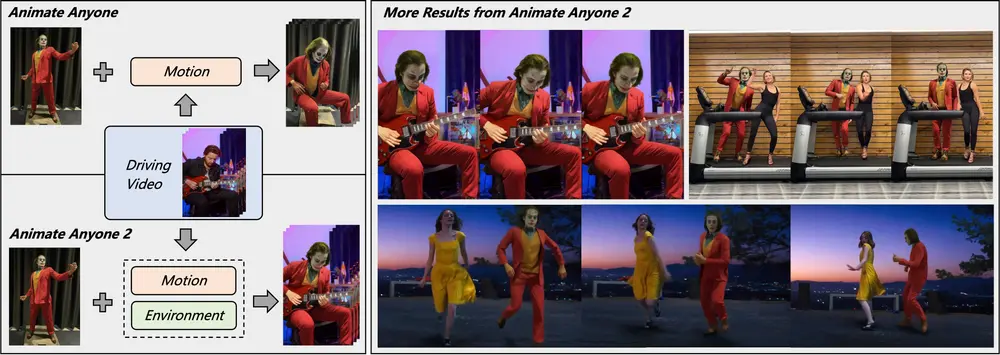

阿里通义实验室推出高保真角色图像动画生成框架Animate Anyone 2,它不仅利用运动信号来驱动角色动画,还从驱动视频中提取环境表示,使角色动画能够与环境自然地融合。前代技术Animate Anyone就没有开源,Animate Anyone 2应该也不会开源,大家要想体验只能到阿里官方的通义APP。

例如,如果输入是一个海边奔跑的少年的图像和一段海边的视频,Animate Anyone 2 不仅可以让少年动起来,还能让他与海边的环境(如海浪、沙滩等)自然地互动,而不是简单地将角色叠加在背景上。

主要功能

- 角色动画生成:利用参考角色图像和运动信号序列,合成连贯的动画视频。

- 环境感知能力:通过从驱动视频中提取环境表示,使角色动画能够与环境自然融合,展现出环境感知能力。

- 高质量输出:生成的动画在视觉质量、动作连贯性和角色与环境的互动性方面表现出色。

主要特点

- 环境表示提取:从驱动视频中提取环境表示,将环境定义为角色区域之外的部分,使角色能够自然地融入这些区域。

- 形状无关掩码策略:提出一种形状无关掩码(shape-agnostic mask)策略,有效表征角色与环境的边界关系,避免形状泄漏问题。

- 对象引导与空间混合:通过对象引导器提取互动对象的特征,并采用空间混合机制将这些特征注入生成过程中,增强角色与对象的互动效果。

- 姿态调制策略:提出一种深度姿态调制(pose modulation)方法,通过引入结构化深度信息来增强角色肢体之间的空间关系表示,使模型能够处理更复杂多样的动作模式。

工作原理

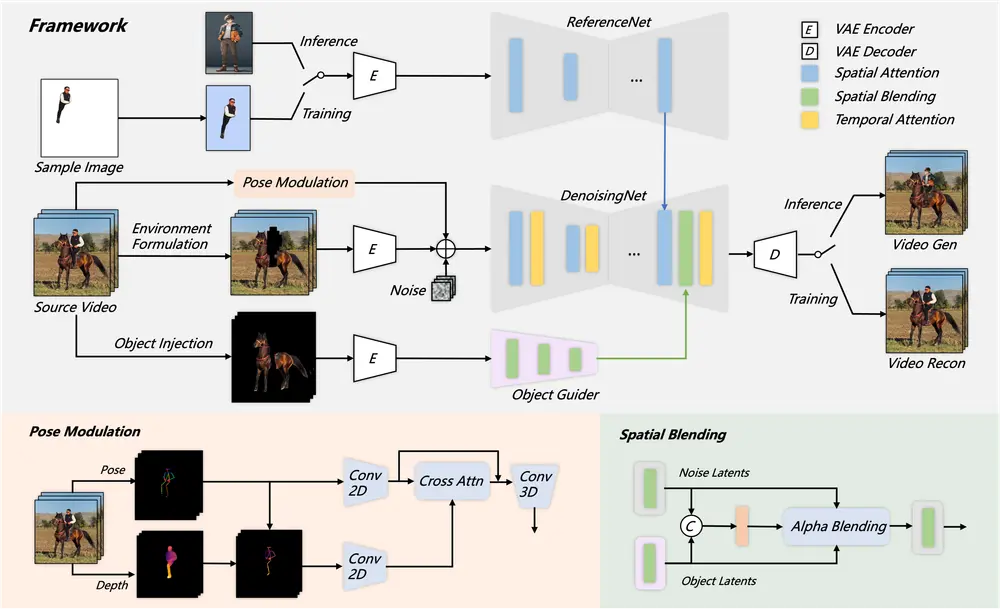

- 框架结构:

- 训练阶段:输入包括参考视频、角色图像、运动信号序列、环境序列和对象序列。模型通过自监督学习,将角色从环境中分离出来,并在训练过程中重构参考视频。

- 推理阶段:给定目标角色图像和驱动视频,模型能够生成与驱动视频一致的动作和环境关系的角色动画。

- 环境表示:通过形状无关掩码策略和随机尺度增强,模型能够学习角色与环境的有效融合,同时避免形状泄漏和大小约束问题。

- 对象注入:通过对象引导器提取互动对象的特征,并通过空间混合机制将这些特征注入到生成过程中,增强角色与对象的互动效果。

- 姿态调制:通过引入结构化深度信息,增强角色肢体之间的空间关系表示,使模型能够处理更复杂多样的动作模式。

具体应用场景

- 影视制作:快速生成高质量的角色动画,减少手工动画制作的时间和成本。

- 广告与营销:创建具有吸引力的动画广告,角色可以与广告场景自然互动。

- 虚拟角色应用:为虚拟主播、虚拟客服等生成自然的动画,提升用户体验。

- 游戏开发:快速生成游戏中的角色动画,使角色能够与游戏环境自然互动。

- 教育与培训:生成教育视频,角色可以与教学场景互动,增强教学效果。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...