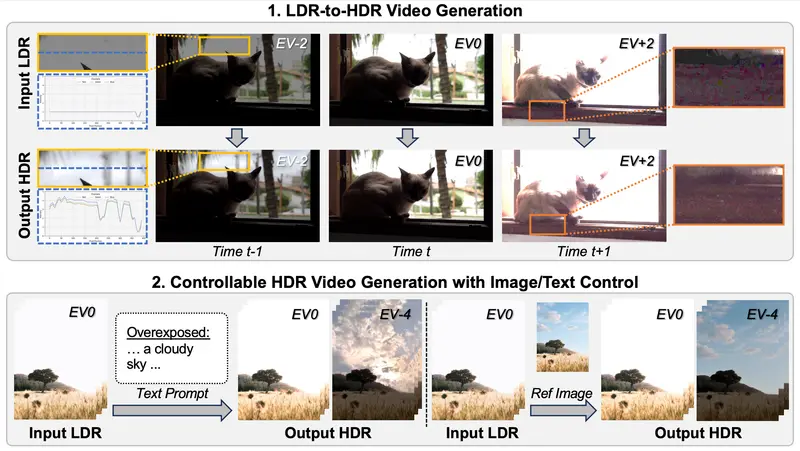

大多数数字视频受限于存储格式,以 8 位低动态范围(LDR) 保存。这意味着原始场景中丰富的高光细节(如云层纹理、灯光光晕)和阴影层次(如暗部织物、夜景角落)因饱和与量化而永久丢失。这不仅限制了在 HDR 显示器上的呈现效果,更让后期重新曝光(Re-exposure)变得几乎不可能——调亮即噪点爆炸,调暗即死黑一片。

- 项目主页:https://yzmblog.github.io/projects/DiffHDR

由 德克萨斯农工大学、Eyeline Labs 和 Netflix 联合研究团队提出的 DiffHDR,彻底改变了这一局面。它将 LDR 到 HDR 的转换定义为视频扩散模型潜在空间中的生成式辐射度修复任务。DiffHDR 不仅能恢复丢失的细节,还能保持极高的时间稳定性,并支持通过文本或参考图进行精准控制。

核心突破:从“拉伸亮度”到“生成辐射度”

传统方法试图通过简单的色调映射逆过程来扩展动态范围,往往导致伪影、噪声和时间闪烁。DiffHDR 的核心创新在于:

1. 利用预训练视频扩散模型的时空先验

- 无需从头训练:DiffHDR 建立在强大的预训练视频扩散模型之上,利用其已学到的物理世界规律(如光影连续性、物体结构),智能“脑补”出过曝和欠曝区域原本应有的细节。

- Log-Gamma 色彩空间:通过在 Log-Gamma 空间运行,DiffHDR 将巨大的 HDR 亮度范围压缩到模型可处理的区间,同时保留相对亮度关系,避免信息截断。

2. 卓越的时间稳定性

- 视频 HDR 化的最大痛点是帧间闪烁。DiffHDR 利用视频扩散模型的时空注意力机制,确保生成的 HDR 辐射度在时间轴上连贯一致,消除传统逐帧处理带来的抖动和闪烁。

3. 可控生成与引导

- 文本提示:用户可以通过自然语言描述期望的光影效果(例如,“让天空更蓝,云层细节更丰富”)。

- 参考图像:提供一张具有理想光照风格的参考图,DiffHDR 会将这种光影风格迁移到视频中。

- 区域引导:针对特定的过曝或欠曝区域进行重点修复,实现精细化控制。

工作原理:四步重塑光影

- 数据合成(解决数据稀缺):

- 由于配对的 LDR-HDR 视频数据极少,团队开发了一套流程:从静态 HDRI(高动态范围图像)全景图出发,通过相机路径渲染生成高质量的 HDR 视频序列,再模拟相机成像过程生成对应的 LDR 视频。这提供了大量完美的训练配对。

- 潜在空间映射:

- 输入 LDR 视频被编码到视频扩散模型的潜在空间中。

- 在 Log-Gamma 空间中,模型识别出因裁剪而丢失信息的区域(即纯白或纯黑部分)。

- 生成式辐射度修复:

- 扩散模型作为“修复画笔”,在潜在空间中迭代去噪。它不是简单地猜测像素值,而是根据上下文语义(如“这是天空”、“这是皮肤”)生成符合物理规律的 HDR 辐射度值。

- 引入时间一致性约束,确保相邻帧的生成结果平滑过渡。

- 解码与重曝光:

- 生成的潜在表示被解码回像素空间,输出真正的 HDR 视频(如 EXR 或 HDR10 格式)。

- 用户可在此基础上自由调整曝光、对比度,而不会损失画质。

性能表现:全面领先 SOTA

在多项基准测试中,DiffHDR 在以下维度显著优于现有最先进方法(如 HDRNet, DeepHDRVideo 等):

| 指标 | 表现 | 说明 |

|---|---|---|

| 辐射度保真度 | 🏆 最高 | 恢复的高光和阴影细节最接近真实场景,PSNR/SSIM 指标领先。 |

| 时间稳定性 | 🏆 最佳 | 几乎没有帧间闪烁,视觉流畅度极高,适合长视频处理。 |

| 重新曝光余量 | 🏆 最大 | 生成的 HDR 视频支持大幅度的后期曝光调整(±2-3 EV)而不崩坏。 |

| 可控性 | ✅ 支持 | 唯一支持文本/图像引导的 LDR-to-HDR 视频框架。 |

真实场景示例

- 过曝天空:传统方法只是一片死白;DiffHDR 能还原出云层的层次和颜色渐变。

- 欠曝夜景:传统方法提亮后充满彩色噪点;DiffHDR 能恢复建筑的纹理和街道的细节,且画面纯净。

- 高光反射:能准确重建金属、水面等高光物体的反射细节,增强真实感。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...