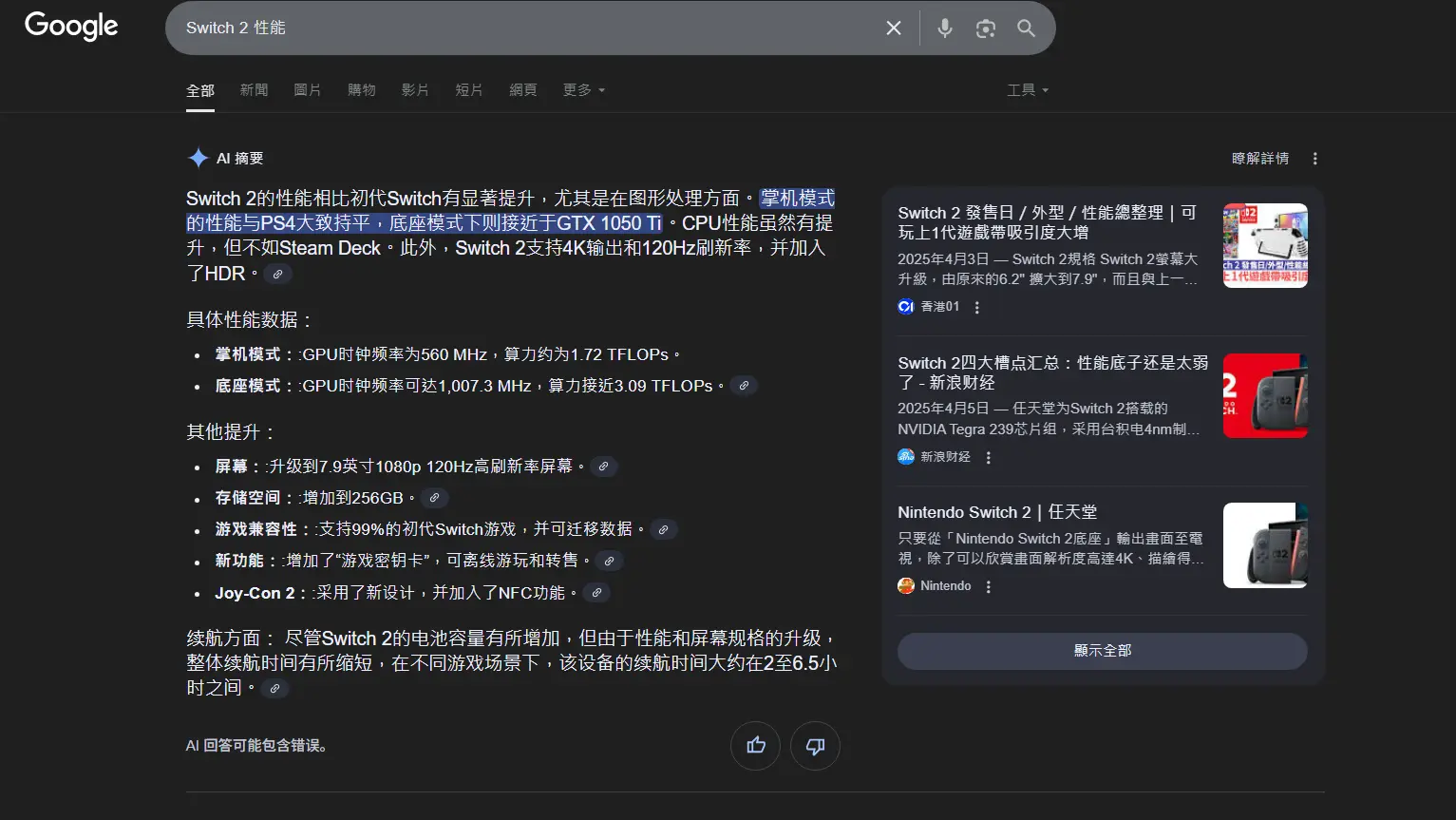

《纽约时报》联合 AI 初创公司 Oumi 发布的一项最新分析显示,尽管谷歌的 AI Overviews(由 Gemini 驱动的智能搜索摘要)在准确性上有所提升,但其 90% 的正确率意味着每 10 个答案中就有 1 个是错误的。考虑到谷歌每天处理的数十亿次搜索,这相当于每分钟都有数十万条错误信息被生成并展示给用户。

核心发现:从 85% 到 91% 的进步与局限

Oumi 使用 OpenAI 发布的 SimpleQA 基准测试(包含 4,000 多个有明确事实答案的问题)对 AI Overviews 进行了评估:

- Gemini 2.5 时期:准确率为 85%。

- Gemini 3 更新后:准确率提升至 91%。

虽然这一进步值得肯定,但在海量搜索规模下,9% 的错误率是一个惊人的数字。报告指出,如果将此错误率外推到所有谷歌搜索,AI Overviews 每天生成的错误答案数量高达数千万条。

典型错误案例

- 鲍勃·马利故居博物馆日期:AI 引用了三个来源,其中两个未提及日期,第三个(维基百科)存在矛盾年份,AI 自信地选择了错误的一个。

- 马友友与古典音乐名人堂:AI 引用了官网证明马友友入选的信息,却同时声称“古典音乐名人堂根本不存在”,自相矛盾。

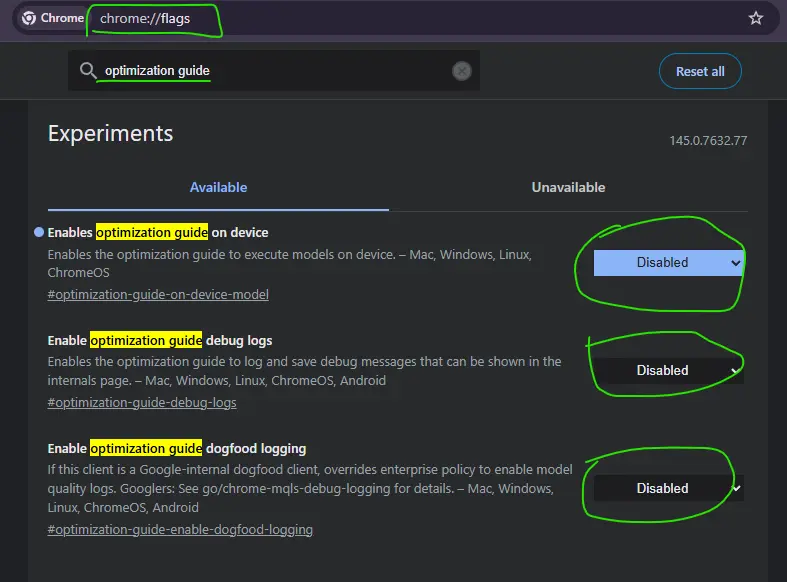

争议焦点:谷歌的反驳与基准测试的困境

1. 谷歌的回应:“测试存在严重漏洞”

谷歌发言人 Ned Adriance 强烈反对该报告,理由包括:

- 数据质量问题:认为 SimpleQA 本身包含不正确信息。

- 场景不匹配:声称该测试未反映用户实际搜索行为。

- 内部标准不同:谷歌使用经过更严格审查的 SimpleQA Verified(规模更小)进行评估,且通常显示更高的事实性指标。

2. 评估的复杂性:艺术还是科学?

- 非确定性难题:生成式 AI 具有随机性,同一问题多次查询可能得到不同结果。

- 模型混合策略:AI Overviews 并非单一模型。为了速度和成本,谷歌通常使用更快的 Gemini Flash 而非最强的 Gemini 3.1 Pro。这意味着大多数用户看到的是“够用但非最佳”的答案。

- AI 评估 AI:Oumi 使用 AI工具运行评估,而评估者本身也可能产生幻觉,形成循环验证风险。

深层隐患:信任侵蚀与“蓝色链接”的消亡

尽管 90% 的准确率在技术指标上看似尚可,但其社会影响深远:

- 权威性错觉:AI Overviews 位于搜索结果顶部,格式权威,用户倾向于直接接受摘要,而不再点击底部的“蓝色链接”进行核实。

- 错误扩散速度:传统搜索错误仅影响个别点击者,而 AI 摘要的错误会被大规模、快速地传播给数百万用户。

- 责任归属模糊:当 AI 提供错误医疗建议或法律信息时,责任难以界定。谷歌仅在底部用小字提示:“AI 可能会犯错,请双重核对。”

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...