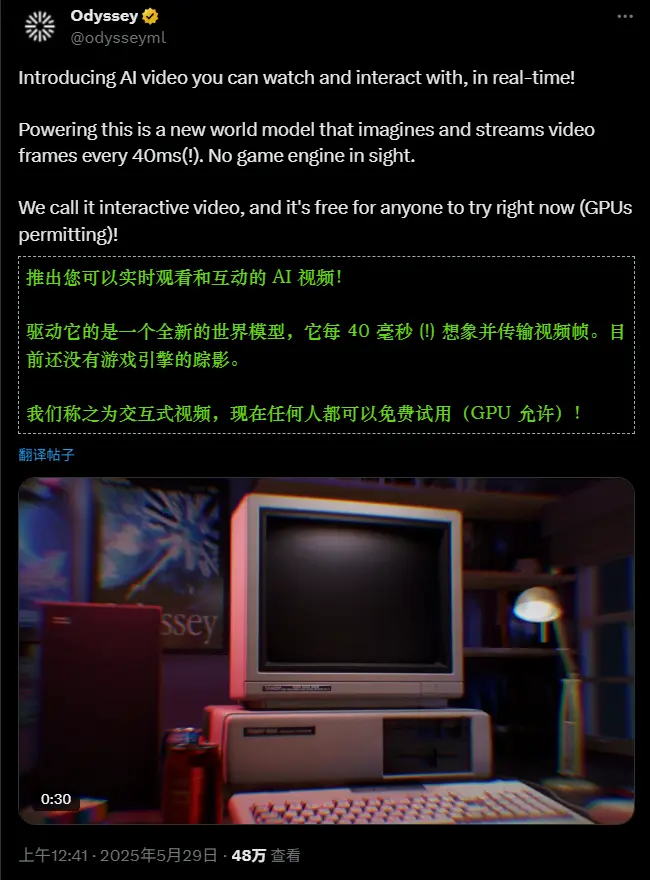

近日,由前自动驾驶工程师Oliver Cameron和Jeff Hawke联合创立的初创公司Odyssey,推出了一项引人注目的新技术——一个能够生成并实时流式传输交互式3D环境的AI模型。

目前,这一模型已以“早期演示”形式上线网络。每40毫秒生成一帧画面,用户可以通过简单的控制,在虚拟环境中自由探索,体验类似于3D游戏的沉浸感。

这不是普通视频,而是“世界模型”的一次尝试

Odyssey在官方博客中解释称,这个模型的核心是一个全新的“世界模型”,它能根据当前状态、用户动作以及历史行为,预测下一个画面:“我们正在尝试构建一个系统,能生成逼真像素、保持空间一致性、从视频中学习动作,并输出超过5分钟的连贯视频流。”

换句话说,这不是传统的预渲染视频,而是一个可以响应用户输入、动态变化的“虚拟世界”。

一场关于“世界模型”的竞赛正在上演

Odyssey并非孤军奋战。全球多家顶尖机构都在押注“世界模型”技术,包括DeepMind、Fei-Fei Li创办的World Labs、微软,以及Decart等公司。

这些团队相信,世界模型未来可用于创建互动媒体(如游戏、电影)和模拟训练(如机器人、自动驾驶测试)。如果成功,它将彻底改变内容创作的方式。

创意行业的担忧与期待并存

不过,这项技术也引发了创意界的争议。

据《Wired》报道,一些大型游戏公司正试图用AI填补人力空缺。例如,动视暴雪在大规模裁员后开始引入AI工具来降低制作成本。而一项由美国动画协会委托的研究指出,未来几个月内,影视与动画行业可能有超过10万个岗位受到AI冲击。

面对质疑,Odyssey表示他们的目标不是取代创作者,而是增强创作能力。

“互动视频为全新的娱乐形式打开了大门——故事可以按需生成和探索,不再受限于传统制作流程和高昂成本。”

——Odyssey 官方博客

公司还提到,他们相信未来的视频内容(无论是娱乐、广告、教育还是培训),都将逐步向“互动化”演进,而这正是Odyssey希望推动的方向。

当前表现:仍处早期,但潜力巨大

尽管模型已上线,但Odyssey也坦承其“尚不成熟”。

目前,生成的画面仍有模糊和扭曲现象,场景布局不够稳定。用户若长时间沿一个方向移动或转身,可能会发现周围环境突然发生变化。

不过,Odyssey承诺将持续快速迭代。目前该模型部署在NVIDIA H100 GPU集群上,每“用户小时”的流式传输成本仅为1至2美元,支持最高30帧/秒的视频输出。

未来,Odyssey计划:

- 提升时间稳定性与长期状态一致性

- 拓展动作空间,从“移动”扩展到“互动”

- 基于更大规模视频数据训练更开放的动作体系

不同于传统AI训练方式

值得一提的是,Odyssey的世界模型采用了与众不同的训练方法。

不同于大多数依赖公开数据集的模型,Odyssey开发了一套360度背包式相机系统,用于捕捉真实世界的景观。公司认为,这种方式能提供更高质量的数据基础,有助于训练出更具真实感的虚拟环境。

背后资金与生态支持

截至目前,Odyssey已获得来自EQT Ventures、GV(谷歌风投)和Air Street Capital等机构的2700万美元融资。

此外,皮克斯联合创始人、前迪士尼动画工作室总裁Ed Catmull也是Odyssey董事会成员之一,这无疑为公司在内容与技术结合方面提供了强大背书。

去年12月,Odyssey宣布正在开发一套工具链,允许创作者将AI生成的场景导入Unreal Engine、Blender和Adobe After Effects等主流创作软件,进行进一步编辑和打磨。

这意味着,AI生成的“虚拟世界”不再是终点,而是创作过程中的起点。

相关文章