Ollama 今日发布了针对 Apple Silicon (M 系列芯片) 的重磅预览版更新。新版本底层不再仅依赖传统的 llama.cpp,而是全面接入 Apple 原生的机器学习框架 MLX。这一变革旨在释放 Mac 统一内存架构的全部潜力,为本地运行大模型带来前所未有的速度提升。

- 官方介绍:https://ollama.com/blog/mlx

核心亮点:为什么这次更新至关重要?

1. MLX 驱动:原生加速,速度起飞

- 统一内存架构 (UMA):新版本充分利用 Apple Silicon CPU、GPU 和神经引擎共享内存的特性,消除了数据拷贝瓶颈。

- 硬件全开:在最新的 M5、M5 Pro 和 M5 Max 芯片上,Ollama 能直接调用新的 GPU 神经加速器,显著降低首令牌生成时间 (TTFT) 并大幅提升每秒令牌数 (Tokens/s)。

- 适用场景:特别优化了高负载任务,如运行 OpenClaw 个人助手、Claude Code、Codex 等编码智能体。

2. NVFP4 支持:生产级精度与效率

- 引入 NVIDIA NVFP4 格式:Ollama 现在支持 NVIDIA 的 NVFP4 量化格式。

- 优势:在大幅降低显存占用和带宽需求的同时,保持了极高的模型精度。

- 生态互通:这意味着你在本地 Ollama 上运行的模型,可以与云端使用 NVIDIA 模型优化器优化的生产环境保持一致的表现,消除了“本地测试好,上线就变差”的隐患。

3. 智能缓存升级:更省内存,更快响应

针对编码和 Agent 任务(通常涉及长上下文和重复系统提示),Ollama 重构了缓存机制:

- 跨对话复用:在分支对话(如 Claude Code 的多轮调试)中重用缓存,显著降低内存占用,提高命中率。

- 智能检查点:自动在提示词的关键位置保存快照,减少重复计算,响应更敏捷。

- 更智能的驱逐策略:即使旧的任务分支被丢弃,共享的前缀上下文也能保留更久,避免频繁重新加载。

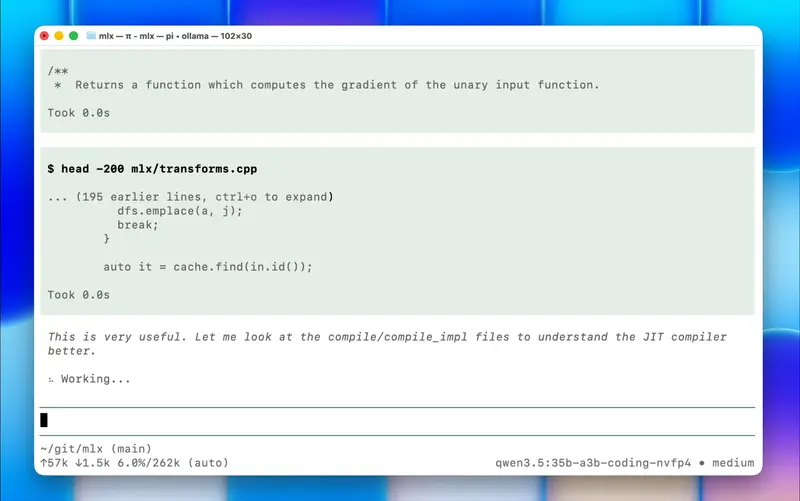

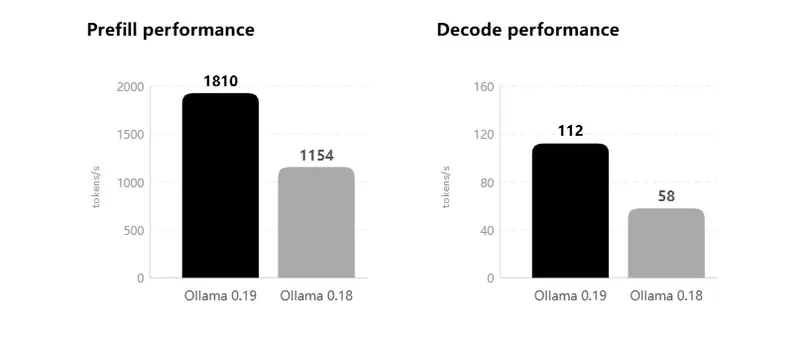

测试是在2026年3月29日进行的。测试中使用了阿里云的Qwen3.5-35B-A3B模型,该模型经过量化处理后采用了NVFP4格式;而Ollama模型则采用了之前版本的实现方式,其量化格式为Q4_K_M。测试时使用的Ollama版本为0.18。在Ollama 0.19版本中,性能会有进一步提升:使用int4格式进行运算时,预填充速度可达1851个标记/秒,解码速度则为134个标记/秒。

如何开始体验?

⚠️ 硬件要求

- 设备:Apple Silicon Mac (M1/M2/M3/M4/M5 系列)。

- 内存:为了获得最佳体验(特别是运行大模型),建议 统一内存 > 32GB。

- 版本:需下载 Ollama 0.19 (预览版)。

🚀 快速启动示例

本次更新特别推出了针对编码任务优化的 Qwen3.5-35B-A3B 模型(采用 NVFP4 格式)。

1. 安装/更新 Ollama

前往 ollama.com 下载最新预览版。

2. 拉取并运行编码专用模型

# 直接聊天

ollama run qwen3.5:35b-a3b-coding-nvfp4

3. 集成到 AI 工作流

- 配合 OpenClaw:

ollama launch openclaw --model qwen3.5:35b-a3b-coding-nvfp4 - 配合 Claude Code:

ollama launch claude --model qwen3.5:35b-a3b-coding-nvfp4(注:此处

ollama launch claude可能是指通过 Ollama 提供的兼容接口启动类 Claude 体验的会话,或特定插件命令,具体视 Ollama 最新 CLI 定义而定)

未来展望

- 更多模型支持:团队正积极适配更多主流模型架构。

- 自定义模型导入:将为微调过自定义模型的用户提供更简便的导入工具。

- 架构扩展:支持列表将持续扩大,涵盖更多社区热门模型。

致谢

此次突破离不开开源社区的协作:

- Apple MLX 团队:构建了强大的原生加速框架。

- NVIDIA 团队:贡献了 NVFP4 量化、模型优化器及 MLX CUDA 支持。

- GGML / llama.cpp 团队:奠定了本地推理的基石。

- 阿里巴巴 Qwen 团队:提供了优秀的开源模型底座。

对于 Mac 用户而言,这是 Ollama 历史上最重要的一次更新之一。MLX 的加入让 MacBook Pro 真正具备了挑战高端桌面显卡的本地推理能力。如果你是一名开发者或 AI 爱好者,现在正是升级体验的最佳时机!

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...