2025年堪称PC端AI爆发元年——小型语言模型(SLM)准确率翻倍,开发者工具生态成熟度激增,用户下载量较2024年暴涨十倍。而在本届CES展会上,英伟达的一波重磅RTX加速技术升级,更是直接解锁了AI PC在4K视频生成、图像创作、文本推理等领域的核心潜力,让本地AI工作流的效率与体验迎来质变。

从ComfyUI的精度优化,到LTX-2模型的性能飞跃,再到Ollama、llama.cpp的提速加持,RTX GPU正成为PC端生成式AI的绝对核心驱动力。

核心升级:RTX赋能全链路AI工作流,性能与效率双突破

英伟达针对GeForce RTX、RTX PRO及DGX Spark设备的AI升级,覆盖视频、图像、语言三大核心场景,实现了性能飙升、显存减负、功能扩容三重突破:

| 技术模块 | 升级亮点 | 用户价值 |

|---|---|---|

| ComfyUI 深度优化 | 原生支持NVFP4/FP8精度;集成RTX Video Super Resolution超分技术;优化权重流式加载(内存卸载) | 视频生成性能提升3倍,VRAM占用降低60%;轻松实现4K视频升级;中端GPU也能运行大模型 |

| LTX-2 模型加速 | 为Lightricks开放权重音视频模型提供NVFP8优化 | 本地生成20秒4K高质量视频,画质媲美云端模型,支持多关键帧与音频同步 |

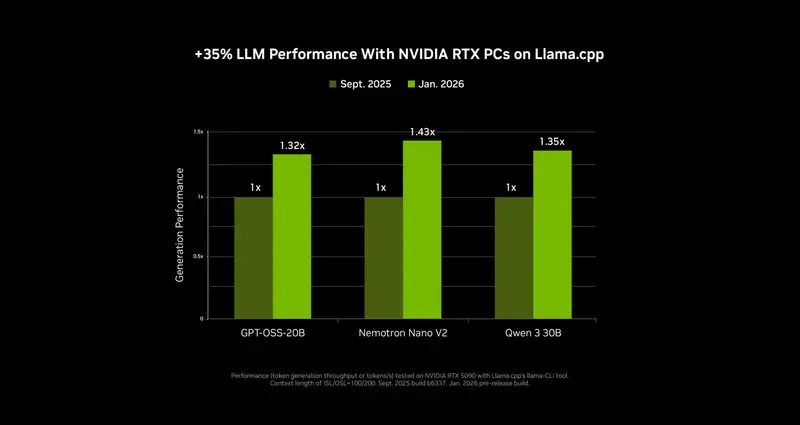

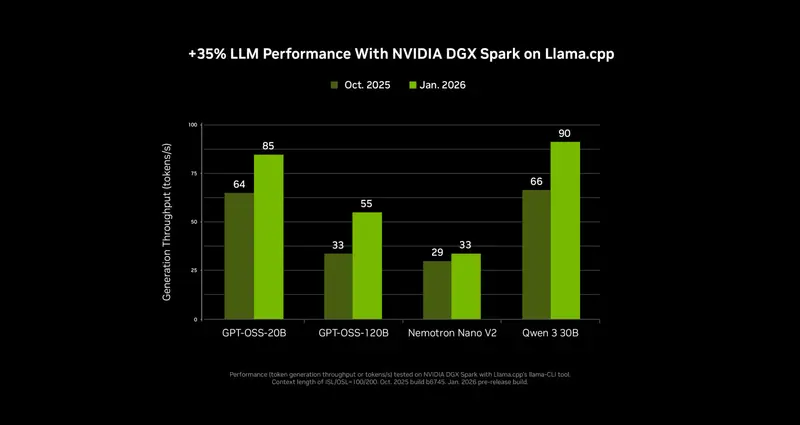

| SLM 推理提速 | 针对Ollama、llama.cpp优化,推理性能提升35% | 本地运行小型语言模型响应更快,适配Nemotron 3等专家混合模型 |

| Hyperlink 视频搜索 | 新增RTX加速视频内容搜索功能 | 自然语言检索本地视频中的物体、动作、语音,3秒响应,索引速度远超CPU |

| 3D 驱动视频生成 | 打通Blender 3D场景→关键帧→4K视频全流程 | 精确控制视频生成内容,实现影院级视觉效果 |

这些升级的核心优势在于本地化体验——所有AI工作流均在本地RTX PC完成,兼顾隐私安全、低延迟,无需依赖云端算力。

4K AI视频生成革命:3倍速+精准控制,中端GPU也能玩转

此前PC端AI视频生成的痛点十分突出:大模型显存占用过高、生成速度慢、内容控制难,4K分辨率更是遥不可及。而英伟达联合ComfyUI与Lightricks打造的全新工作流,彻底解决了这些问题。

1. 三大核心模块,实现从3D场景到4K视频的全链路可控

这套RTX驱动的视频生成流程,将创作拆分为三个灵活组合的模块,满足不同创作者的需求:

- 3D对象生成器:为视频场景创建高精度3D素材,奠定内容基础;

- 3D引导图像生成器:在Blender中搭建3D场景,一键生成逼真的关键帧图像,精准把控画面构图;

- 视频生成器:基于起始与结束关键帧生成流畅动画,再通过RTX Video超分节点将视频升级至4K分辨率,锐化边缘、消除压缩伪影,全程仅需数秒。

2. LTX-2模型:本地4K视频生成的核心引擎

作为这套工作流的核心,Lightricks发布的LTX-2开放权重模型堪称里程碑式产品:

- 支持生成长达20秒的4K视频,视觉保真度媲美顶级云端模型;

- 内置音频生成功能,实现音视频同步输出;

- 支持多关键帧控制与高级低秩适应技术,创作者可精准调整画面细节,无需依赖随机生成。

3. ComfyUI优化:性能与显存的双重胜利

英伟达与ComfyUI的深度合作,是实现高效视频生成的关键:

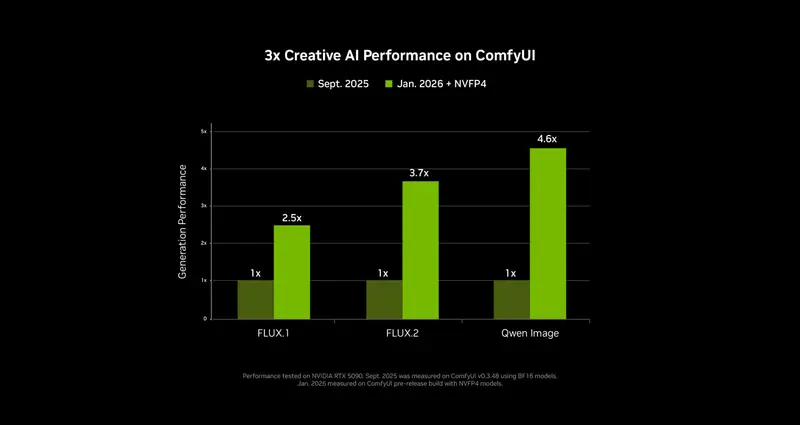

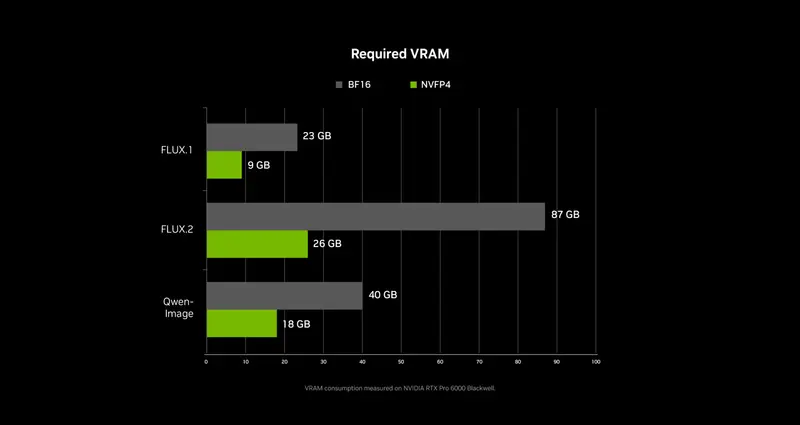

- 精度优化:NVFP4格式下性能提升3倍、显存占用降60%;NVFP8格式性能提升2倍、显存降40%,让RTX 50系列等中端显卡也能流畅运行大模型;

- 权重流式加载:当VRAM不足时,自动将模型权重卸载至系统RAM,突破显存限制;

- RTX Video超分节点:预计下月上线,一键将生成的视频升级至4K,大幅提升画面质感。

目前LTX-2、FLUX.1/2、Qwen-Image等主流模型的NVFP4/FP8检查点已可在ComfyUI直接下载,视频生成工作流也将于下月开放。

不止视频:RTX加速PC AI生态全面开花

除了4K视频生成的突破,英伟达的升级还覆盖了本地搜索、语言推理、直播优化等多个场景,进一步丰富AI PC的应用边界。

1. Hyperlink:RTX加持的本地知识库,视频搜索秒级响应

Nexa.ai的Hyperlink工具,将RTX PC转变为可自然语言交互的本地知识库:

- 支持索引文档、PDF、图像、视频等全类型文件,搜索逻辑从“文件名匹配”升级为“内容语义匹配”;

- RTX加速带来极致效率:RTX 5090上每GB文件索引仅需30秒,响应时间3秒;对比CPU方案(索引1小时、响应90秒),速度提升超百倍;

- 新增视频搜索功能,可精准定位视频中的物体、动作甚至语音内容,无论是视频创作者找素材,还是玩家找高光时刻,都能一键搞定。

2. SLM推理提速35%,本地大模型体验再升级

针对Ollama和llama.cpp两大热门开源工具的优化,让PC端小型语言模型的实用性大幅提升:

- 推理性能提升35%,模型加载速度加快,响应更流畅;

- 完美适配英伟达Nemotron 3等专家混合模型,满足专业用户的深度推理需求;

- 优化成果将同步至LM Studio、MSI AI Robot等应用,覆盖更多硬件与软件生态。

3. 英伟达Broadcast 2.1:虚拟主光下放,直播画质升级

面向直播与视频会议用户的Broadcast应用迎来2.1版本更新:

- Virtual Key Light虚拟主光效果下放至RTX 3060及以上桌面GPU,支持更多光照条件与色温控制;

- 采用全新HDRi基础贴图,实现双主光的专业直播灯光效果,普通用户也能打造演播室级画面。

DGX Spark:桌面级AI超级计算机,性能再涨2.6倍

对于追求极致AI性能的开发者与创作者,英伟达的DGX Spark桌面超级计算机也迎来重大升级:

- 自发布以来性能提升高达2.6倍,可与主PC或笔记本无缝协作;

- 支持并行运行高级AI工作负载,不占用主设备资源,兼顾创作与实验;

- 官方发布操作指南,覆盖推测性解码、双模块模型微调等高级玩法,降低专业用户的使用门槛。

RTX GPU成AI PC核心,本地生成式AI时代来临

英伟达此次的技术升级,彻底打破了“PC端AI不如云端”的固有认知——通过精度优化、显存管理、生态整合三大手段,让RTX PC具备了4K视频生成、秒级语义搜索、高效语言推理的能力。

对于创作者而言,这意味着无需昂贵的云端算力,仅凭一台RTX 3060及以上的PC,就能完成从3D建模到4K视频输出的全流程创作;对于普通用户,Hyperlink、Ollama等工具的优化,也让AI真正融入日常生产力与娱乐场景。(来源)

相关文章