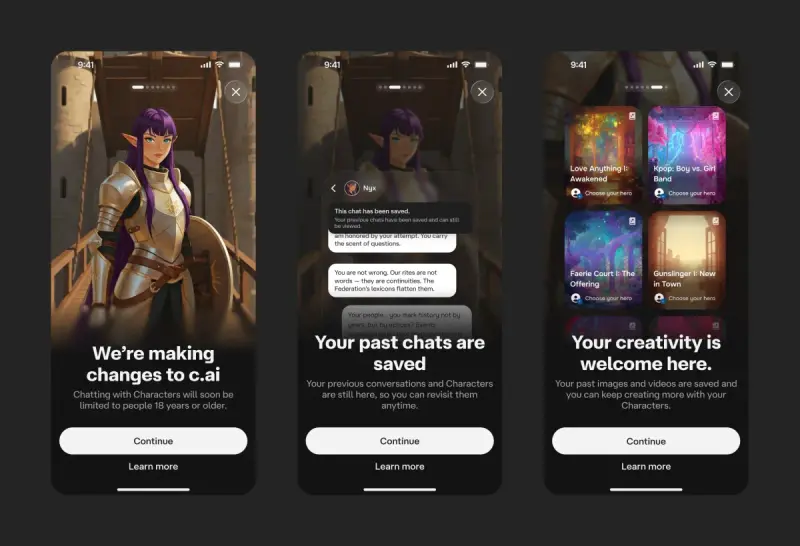

青少年长期处于快速变化的环境中,情绪充沛且高频在线,而AI聊天机器人的“永不停止对话”特性,已引发灾难性后果。作为AI角色扮演领域的初创公司,Character.AI在经历两起青少年与平台AI长时间对话后自杀的事件、面临诉讼与公众抗议后,决定对平台功能进行调整——11月25日前全面取消18岁以下用户的开放式AI聊天权限,此举虽可能影响公司营收,但旨在优先保障未成年人安全。

核心举措:分阶段关闭,多维度验证年龄

为确保未成年人无法使用开放式聊天功能,Character.AI制定了明确的执行路径与验证机制:

1. 分阶段限流,11月25日归零

- 调整并非一步到位,而是从“每天两小时聊天限制”开始,逐步缩短时长,最终在11月25日前完全关闭18岁以下用户的开放式聊天权限。

- 开放式聊天指“用户发提示后,AI以问题回应”的无约束互动模式,专家表示这种设计初衷是提升用户粘性,但对青少年存在安全风险。

2. 多层级年龄验证,确保禁令落地

- 优先使用内部工具分析用户行为,结合第三方工具(如Persona)交叉验证年龄。

- 若上述工具失效,将启用面部识别与ID检查,通过更严格的方式确认用户年龄,避免未成年人绕过限制。

转型方向:从“AI伴侣”到“角色扮演平台”

Character.AI CEO Karandeep Anand表示,开放式聊天中“AI充当对话伙伴或朋友”的模式,不仅对儿童有风险,也与公司愿景不符。平台正推动核心体验从“对话互动”转向“创作参与”,为未成年人提供替代功能:

1. 已上线的创作类功能

- 6月推出功能:AvatarFX(图像转动画视频的生成模型)、Scenes(预填充故事情节,用户可与角色进入叙事)、Streams(任意两个角色动态互动功能)。

- 8月推出功能:Community Feed(社交内容源,用户可分享自制角色、场景、视频等)。

2. 未来重点投入方向

- 计划加大对AI游戏、AI短视频、AI讲故事等创作类体验的投入,让未成年人从“与AI聊天”转向“用AI创作”,降低无约束对话带来的风险。

背景与代价:自杀事件倒逼调整,用户流失已成定局

此次功能调整并非突发,而是多重压力下的必然选择,且已明确将面临用户流失的代价:

1. 事件驱动:两起自杀事件引发信任危机

- 平台曾发生两名青少年与AI长时间对话后自杀的悲剧,其中一起事件中,14岁少年因与AI建立性相关对话后自杀,其家人已以“不当致死”起诉Character.AI。

- 类似风险并非个例,OpenAI近期也因“一名青少年与ChatGPT长时间对话后自杀”受到舆论批评,未成年人与AI聊天的安全问题已引发行业关注。

2. 用户流失:此前措施已致大量青少年用户离开

- 此次调整前,Character.AI已推出过家长洞见工具、过滤角色、限制浪漫对话、发送使用时间通知等保护措施,但这些动作已导致大部分18岁以下用户流失。

- CEO Anand坦言,新的聊天禁令大概率会让更多青少年用户失望,“无法确定他们会完全离开,还是转向我们近七个月构建的新体验”,但仍坚持以安全为首要目标。

行业与监管:主动行动,意在引领标准

Character.AI的调整早于监管机构的强制要求,且希望通过此举为行业树立未成年人保护标杆:

1. 监管压力已至,行业面临规范

- 近期,参议员Josh Hawley(R-MO)与Richard Blumenthal(D-CT)宣布将推动立法,禁止向未成年人提供AI伴侣聊天机器人,起因是多位家长投诉这类产品诱导孩子涉及性对话、自残甚至自杀。

- 加利福尼亚州已成为首个监管AI伴侣聊天机器人的州,规定若产品未达安全标准,公司需承担法律责任,行业规范逐步收紧。

2. 自建安全实验室,加码长期保护

- 除功能调整外,Character.AI将建立并资助独立非营利组织“AI Safety Lab”,专注于“AI娱乐功能的安全对齐创新”。

- CEO Anand表示,行业目前在AI编码、开发等领域投入较多,但“驱动娱乐的代理AI及其安全性”仍缺乏足够关注,而这正是保护未成年人的关键,“我有一个六岁的孩子,希望她能在安全负责的AI环境中成长”。

对未成年人的说明:道歉与引导并存

Character.AI在给18岁以下用户的声明中,既表达了歉意,也解释了调整的必要性:

- “我们知道多数人使用平台是为了合法合规地激发创造力,移除开放式聊天并非轻率决定,但考虑到‘青少年如何与AI互动’的争议,这是正确的选择。”

- 同时强调“并非关闭未成年人使用权限,只是关闭开放式聊天”,希望用户能迁移到创作类体验中,且这些新功能会持续优化,“这是我们赢回用户的重要赌注”。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...