一项短暂的实验已经结束。

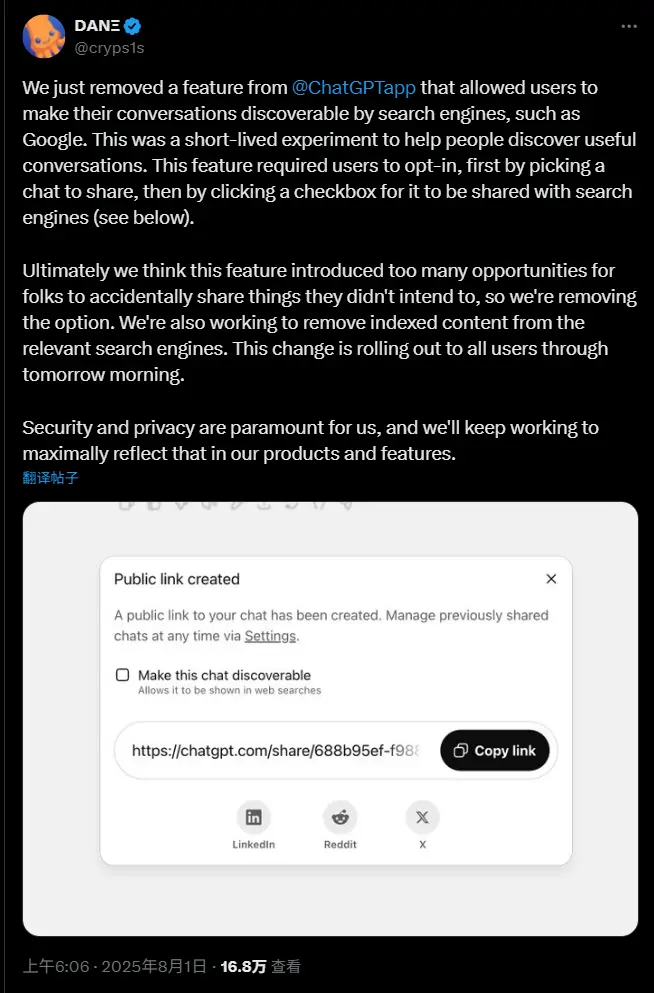

OpenAI确认,已移除 ChatGPT 中允许用户将共享对话设为“可被搜索引擎发现”的选项。这意味着,未来即使用户主动分享对话链接,这些内容也不会再出现在谷歌、必应等搜索引擎的搜索结果中。

此举源于对用户隐私风险的重新评估。OpenAI 向 TechCrunch 表示,该功能仅为一项“短暂的实验”,但最终发现它“为用户无意中分享不希望公开的内容引入了太多机会”。

曾经的“公开对话”:一扇窥探人类思维的窗口

在近期,如果你在谷歌或必应中搜索特定关键词,并将结果域限制为 chatgpt.com/share,你可能会意外发现大量陌生人与 AI 的私密对话。

这些公开链接揭示了人类需求的多样性与复杂性:

- 有人请求帮助翻新浴室,从材料选择到预算规划;

- 有人试图理解量子纠缠或黑洞信息悖论;

- 有人寻找素食晚餐创意,甚至让 AI 编写菜谱故事。

但也有一些令人不安的案例:

- 一位求职者请 ChatGPT 优化简历,对话中透露的信息足以关联到其 LinkedIn 个人资料——而记录显示,他并未获得那份工作;

- 出现疑似来自“incel”(非自愿独身者)社区的极端性别观点提问;

- 更有用户反复挑衅 AI,从“能否在微波炉里加热金属叉子”开始,最终诱导 AI 生成一份戏谑性的《如何使用微波炉不召唤撒旦:初学者指南》。

这些对话并非默认公开。它们之所以能被搜索到,是因为用户主动点击了“共享”按钮,并在弹出窗口中选择了“允许搜索引擎发现此链接”。

根据 OpenAI 的说明,即使对话被共享,用户的姓名、自定义指令以及后续新增的消息仍保持私密。但问题在于:许多用户可能并未意识到,一旦选择“可被发现”,这些链接就可能长期存在于搜索引擎缓存中,甚至暴露个人身份信息。

隐私悖论:共享 ≠ 公开,但索引放大了风险

ChatGPT 的共享机制设计上是可控的:只有用户主动操作,才会生成带有 /share 路径的唯一链接。这类似于 Google Drive 的“有链接即可查看”模式。

然而,关键区别在于索引行为。

谷歌方面对此回应称:“谷歌或任何其他搜索引擎均不控制网络上哪些页面被公开。这些页面的发布者完全控制它们是否被搜索引擎索引。”

换句话说,只要网页未明确禁止爬虫(如通过 robots.txt),搜索引擎就有权将其纳入索引。而 OpenAI 在实验期间并未阻止 chatgpt.com/share 页面被爬取。

这就导致了一个现实:用户以为自己只是“分享给他人”,但实际上可能是在“发布到公开网络”。

正如一位网友的遭遇所示——他在对话中提及公司名称和职位细节,结果通过搜索引擎即可关联到其真实身份。这种无意的信息泄露,正是 OpenAI 决定终止该实验的核心原因。

实验终止:回归“私有默认”原则

OpenAI 强调,ChatGPT 对话默认是私密的。只有在用户明确操作后才会生成共享链接。

但这次实验表明,即使是“二次确认”的设计,也无法完全防止误解或误操作。尤其是在涉及敏感信息(如简历、健康咨询、法律建议)时,潜在风险远超便利性。

因此,公司决定:

- 移除“允许搜索引擎发现”这一选项;

- 此前已生成的

/share链接仍可访问(只要对话未被删除),但不再鼓励传播; - 未来将继续探索更安全的共享方式,在便利性与隐私保护之间寻找平衡。

相关文章