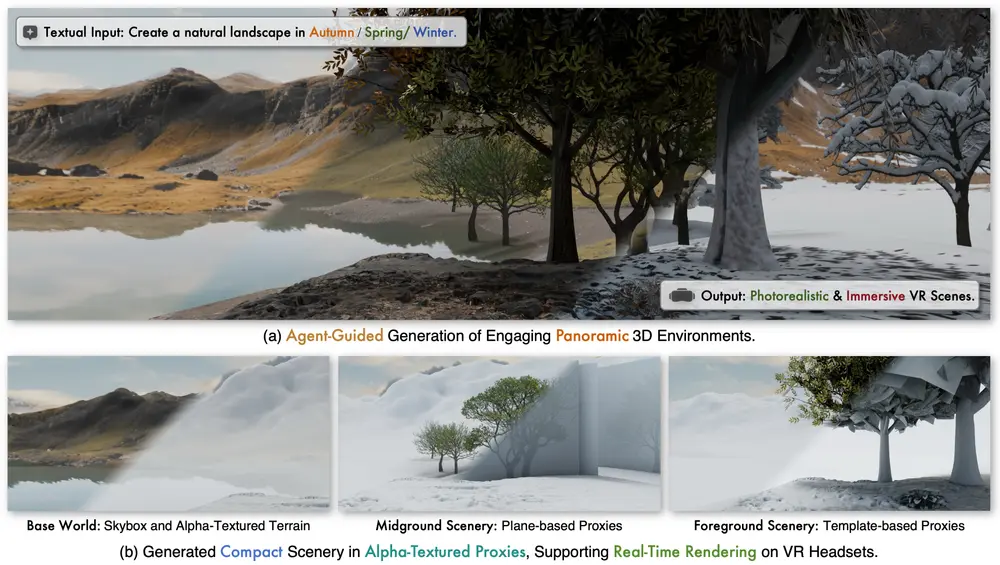

字节跳动和浙江大学的研究人员推出新型框架ImmerseGen ,用于从文本提示自动生成沉浸式 3D 场景。ImmerseGen 通过使用轻量级的几何代理(如简化地形和带有 alpha 通道的纹理平面)来表示场景,并通过代理上的 RGBA 纹理合成实现逼真的视觉效果。该框架旨在为沉浸式虚拟现实(VR)体验提供高质量、实时渲染的 3D 环境。

例如,用户可以通过输入简单的文本描述,如“创建一个自然景观,季节为秋季”,ImmerseGen 能够生成一个包含丰富细节的全景 3D 场景,用户可以在 VR 设备中实时探索。与传统的复杂几何建模方法相比,ImmerseGen 通过轻量级代理和纹理合成,显著简化了建模流程,同时保持了视觉质量和实时渲染性能。

主要功能

ImmerseGen 的主要功能包括:

- 从文本提示生成 3D 场景:用户可以通过输入简单的文本描述来生成个性化的 3D 场景。

- 实时渲染:生成的场景可以在移动 VR 头盔等设备上实现实时渲染,提供流畅的交互体验。

- 多感官沉浸:通过添加动态视觉效果(如流动的水、飘动的云)和环境音效(如风声、鸟鸣),增强用户的沉浸感。

主要特点

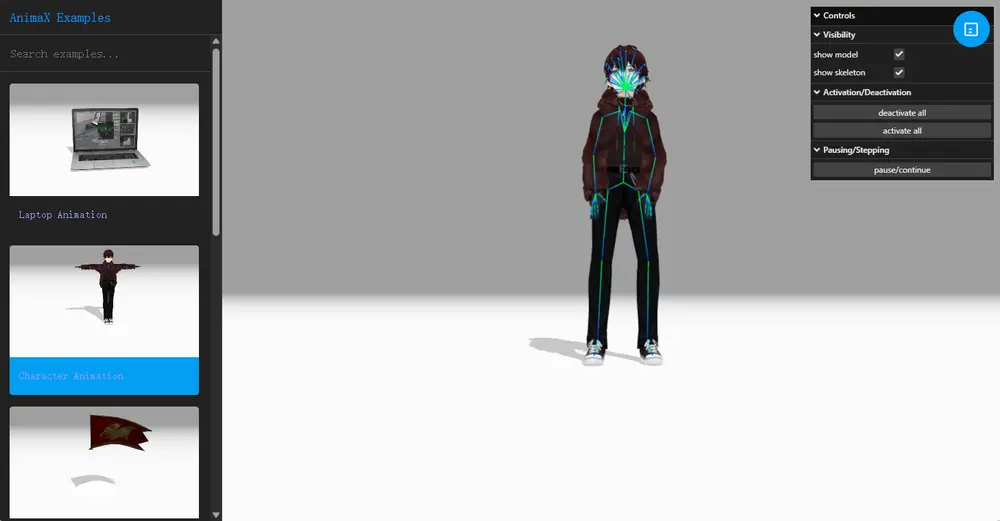

- 轻量级几何代理:使用简化地形和带有 alpha 通道的纹理平面,显著减少了几何复杂度,同时保持了视觉质量。

- RGBA 纹理合成:通过在代理上合成 RGBA 纹理,实现了逼真的视觉效果,避免了复杂几何建模和简化过程中的质量损失。

- 智能代理引导:利用基于视觉语言模型(VLM)的智能代理,自动解析文本提示,选择合适的场景元素并进行合理布局。

- 多感官体验:通过动态视觉效果和环境音效的补充,提供全方位的沉浸式体验。

工作原理

ImmerseGen 的工作原理包括以下几个关键步骤:

- 基础世界生成:从文本提示中检索合适的地形模板,并通过地形条件纹理化方案生成全景天空和 RGBA 地形纹理。

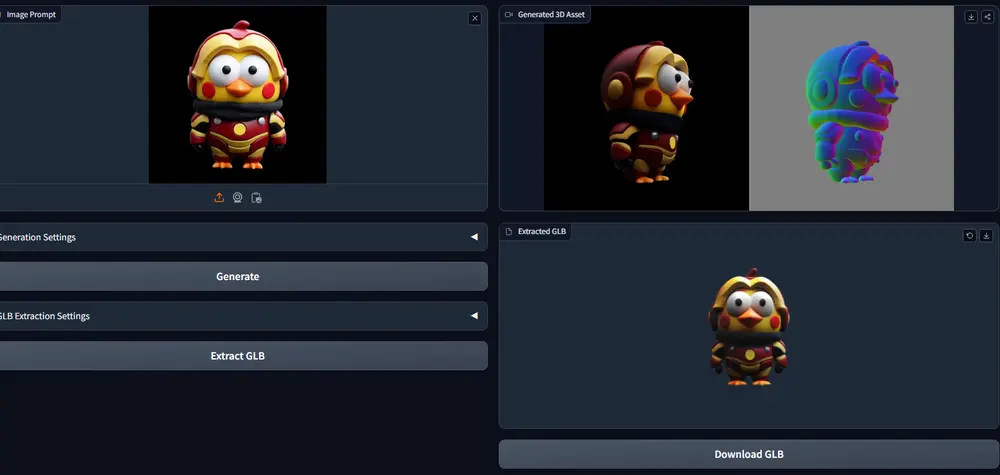

- 智能代理引导的资产生成:利用 VLM 基础的智能代理,解析文本提示,选择合适的场景元素模板,并生成详细的资产描述。

- 语义网格分析:通过语义网格分析,智能代理在 2D 观察基础上进行 3D 空间推理,确保资产的合理布局。

- 上下文感知的 RGBA 纹理合成:为每个资产生成上下文感知的 RGBA 纹理,确保与基础世界无缝集成。

- 多感官沉浸增强:通过添加动态视觉效果和环境音效,进一步增强沉浸感。

测试结果

- 定量评估:ImmerseGen 在多个评估指标上优于现有方法,包括 CLIP 相似度分数、美学分数和视觉质量分数。

- 定性评估:通过可视化生成的全景和透视视图,ImmerseGen 生成的场景在视觉质量和语义一致性方面表现优异。

- 用户研究:用户研究显示,ImmerseGen 在感知质量、真实感和文本对齐方面均优于其他基线方法。

- 实时性能:ImmerseGen 在 VR 设备上实现了平均 79 FPS 的实时渲染性能,显著优于其他方法。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...