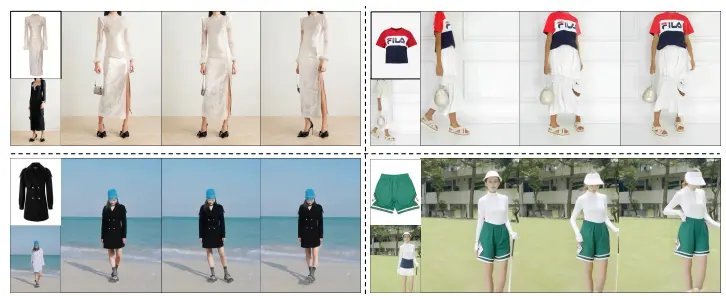

阿里巴巴达摩院、湖畔实验室和浙江大学的研究人员推出一种新型的基于扩散模型的视频试穿技术3DV-TON,旨在通过高质量和时间连贯的视频生成,让用户能够在视频中“试穿”不同的服装,而无需实际的物理试穿。

例如,你在电商平台上看中了一件衣服,但不确定它穿在自己身上的效果。3DV-TON技术可以将你上传的视频(比如一段简单的行走或转身视频)中的人物服装替换为目标衣服,并生成一段新的视频,让你直观地看到这件衣服穿在自己身上的效果,仿佛真的试穿了一样。

主要功能

- 视频试穿:将目标服装替换到视频中的人物身上,生成高质量的试穿视频。

- 保持时间连贯性:确保生成的试穿视频在时间上具有一致性,避免出现服装纹理或动作的跳跃。

- 服装细节恢复:精确恢复服装的纹理和细节,即使在复杂的动作和姿势变化中也能保持服装的真实感。

- 动态场景适应:能够处理各种复杂的场景和服装类型,包括不同类型的服装(如上衣、下装、连衣裙)和不同的动作(如行走、转身、跳跃)。

主要特点

- 基于纹理的3D引导:通过生成可动画化的纹理化3D网格作为帧级别的显式引导,解决了传统方法中因过度关注外观保真度而导致的动作连贯性问题。

- 适应性强的3D引导生成:能够自适应地生成与原始视频动作同步的纹理化3D网格,确保在空间和时间上的连贯性。

- 动态矩形遮罩策略:有效防止服装信息泄露,避免因人体动作导致的试穿失败。

- 高分辨率基准数据集:提出了一个高分辨率的视频试穿基准数据集HR-VVT,包含130个视频,涵盖了多种服装类型和复杂场景。

工作原理

- 选择关键帧:通过姿态估计选择一个关键帧,使用先进的基于扩散模型的图像试穿方法进行处理。

- 3D网格重建与动画化:基于选择的关键帧,重建纹理化的3D网格,并将其与原始视频的动作同步动画化,生成时间连贯的参考序列。

- 纹理化3D引导:将重建的3D网格作为纹理化3D引导输入到扩散模型中,确保生成的视频在外观和运动上的一致性。

- 特征提取与融合:使用特征提取器对服装图像和试穿图像进行编码,并通过自注意力机制将这些特征与3D引导融合,生成最终的试穿视频。

- 训练策略:模型在图像和视频数据集上进行训练,通过分类器自由引导(CFG)策略随机省略某些条件输入,以增强模型的鲁棒性。

应用场景

- 电子商务:帮助用户在购买服装前通过视频试穿直观地查看服装效果,提升购物体验。

- 虚拟试衣间:在虚拟试衣间中快速生成试穿视频,让用户能够实时查看不同服装的试穿效果。

- 服装设计:设计师可以快速生成不同设计的试穿视频,用于展示和评估服装设计。

- 社交媒体:用户可以生成有趣的试穿视频分享到社交媒体,增加互动性和娱乐性。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...