豆包正式接入 Seedance 2.0:支持原声音画同步与多镜头叙事

豆包宣布,字节跳动新一代视频生成模型 Seedance 2.0 已全面接入 豆包 App、电脑端及网页版。

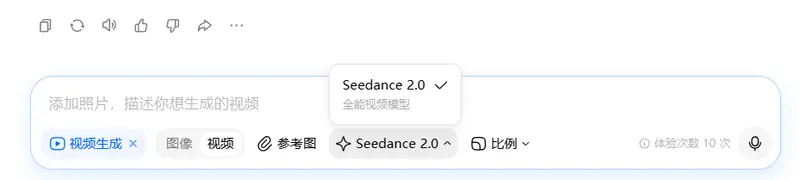

用户现在可在豆包对话框中直接选择 “Seedance 2.0” 入口,输入提示词,一键生成 5 秒或 10 秒 的高质量视频。若希望以自己为主角出镜,还可通过 “分身视频” 功能,在完成真人身份验证后创建专属数字人分身,解锁更多个性化创作玩法。

核心能力亮点

原声音画同步

Seedance 2.0 可生成包含完整原生音轨的视频,背景音、环境声、节奏感与画面动作严格对齐,无需后期配音。

多镜头长叙事

模型能自动解析提示词中的叙事逻辑,生成由多个镜头组成的连贯片段。角色形象、光影风格、整体氛围在全片中保持高度统一,接近专业短片水准。

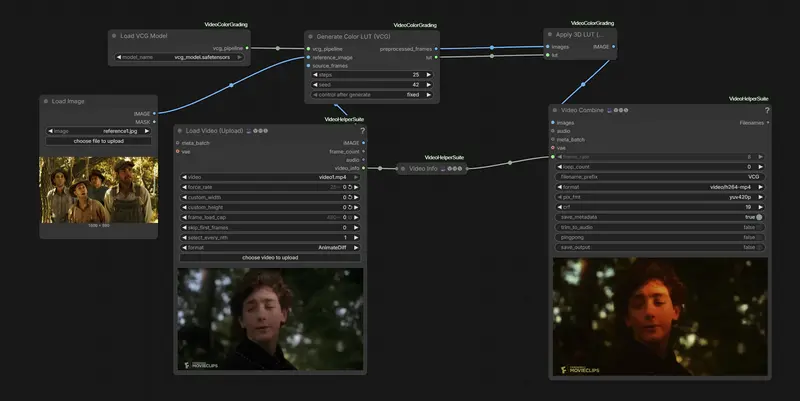

多模态可控生成

支持结合文本提示 + 参考图进行创作。系统将基于参考图理解构图、角色或风格,并据此生成符合预期的多镜头视频。

使用说明

- 入口位置:豆包 App / 网页版 / 电脑端 → 对话框 → 选择 “Seedance 2.0”

- 视频时长:支持 5 秒 或 10 秒 输出

- 分身功能:需通过真人验证,创建后可授权他人使用你的数字人形象

⚠️ 当前版本不支持上传含真人的图片作为主体参考。如需使用本人形象,请通过“分身视频”流程完成校验。

暂无评论...