Open LLM Vtuber - 最新版

Open-LLM-VTuber通过强大的功能和高度的可定制性,为用户带来了一个生动、智能且个性化的AI虚拟伴侣。无论你是技术爱好者还是普通用户,都能轻松上手并享受与AI互动的乐趣。

WarpTuber 是一个基于快手 LivePortrait 技术的即时虚拟直播工具,允许用户通过网络摄像头将自己的脸部表情和动作实时映射到静态图像或视频上,为内容创作、虚拟化身和直播提供便利。

5.6GB21 人已下载 手机查看

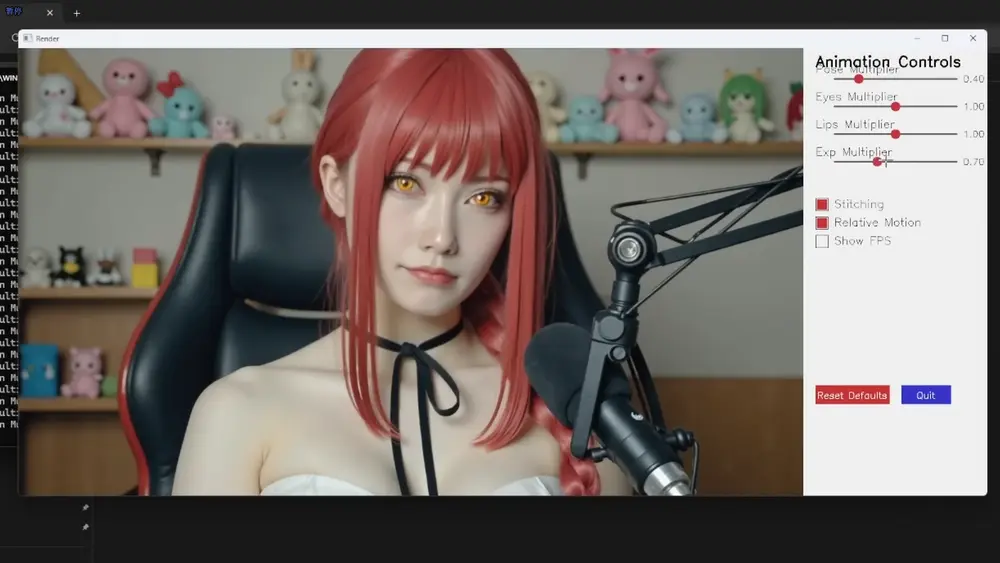

WarpTuber 是一款基于快手 LivePortrait 技术开发的实时面部动画工具,能够通过你的网络摄像头将静态图像和视频赋予生命。它允许用户将自己的脸部表情和动作即时映射到一张照片或角色图像上,从而创造出会动的虚拟形象。无论是虚拟化身、内容创作还是直播,WarpTuber 都能轻松应对。

1. 准备工作

venv 文件夹中)2. 选择启动选项

camera_image.bat。camera_video.bat。

使用静态图像 (camera_image.bat)

assets/examples/source/ 文件夹,并命名为 main.jpg。camera_image.bat。使用视频动画 (camera_video.bat)

assets/examples/source/ 文件夹,并命名为 main.mp4。camera_video.bat。main.jpg,并放置在 assets/examples/source/ 文件夹中。main.mp4,并放置在 assets/examples/source/ 文件夹中。最佳效果建议:

WarpTuber 依赖面部特征检测来动画化图像。并非所有图像都能正常工作,特别是:

如果遇到类似“no face in [image path]! exit!”的错误信息,说明系统未能在你的图像中检测到面部特征。

解决方案:

--animal 参数运行:camera_image.bat --animal命令行参数 两个批处理文件均支持附加参数:

--src_image [path] - 指定自定义源图像/视频路径。--animal - 启用动物面部模式。--paste_back - 启用背景保留(默认启用)。--interactive - 启用交互控制(默认启用)。--advanced_ui - 启用高级 UI 控制。示例:camera_image.bat --src_image assets/my_custom_folder/portrait.jpg --animal

TensorRT 优化 此存储库包含预编译的 TensorRT 模型以获得最佳性能。如果预含模型出现问题,你可能需要自行编译:

checkpoints 目录,找到现有的 .trt 文件:checkpoints/liveportrait_onnx/*.trtcheckpoints/liveportrait_animal_onnx/*.trtC:\FLivePort\WarpTuber\checkpoints\liveportrait_onnx\stitching_lip.trt.trt 文件。scripts/all_onnx2trt.bat 以重新编译所有模型。注意:仅当预编译模型在你的系统上无法工作时,才需要编译自己的 TensorRT 模型。编译过程会为你的 GPU 硬件创建优化的模型。

scripts/all_onnx2trt.bat 脚本为你的 GPU 编译模型。通过 WarpTuber,你可以轻松地将静态图像和视频变成生动的虚拟形象,无论是用于个人娱乐还是专业创作,都能带来全新的体验。