谷歌近期宣布将推出一项新的 AI 驱动功能,旨在更好地保护其平台(包括 YouTube)上的未成年用户。这一举措是谷歌为加强儿童网络安全所做的更广泛努力的一部分。

AI 判断用户年龄的功能

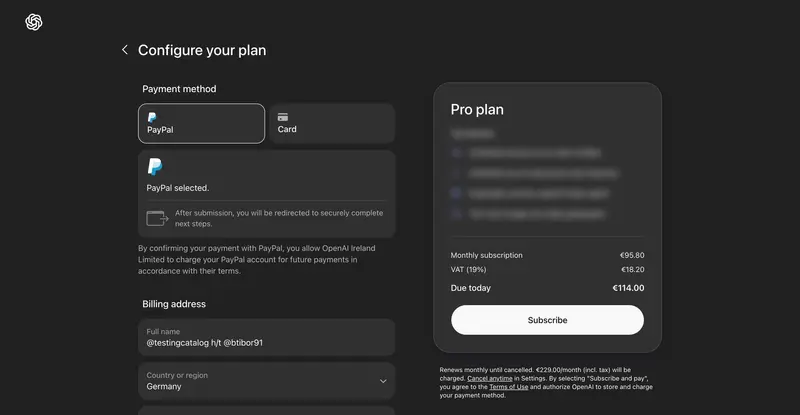

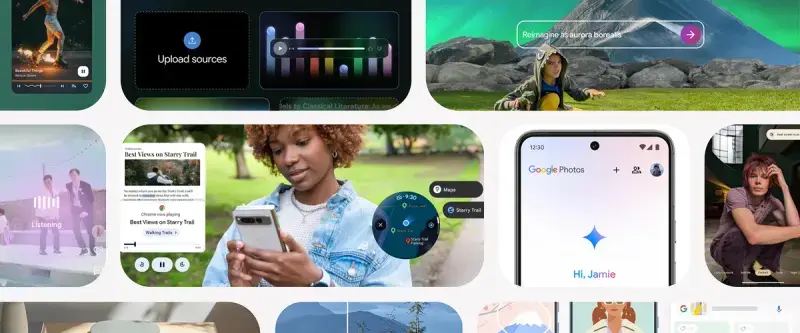

谷歌计划测试一种机器学习模型,该模型能够根据用户的活动(如搜索历史、视频偏好和账户年龄)来估算用户是否未满 18 岁。如果 AI 预测用户是未成年人,系统将自动应用适当的年龄过滤器,限制对成人内容的访问,并提供更安全、更适合未成年人的体验。

这一功能将于今年在美国进行测试,并预计在 2026 年在全球范围内推广。

YouTube 的新内容过滤功能

除了上述功能,YouTube 也将推出一项新功能,利用类似的AI技术来预测用户是否未成年,并据此应用内容限制,以过滤掉不适合年轻观众的成人内容。

家长控制功能的扩展

谷歌还在努力扩展其家长控制功能。此前仅在智能手表上提供的“上学时间”功能,现在将扩展到安卓手机和平板电脑。家长可以通过该功能限制孩子在上学期间可以使用的应用程序和功能,以减少干扰。

此外,谷歌还在 Google Messages 中推出了一项新的敏感内容警告功能。该功能对成年人是可选的,通过 Android 设置进行管理,但对于 18 岁以下的用户则是默认开启的,并且为受监督的账户提供家长控制。

谷歌的 AI 使用原则引发争议

谷歌最近取消了其此前承诺的“不将 AI 用于武器或监视”的原则,称需要参与重要的全球讨论和政府合同。谷歌表示,这一转变将有助于网络安全和生物学等领域的发展。然而,批评人士担心,这可能违背了谷歌在 2018 年设定的避免有害使用 AI 的道德标准。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...