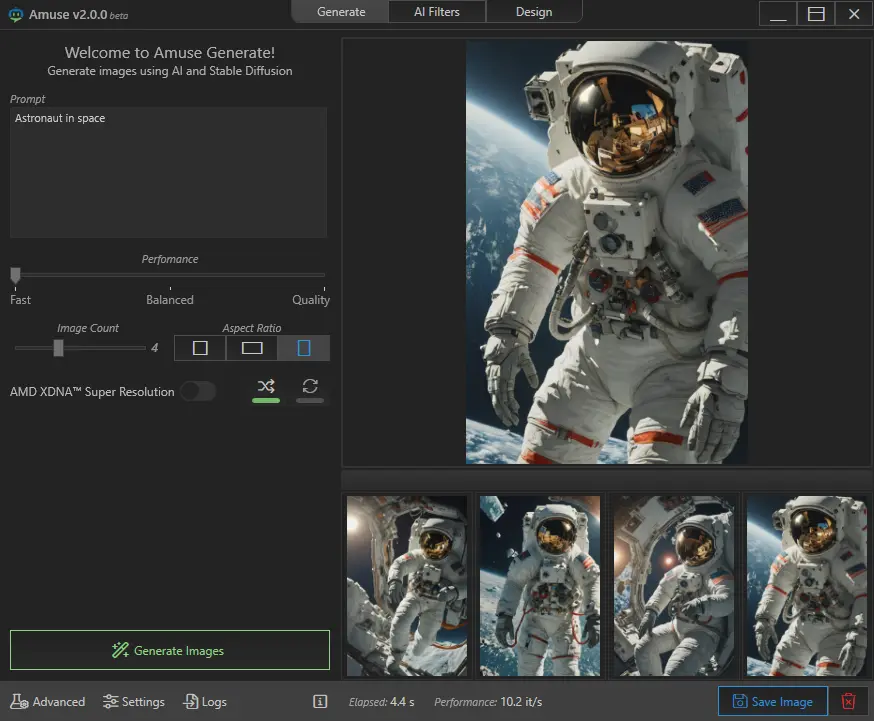

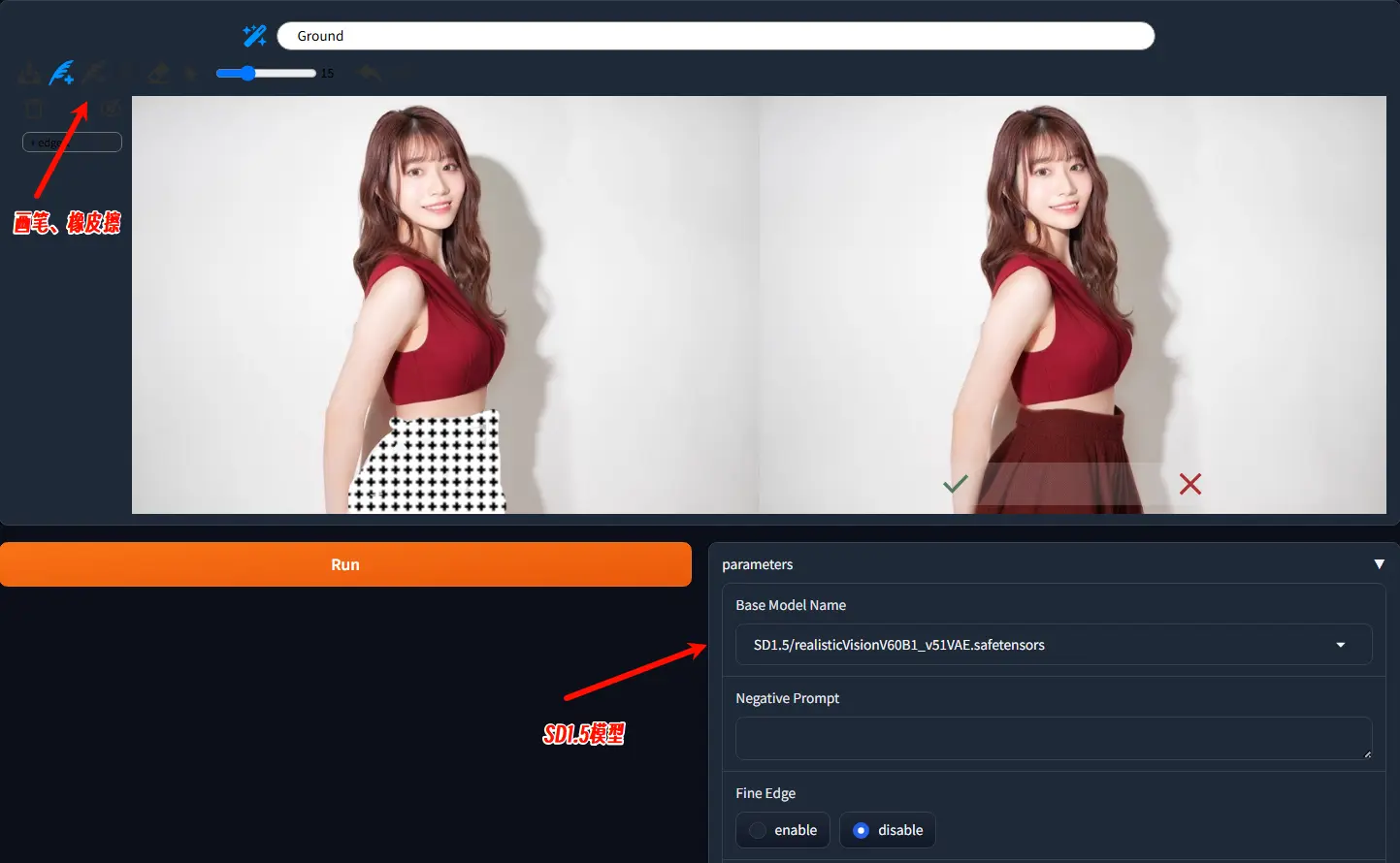

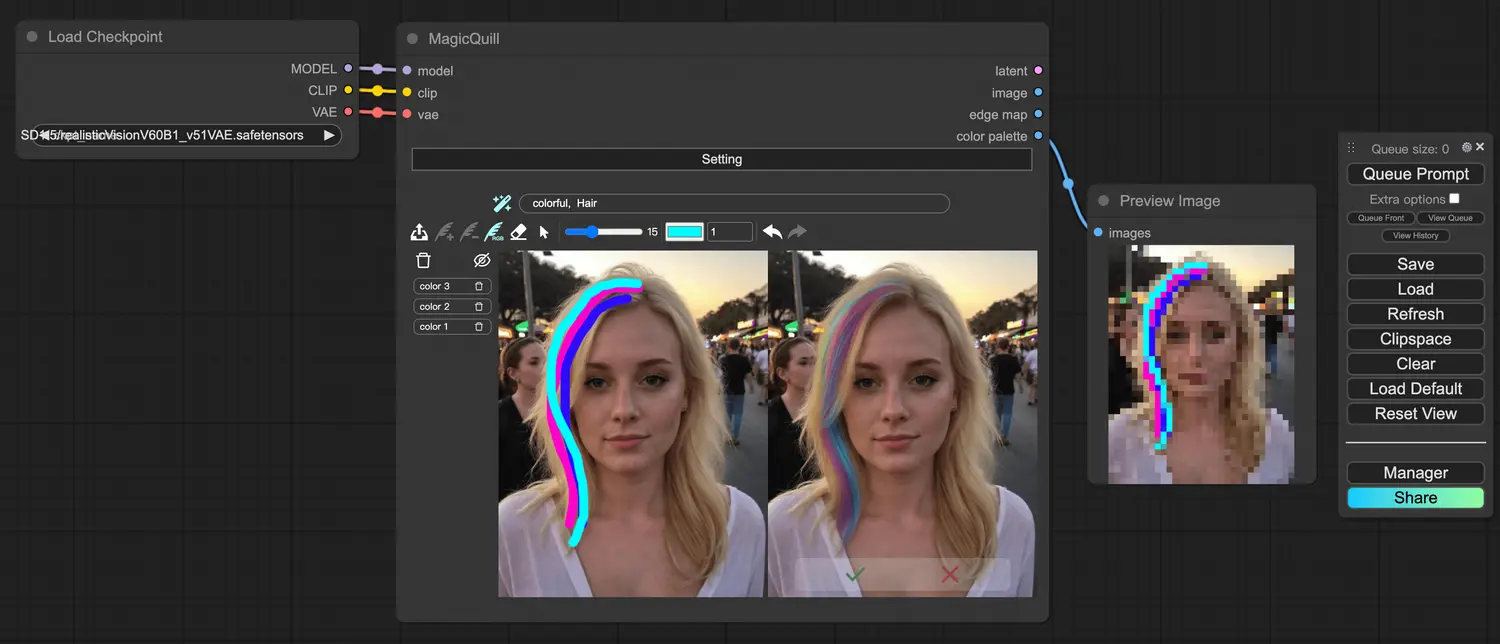

香港科技大学、蚂蚁集团、浙江大学和香港大学的研究人员推出智能交互式图像编辑系统MagicQuill,该系统基于扩散模型(SD1.5模型)构建,允许用户通过三种直观的笔触:添加(add)、减去(subtract)和上色(color)来无缝编辑图像(例如,插入元素、擦除对象、更改颜色)。MagicQuill的核心在于它能够通过多模态大语言模型(MLLM)实时预测用户的意图,从而避免了手动输入提示的需要。最终,系统应用强大的扩散先验,通过精心学习的双分支插件模块来精确控制编辑请求。

- 项目主页:https://magicquill.art/demo

- GitHub:https://github.com/magic-quill/magicquill

- Demo:https://huggingface.co/spaces/AI4Editing/MagicQuill

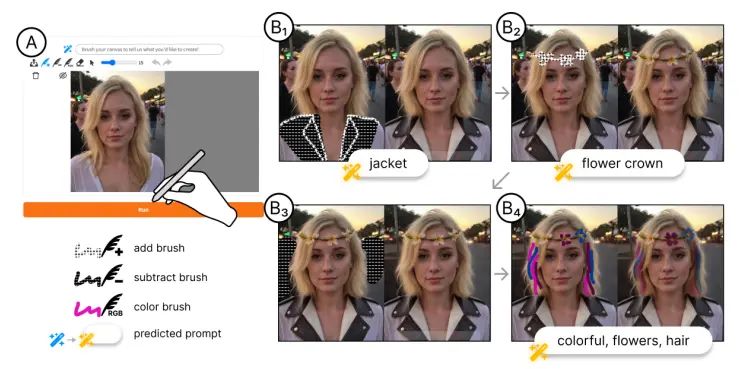

例如,用户想要编辑一张女士的肖像照片,具体需求包括:将衬衫变为定制设计的夹克、在精确位置添加设计好的花冠、将部分头发染成特定颜色以及移除背景的某些部分以提升外观。MagicQuill能够通过用户的笔触预测其意图,并自动生成所需的图像编辑结果。

主要功能:

- 直观的笔触编辑: 用户可以通过简单的笔触来表达他们的编辑意图,如添加元素、擦除对象或改变颜色。

- 实时意图预测: 系统通过MLLM分析用户的笔触,基于图像上下文自动预测并生成编辑提示。

- 精确控制的图像编辑: 系统使用双分支插件模块来处理编辑请求,确保编辑的精确性和控制性。

主要特点:

- 减少了用户在编辑工作流程中输入文本提示的重复过程。

- 通过“Draw&Guess”任务,实现了连续的编辑工作流程,使用户能够迭代地编辑图像,而无需手动输入提示。

- 提供了一个用户友好的界面,允许用户快速轻松地输入他们的创意。

工作原理

MagicQuill的工作原理包括以下几个关键步骤:

- 笔触信号转换: 用户的笔触被转换成控制条件,用于编辑处理器中,以实现精确的结构和颜色修改。

- MLLM意图预测: 通过分析用户笔触和图像上下文,MLLM预测用户的编辑意图,并自动生成编辑提示。

- 图像编辑处理: 使用扩散模型和双分支架构(包括修复分支和控制分支),根据用户控制条件进行精确的图像编辑。

具体应用场景

MagicQuill可以应用于多种场景,包括但不限于:

- 个人照片编辑: 用户可以轻松地对个人照片进行细节修改,如改变服装、添加配饰或调整背景。

- 专业图像设计: 设计师可以利用MagicQuill进行高效的图像创作和编辑,实现快速迭代和精确控制。

- 在线内容创作: 社交媒体用户可以使用MagicQuill在线编辑和创作图像内容,如制作定制的图形或插图。

- 教育和培训: 在教育领域,MagicQuill可以作为教学工具,帮助学生理解图像编辑的基本概念和技巧。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...