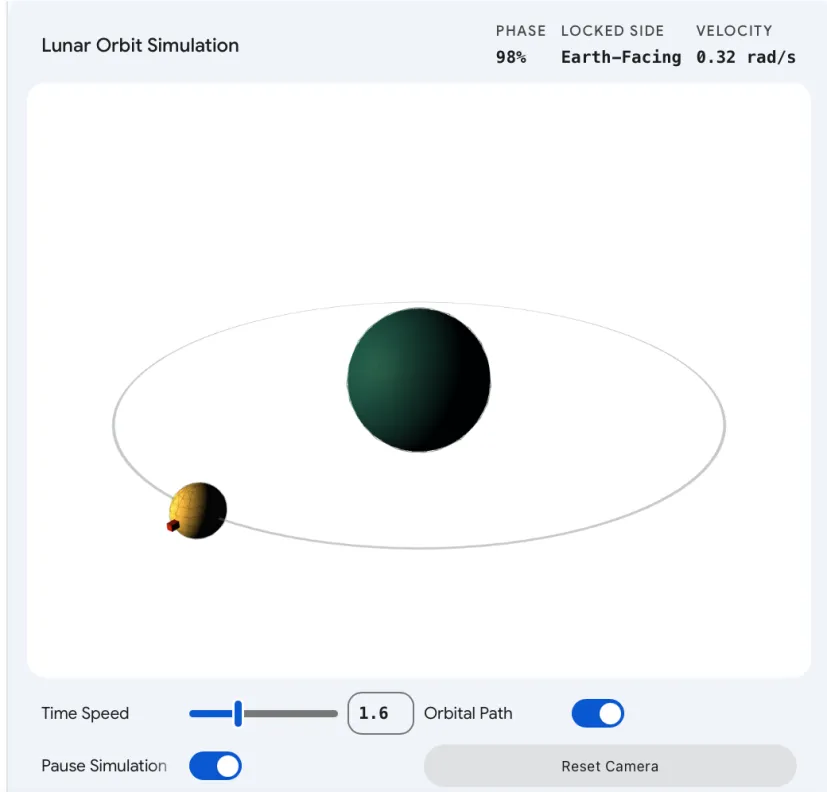

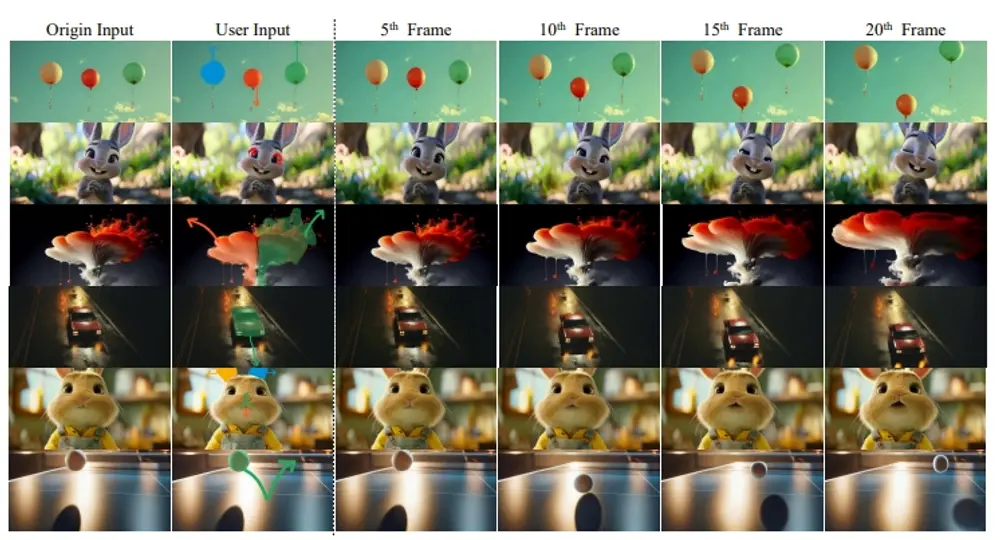

北京航空航天大学和爱诗科技的研究人员推出新型视频生成方法TrackGo,它能够根据用户的输入精确控制视频中对象的运动。这项技术允许用户通过自由形式的遮罩(masks)和箭头来指定目标对象或部分,以及它们期望的运动轨迹,然后TrackGo能够生成具有精确控制的后续视频帧。

例如,一个用户想要制作一段视频,其中包含一辆汽车在道路上行驶的场景,他们可以使用TrackGo来指定汽车的图片,绘制一个遮罩覆盖汽车,并用箭头指示汽车行驶的轨迹。然后,TrackGo就能够生成一系列视频帧,显示汽车沿着指定轨迹移动,同时保持背景的连贯性和自然性。这种方法提供了一种非常直观和灵活的方式来控制视频内容的生成。

主要功能:

- 用户指定控制:用户可以通过遮罩和箭头来指定视频中的目标对象和运动轨迹。

- 视频帧生成:根据用户的指定生成视频的后续帧。

主要特点:

- 灵活性:用户可以精确地指定从整个对象到部分区域的运动。

- 精确性:TrackGo能够根据用户的方向指导生成视频,保持目标对象的连贯运动。

- 高效性:通过TrackAdapter实现的控制机制既高效又轻量级,不会显著增加模型参数或推理时间。

工作原理:

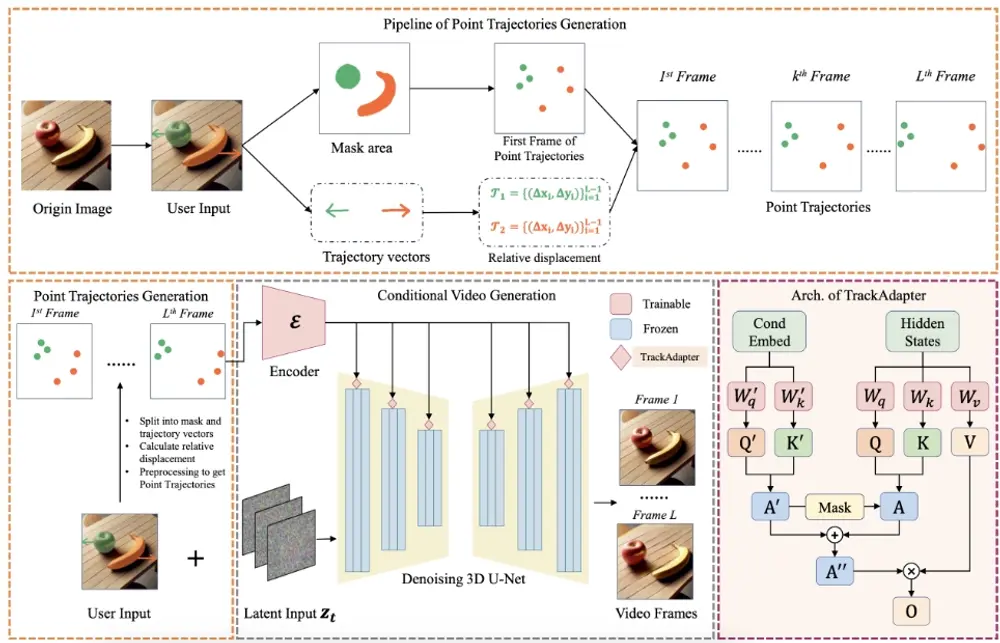

- 用户输入:用户给出初始帧,并用遮罩指定目标区域,用箭头指示运动方向。

- 点轨迹生成:TrackGo从用户定义的遮罩和箭头中自动提取点轨迹,这些轨迹作为视频生成的精确蓝图。

- 条件视频生成:使用稳定的视频扩散模型(Stable Video Diffusion Model, SVD)作为基础模型,并结合编码器将运动信息编码,通过TrackAdapter将这些信息注入到预训练的视频生成模型中。

具体应用场景:

- 电影制作:在电影后期制作中,可以用来生成或修改特定对象的运动。

- 卡通创作:动画师可以使用这项技术来控制动画中的角色或物体的运动。

- 虚拟现实:在虚拟现实环境中生成与用户交互一致的视频内容。

- 游戏开发:用于生成游戏中的动态场景和角色动画。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...