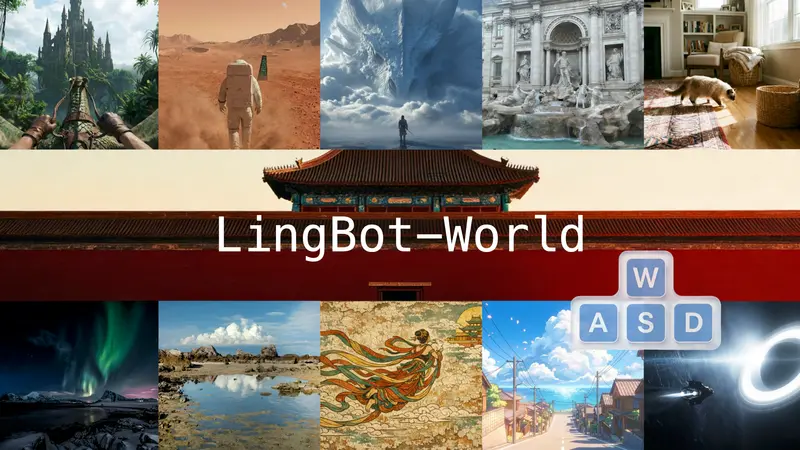

蚂蚁灵波科技正式开源 LingBot-World —— 一个基于视频生成技术构建的交互式世界模拟器。它不是简单的视频合成工具,而是一个能响应用户动作、维持物理逻辑、保持长期一致性的动态虚拟世界框架。项目包含核心模型 LingBot-World-Base 和实时推理版本 LingBot-World-Fast,代码与模型均已开放,旨在推动世界模型技术在开源社区的发展。

- 项目主页:https://technology.robbyant.com/lingbot-world

- 模型:https://modelscope.cn/models/Robbyant/lingbot-world-base-cam

核心目标:从“看视频”到“玩世界”

传统视频生成模型输出的是被动、静态的序列,无法响应外部输入,也难以保证长时间运行的一致性。LingBot-World 则致力于构建一个可交互、可控制、可预测的模拟环境,适用于游戏开发、机器人仿真、虚拟内容创作等需要闭环反馈的场景。

其背后由一个可扩展数据引擎(Scalable Data Engine)驱动——该引擎将游戏引擎视为无限数据源,从中学习物理规律、因果关系与空间逻辑,使模型不仅能“画出”世界,更能“理解”世界如何运转。

关键能力详解

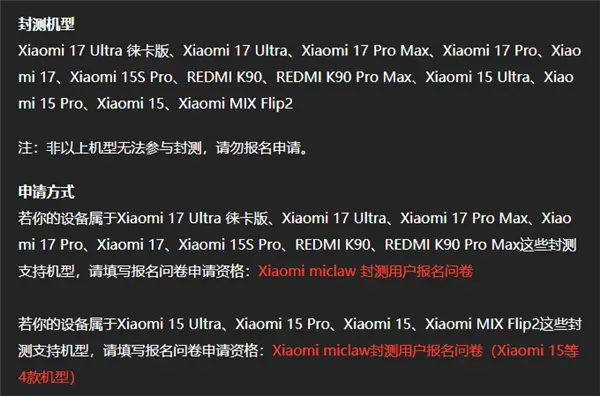

1. 高保真、多样化环境生成

LingBot-World 能在多种风格下保持高质量输出,包括:

- 写实风格(如城市街道、室内场景)

- 科学可视化(如分子结构、流体模拟)

- 卡通或抽象风格(如动画片、游戏关卡)

无论风格如何变化,动态表现均保持稳健,避免常见的画面崩坏或纹理闪烁问题。

2. 动作驱动的精准控制

模型采用 action-conditioned generation(动作条件生成)机制。用户输入指令(如“向左转”“加速前进”),系统会据此生成符合物理规律的下一帧画面,而非随机“幻觉”。这种设计确保了交互的可预测性与可控性。

3. 分钟级长时序一致性

通过增强的上下文建模能力,LingBot-World 能在数分钟的时间跨度内维持:

- 结构完整性:建筑、地形不会无故变形

- 物体恒存性(Object Permanence):离开视野的物体依然存在

- 叙事连贯性:事件发展符合逻辑,不会突兀跳转

4. 动态屏外记忆

这是长时序一致性的关键延伸。例如,当一只猫跑出画面后,模型不会将其“遗忘”,而是持续推断其在屏外的行为(如继续奔跑、躲藏)。当镜头切回时,猫的位置和状态是自然演进的结果,而非静止或随机重生。

5. 基于物理的真实约束

模型内置碰撞检测与动力学规则,有效防止“穿模”、穿墙、悬浮等违反物理常识的行为。所有运动都遵循空间逻辑,确保模拟结果具备真实感,而非仅视觉上合理。

6. 实时交互能力

由 LingBot-World-Fast 驱动的推理版本,在 16 FPS 下实现端到端延迟低于 1 秒,支持实时闭环控制。这意味着用户可以像操作游戏一样与生成世界互动,每一次操作都能获得及时、合理的反馈。

7. 涌现的复杂行为

随着模型规模扩大,团队观察到超越基础视频生成的能力开始“涌现”——例如智能体自主避障、多物体协同运动、环境对扰动的自适应调整。这表明模型已初步掌握空间、时间与因果的深层关联。

当前局限与未来方向

尽管能力突出,LingBot-World 仍面临现实挑战:

- 硬件门槛高:推理需企业级 GPU(如 A100/H100),消费级设备难以运行

- 长期稳定性不足:记忆依赖上下文窗口,长时间运行易出现“环境漂移”(environmental drifting),即场景结构逐渐失真

- 控制粒度有限:目前仅支持基础导航指令,尚不能执行抓取、组装等精细操作

- 保真度与速度的权衡:为实现实时性能采用因果蒸馏(causal distillation),部分牺牲了视觉细节

未来规划包括:

- 引入显式记忆模块,替代当前的隐式上下文记忆,提升长期稳定性

- 扩展动作空间与物理引擎,支持更复杂的交互(如物体操控、工具使用)

- 消除“生成漂移”,目标是实现可无限运行的稳健模拟环境

开源意义与应用场景

LingBot-World 的开源,填补了开源社区在高保真交互式世界模型领域的空白。其潜在应用包括:

- 游戏开发:快速生成可交互的关卡原型或 NPC 行为

- 机器人训练:在逼真虚拟环境中预训练感知与决策模块

- 影视与广告:自动化生成带物理逻辑的动态场景

- 教育仿真:构建科学实验或历史场景的交互式演示

通过开放代码与模型,蚂蚁灵波希望推动世界模型从“展示型 AI”走向“行动型 AI”,让虚拟世界真正成为可探索、可干预的第二现实。

相关文章