近日,Meta 修复了一个严重的安全漏洞。该漏洞可能导致用户访问并查看其他用户的 AI 提示(prompt)和生成内容,存在隐私泄露风险。

这一漏洞由安全测试公司 AppSecure 创始人 Sandeep Hodkasia 发现,并独家向 TechCrunch 披露。据 Hodkasia 介绍,他在 2024 年 12 月 26 日向 Meta 报告了该问题,Meta 随后于 2025 年 1 月 24 日完成修复。作为漏洞赏金计划的一部分,Meta 向 Hodkasia 支付了 1 万美元奖励。

漏洞原理:提示编号可被猜测

Hodkasia 在研究 Meta AI 聊天机器人编辑功能时发现了该漏洞。当用户编辑 AI 提示以重新生成文本或图像时,Meta 后端会为每条提示及其生成内容分配一个唯一编号。

通过分析浏览器在编辑提示时的网络请求,他发现只需修改该编号,就能获取其他用户的提示和生成内容。这意味着 Meta 的服务器在访问控制方面存在疏漏——未验证请求者是否有权限查看对应数据。

更严重的是,这些编号并非随机生成,而是具有可预测性。攻击者可通过自动化工具批量尝试不同编号,从而抓取大量用户的私密信息。

Meta 回应:未发现滥用证据

TechCrunch 联系 Meta 时,该公司确认已于 1 月完成修复。Meta 发言人 Ryan Daniels 表示,目前没有发现该漏洞被恶意利用的证据,并对 Hodkasia 的发现表示感谢。

背景:AI 隐私安全仍是挑战

此次漏洞曝光正值各大科技公司加速推出 AI 产品之际。尽管 AI 技术发展迅速,但围绕数据隐私和访问控制的问题依然突出。

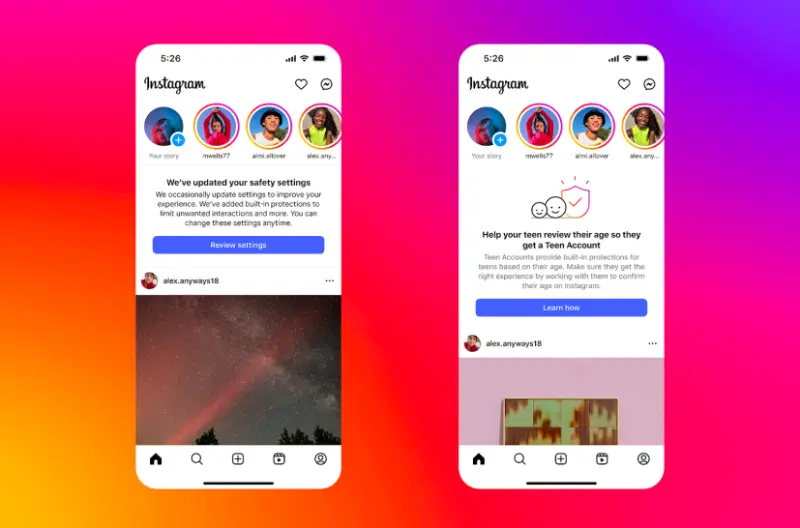

Meta AI 的独立应用程序在今年早些时候上线,旨在与 ChatGPT 等竞品竞争。然而,推出初期就因部分用户误将私密对话设为公开而引发争议。

此次事件再次提醒:在推动 AI 普及的过程中,保障用户数据安全仍是不可忽视的底线。

相关文章