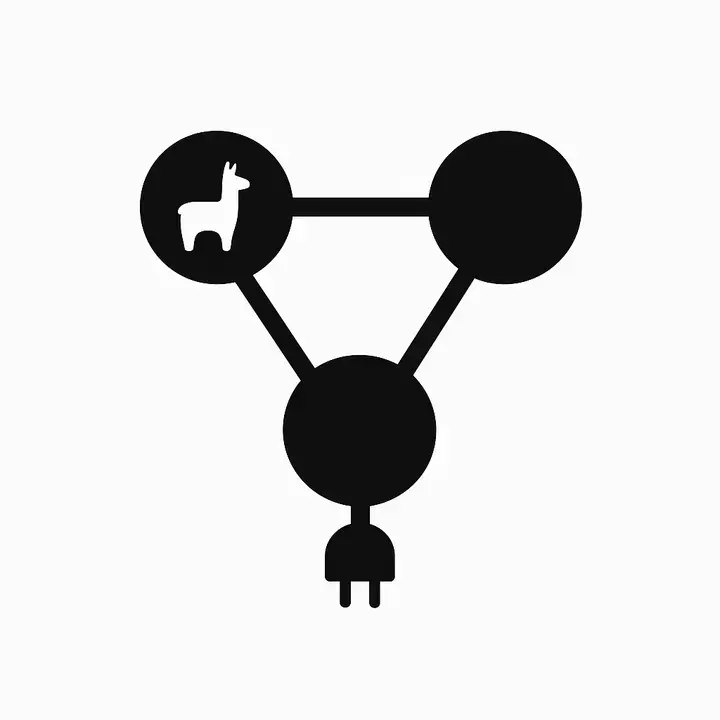

LlamaIndex 团队正式发布了 Workflows 1.0 —— 一个用于构建多步骤、事件驱动的 AI 应用的轻量级框架。该版本现已支持 Python 和 TypeScript,标志着这一工具从 LlamaIndex 生态中独立出来,成为一套专注于任务编排与流程控制的通用系统。

此次发布不仅带来了稳定性提升和新功能支持,也意味着 Workflows 正式成为一个独立项目,适用于任何需要复杂 AI 流程管理的开发者和团队。

Workflows 是什么?

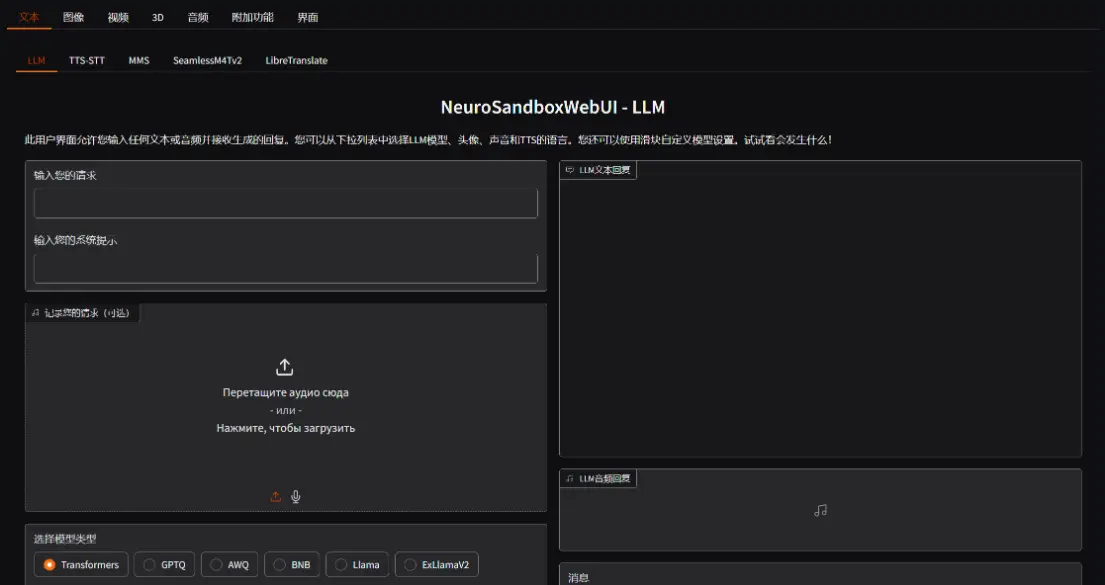

LlamaIndex Workflows 是一个用于编排复杂 AI 系统流程的框架,帮助开发者定义、执行和监控涉及多个步骤、模型和决策点的智能应用。

其核心特点包括:

- 异步优先(async-first)

- 事件驱动架构(event-driven)

- 状态管理(state management)

- 可观测性集成(observability support)

这种设计使得开发者可以轻松实现并行处理、循环流程、条件路由等高级行为,非常适合构建生产级别的 AI 应用。

能用 Workflows 做什么?

Workflows 在协调涉及大型语言模型(LLM)、API 和人工干预的多步骤流程方面表现出色。以下是几个典型应用场景:

🤖 AI 代理系统

创建具备推理能力、能够自主决策并在多个步骤中执行动作的智能代理。

📄 文档处理流水线

构建自动化流程,完成文档的摄入、分析、摘要和分发,适用于知识库构建或企业内部数据流转。

🧠 多模态 AI 应用

协调 LLM、视觉模型等多种 AI 模型,协同完成如图像描述生成、跨模态检索等任务。

🔍 研究助手

开发能自动搜索、整合信息并输出结构化报告的研究辅助系统。

🎭 多角色代理协作

构建可在不同代理之间切换职责、动态分配任务的智能系统。

✍️ 内容生成与审核流程

搭建从内容创作、编辑到发布的完整链条,支持人工审批环节。

💬 客户服务自动化

实现对客户请求的理解、分类与响应,打造智能化客服流程。

为什么现在要独立发布?

虽然 Workflows 曾是 llama_index 和 LlamaIndexTS 的一部分,但随着社区对其潜力的认可,它已成长为一个具有独立定位的项目:

- ✅ 脱离依赖限制:不再绑定于 LlamaIndex 核心库,可广泛应用于各类 Python/TypeScript 项目。

- ✅ 模块化更清晰:代码仓库、包名、API 设计更加聚焦,便于维护和扩展。

- ✅ 鼓励社区贡献:为开发者提供更开放的参与空间,推动创新与实验。

目前,Python 版本可通过 pip 安装:

pip install llama-index-workflows

TypeScript 版本可通过 npm 或你喜欢的包管理器安装:

npm i @llamaindex/workflow-core

GitHub 仓库地址如下:

- Python 版:https://github.com/run-llama/workflows-py

- TypeScript 版:https://github.com/run-llama/workflows-ts

1.0 版本的核心更新

尽管底层架构未发生重大变化,1.0 版本在易用性和扩展性上进行了多项改进:

✅ 类型化工作流状态(Typed State)

无论是 Python 还是 TypeScript,开发者都可以使用类型安全的状态对象,在流程中传递结构化数据。

✅ 资源注入(Resource Injection)

Python 工作流支持运行时注入外部资源,如数据库连接、缓存客户端等,增强灵活性。

✅ 可观测性支持(Observability Integration)

通过 llama-index-instrumentation 插件,开发者可将工作流接入 OpenTelemetry、Arize Phoenix 等工具,实现全面的监控与调试。

展望未来

Workflows 1.0 的发布只是一个开始。随着 AI 应用越来越复杂,流程控制和系统编排将成为关键能力。LlamaIndex 团队表示将持续投入资源,进一步完善可观测性、可视化流程图、错误恢复机制等功能。

同时,他们也欢迎更多开发者加入贡献行列,共同打造一个强大而灵活的 AI 编排生态。

相关文章