OpenAI首席执行官萨姆·奥尔特曼(Sam Altman)曾公开表示,人类距离开发出能够自动化大部分劳动的通用人工智能(AGI)可能只有几年时间。如果这一预测属实,那么我们不仅应关注技术本身,更应深入思考——谁在主导这项技术?他们是否值得信任?

正是基于这样的问题意识,两个非营利性技术监督组织——Midas项目和Tech Oversight项目——联合推出了“OpenAI档案”项目。该项目记录并揭示OpenAI在治理结构、领导层诚信及组织文化方面的关键信息,推动公众对AI权力集中趋势的关注,并为未来建立更具责任感的AI治理模式提供方向。

OpenAI档案的目标:透明、问责与责任

OpenAI档案并非简单的批评工具,而是一个系统性的记录与分析平台。它希望达成以下几个目标:

- 提高公众对AI治理议题的认知;

- 推动OpenAI及其他AI领先企业建立更高标准的道德领导机制;

- 为行业提出负责任的发展路径,确保AGI的利益惠及全人类。

正如《变革愿景》中所写:

“指导如此重要项目的治理结构和领导诚信必须反映使命的重大性和严肃性。”

AGI竞赛中的代价与风险

在当前的AI主导权竞赛中,一种“不惜一切代价扩张”的思维正在蔓延。这种心态导致了以下问题:

- 未经授权的内容采集:大量训练数据被用于模型训练,未获得创作者同意。

- 基础设施快速扩张:大型数据中心建设引发当地电力供应紧张,居民面临电费上涨和停电困扰。

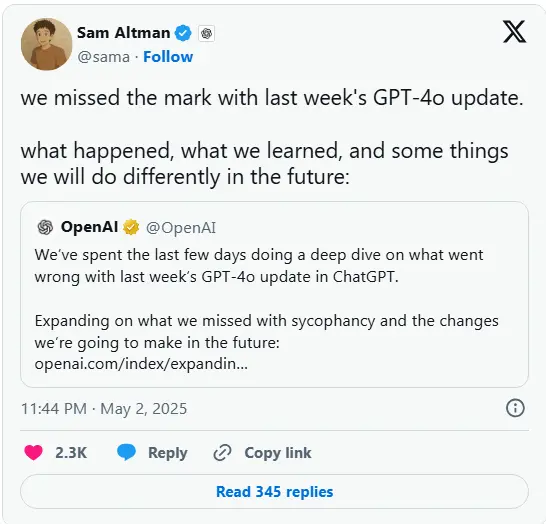

- 产品仓促上线:在安全措施尚未完善的情况下,急于商业化以满足投资者盈利需求。

这些现象反映出一个问题:当AI发展的核心动力是资本而非责任时,公众利益往往被边缘化。

利益冲突与治理结构的变化

OpenAI档案特别指出,公司早期曾设立“100倍利润上限”,承诺即使投资方出资,其回报也不得超过原始投资金额的100倍,以防止AGI成为少数人牟利的工具。

但近年来,OpenAI宣布取消这一限制,理由是为了吸引外部资金支持。这一变化引发了外界对其治理理念是否偏离初心的质疑。

此外,档案还列举了奥尔特曼个人投资组合中一些与OpenAI业务存在潜在重叠的初创公司,进一步加深了对其是否存在利益冲突的担忧。

安全评估与组织文化的隐忧

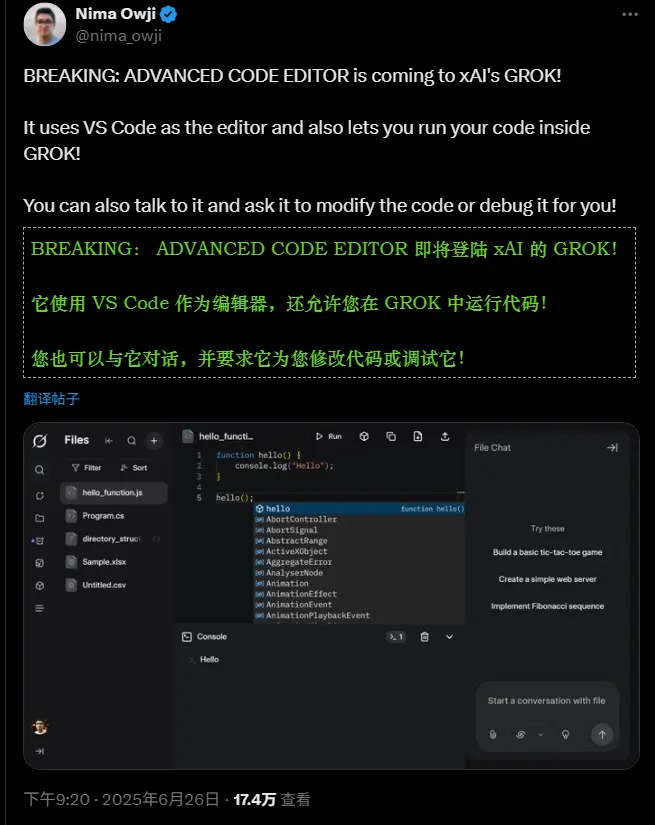

除了治理结构的问题,OpenAI档案还揭露了公司在安全评估流程上的仓促态度,以及内部存在的一种被称为“鲁莽文化”的氛围。

2023年,公司高层曾试图罢免奥尔特曼,部分原因在于他被认为具有“欺骗性和混乱行为”。前首席科学家伊利亚·苏茨凯弗(Ilya Sutskever)当时就表示:

“我认为萨姆不是那个应该掌控AGI的人。”

这番话不仅是对一个人的质疑,更是对整个AI治理体系的深刻反思。

从必然性到问责制:我们需要怎样的AI未来?

OpenAI档案的价值,在于它提供了一个难得的机会,让我们得以窥见这个原本封闭的黑箱。它提醒我们:

巨大的权力掌握在极少数人手中,而透明度和监督却极其有限。

在AGI即将改变世界的门槛前,我们不能再将技术进步视为理所当然。相反,我们必须追问:谁来决定它的方向?谁来承担它的后果?谁又能确保它服务于公共利益?

档案的推出,是对这些问题的一次有力回应。它不只是一个记录,更是一场关于AI治理未来的对话起点。

相关文章