你有没有想过,AI聊天机器人背后到底需要多少电力支持?随着 ChatGPT、通义千问、Claude 等大模型的普及,AI正在以前所未有的速度扩张,而它对电力的需求,也在迅速攀升。

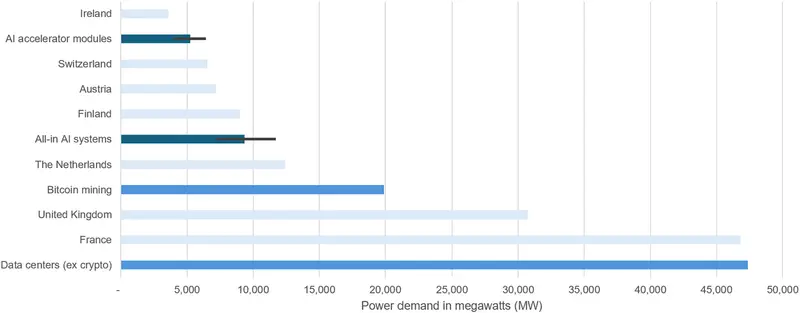

最新研究预测:到2025年底,AI可能将占据全球数据中心近一半的电力消耗,甚至超过比特币挖矿,成为新的“能耗大户”。

这项研究来自阿姆斯特丹自由大学环境研究所的博士候选人 Alex de Vries-Gao,他长期追踪加密货币的能耗问题,如今将目光转向 AI。

🔋 AI 的用电量有多惊人?

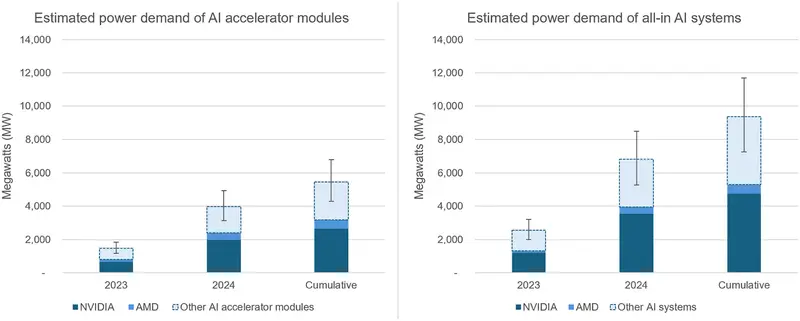

根据 de Vries-Gao 的估算:

- 当前,AI已经占到了全球数据中心约 五分之一的电力消耗;

- 到 2025 年底,这一数字可能接近 英国全国的用电量,即约 23GW(吉瓦);

- 这相当于荷兰整个国家一年的用电总量。

这些数字听起来令人震惊,但它们并非凭空而来。de Vries-Gao 通过分析 AI 芯片供应链、公司财报电话会议内容以及硬件制造数据,采用“三角测量法”推算出 AI 设备的实际耗电量。

🏭 数据中心激增,电网压力加剧

随着大型科技公司不断追求“更大更强”的 AI 模型,全球范围内 AI 数据中心的数量正在飞速增长,尤其是在美国。

为了满足 AI 巨大的电力需求,一些能源公司已经开始规划新建燃气电厂,甚至重启核能项目。

这带来的问题是:

- 电力需求突增可能给电网带来巨大压力;

- 可能延缓向清洁能源的过渡;

- 类似于比特币挖矿曾引发的能源争议。

🧩 与比特币有何相似之处?

虽然 AI 和比特币在用途上截然不同,但在能源消耗方面,却有着惊人的相似性:

- “越大越好”的思维模式

- 区块链领域曾追求更高的哈希率;

- AI 领域则追求更大的模型规模,以获得更强性能。

- 缺乏透明度

- 比特币挖矿的能耗一度难以追踪;

- 如今,AI 公司也不愿公开其模型的具体用电数据。

- 环境影响不明

- 同样的 AI 查询,在不同地区运行,碳排放差异可能高达两倍;

- 这取决于当地电网的能源结构(是否依赖化石燃料)。

📊 科技公司的“绿色承诺”能否兑现?

许多大型科技公司都设定了碳中和目标,并在年度可持续发展报告中披露温室气体排放情况。

例如:

- 谷歌 和 微软 近年来碳足迹上升,部分原因就是 AI 训练和推理任务的增加;

- 然而,这些报告通常不会明确区分 AI 与其他业务的能耗贡献。

这也让外界更难评估 AI 对环境的真实影响。

💡 效率提升能否遏制电力需求?

尽管 AI 技术在进步,芯片效率也在提高,但一个经济学原理提醒我们:Jevons 悖论——技术越高效,人们使用得越多,总体消耗反而可能上升。

例如,今年早些时候 DeepSeek 宣称其新模型仅需 Llama 3.1 模型 1/7 的能耗,引发了关于 AI 是否必须如此高能耗的讨论。

但现实是,很多公司仍倾向于用更多计算资源训练更大模型,而不是优先开发更节能的方案。

🔄 未来趋势:如何平衡 AI 发展与能源消耗?

要解决这个问题,有几个关键方向:

- 提高透明度:科技公司应公开 AI 的具体能耗数据;

- 推动本地化绿色能源:在可再生能源丰富的地区部署 AI 数据中心;

- 鼓励高效模型研发:从“越大越好”转向“更聪明、更省电”;

- 政策引导与监管:政府可通过税收、补贴等方式引导行业可持续发展。

AI正在改变世界,但它也带来了新的挑战。从能源消耗的角度来看,我们正处于一个关键节点。

相关文章