AIO Sandbox

AIO Sandbox 是一个一体化的 Agent 沙盒环境,在单个 Docker 容器中结合了浏览器、Shell、文件、MCP 操作和 VSCode Server。基于云原生轻量级沙盒技术构建,它为 AI Agent 和开发者提供了统一的沙盒环境。

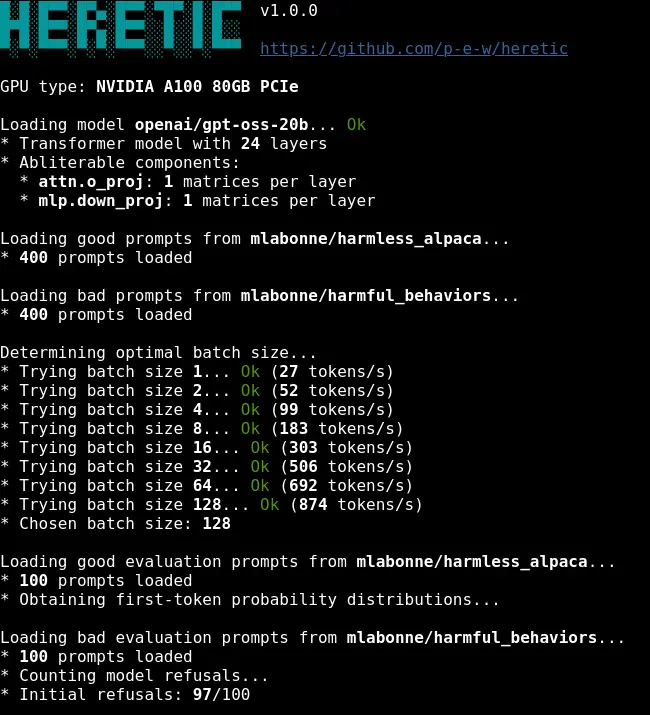

Heretic 是一款开源工具,通过参数消融(parameter ablation)技术,在不进行后训练的前提下,降低语言模型对特定提示的拒绝率(即减少“安全对齐”行为),同时最大限度保留原始模型的语言能力。

该工具基于 方向性消融(directional ablation,又称 “abliteration”)方法,并结合 Optuna 的 TPE 优化器,实现全流程自动化:从拒绝方向识别、消融参数搜索,到模型生成与评估,均无需人工干预。

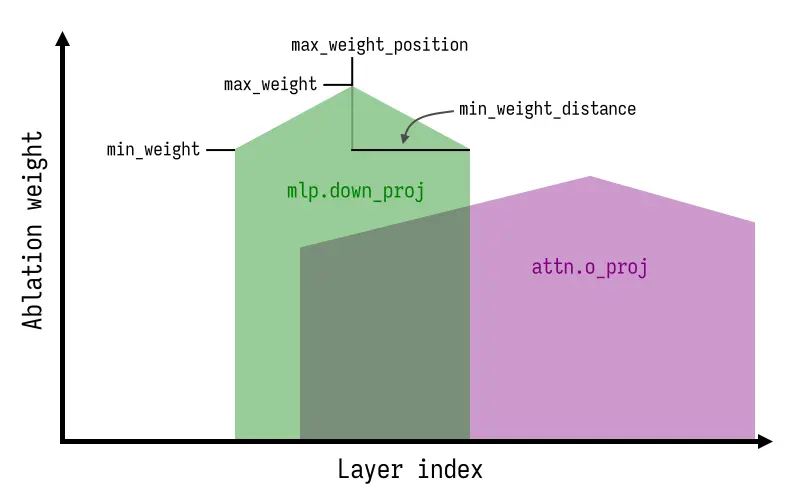

Heretic 在模型的每层 Transformer 中识别与“拒绝行为”相关的方向(通过对比有害/无害提示的首 token 残差均值差计算),并对关键组件(如注意力输出投影、MLP 降维层)的权重矩阵进行正交化处理,削弱该方向的激活。

其创新点包括:

在 Gemma-3-12B-Instruct 模型上的测试显示,Heretic 去对齐版本在保持同等低拒绝率(3/100)的同时,对原始模型的 KL 散度显著更低,表明其输出分布更接近原模型:

| 模型 | 有害提示拒绝次数 | KL 散度(vs 原始) |

|---|---|---|

| 原始模型 | 97/100 | 0.00 |

| 社区手动消融版 | 3/100 | 0.45–1.04 |

| Heretic 自动生成版 | 3/100 | 0.16 |

注:结果基于 PyTorch 2.8 + RTX 5090;用户可通过

heretic --evaluate-model复现评估。

pip install heretic-llm

heretic Qwen/Qwen3-4B-Instruct-2507

Heretic 生成的模型可能绕过原厂安全机制,不应在生产环境或对安全性有要求的场景中使用。该工具仅用于研究、审计或红队测试,使用者须自行承担合规与伦理责任。