Prezent

Prezent是一家为企业提供AI驱动演示构建器的初创公司, **深耕企业级市场**,目标客户为大型科技与生命科学公司。

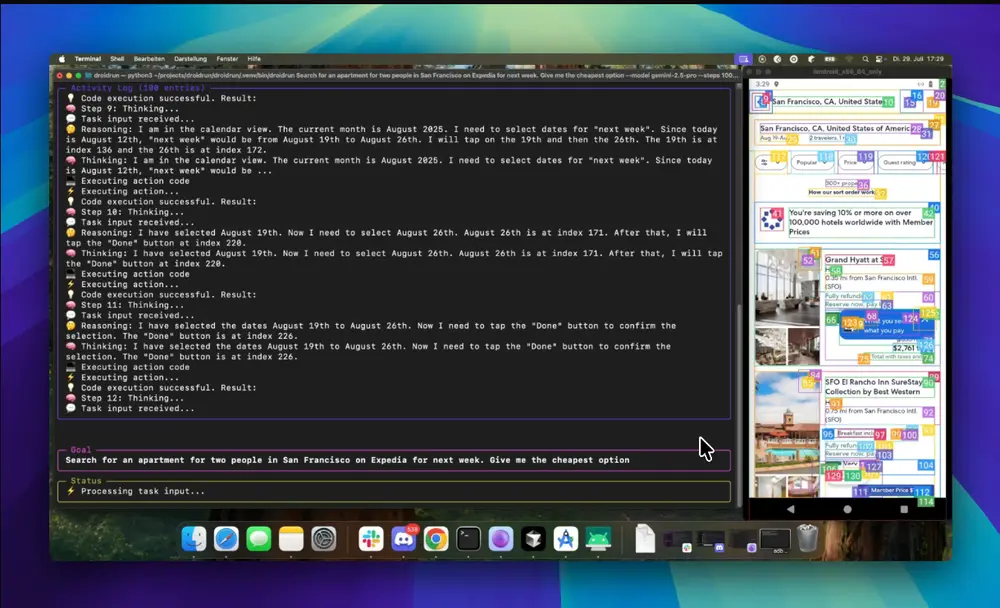

DroidRun是一个基于大语言模型(LLM)代理的移动设备自动化框架,支持通过自然语言命令控制 Android 和 iOS 设备,实现跨平台、多步骤任务的端到端执行。

无论是应用测试、流程引导,还是为非技术用户提供远程协助,DroidRun 都提供了一种低门槛、高灵活性的自动化解决方案。

尽管已有 ADB、Appium、XCUITest 等移动自动化工具,但它们普遍存在以下问题:

而 DroidRun 的核心思路是:将 LLM 作为“智能控制器”,赋予其“看屏幕”和“操作设备”的能力,从而实现:

“你说,它做。”

用户只需用自然语言描述目标(如“打开微博,搜索‘AI 新进展’,点赞第一条帖子”),DroidRun 即可自动规划步骤、识别界面元素并执行操作。

支持使用日常语言指令控制手机行为,无需编程基础。

示例命令:

“在抖音上找到上周关注的博主,播放他最新的视频。”

灵活对接主流大模型服务,当前支持:

可根据性能、延迟、隐私需求自由切换模型。

不仅能执行单步操作,还能拆解多轮任务,例如:

“检查邮箱里有没有来自客户的合同文件,如果有,转发给法务团队。”

模型会自动判断当前界面状态,决定下一步操作(点击、滑动、输入等),具备一定的上下文推理能力。

通过实时截图获取设备当前画面,结合 LLM 的多模态能力分析 UI 布局,识别按钮、输入框、列表项等元素,实现精准操作定位。

droidrun --device android --prompt "打开设置,连接到 Wi-Fi 网络 'Home'"

集成 Arize Phoenix 进行 trace 监控,记录每一步的输入、模型决策、截图与操作结果,便于调试与审计。

模块化设计允许开发者插入自定义组件,如:

| 场景 | 说明 |

|---|---|

| 移动 UI 自动化测试 | 快速验证 App 在不同设备上的功能流程,减少手动回归测试工作量 |

| 非技术用户引导 | 为老年人或数字弱势群体提供语音驱动的操作助手 |

| 重复任务自动化 | 自动完成每日签到、数据上报、消息回复等高频操作 |

| 远程技术支持 | 技术人员通过自然语言指导远程设备操作,降低沟通成本 |

| UI 探索与逆向分析 | 快速理解陌生 App 的功能结构,辅助产品调研或无障碍适配 |