claudecode-telegram

claudecode-telegram 是一个轻量级桥接器,让你通过 Telegram 机器人远程与本地运行的 Claude Code 交互。所有推理在你的设备上完成,无需暴露 API 密钥,也无需依赖云端服务——只需一条消息,即可触发本地 Claude 的完整响应流程。

由 Mozilla AI 推出的 Wasm-Agents Blueprint,正在探索一种全新的 AI 代理部署方式 —— 在浏览器中直接运行 AI 代理,无需额外依赖或本地安装。

由 Mozilla AI 推出的 Wasm-Agents Blueprint,正在探索一种全新的 AI 代理部署方式 —— 在浏览器中直接运行 AI 代理,无需额外依赖或本地安装。

该项目仍处于实验阶段,但已展现出巨大潜力。它通过 WebAssembly(WASM)和 Pyodide 技术,将 Python 编写的 AI 代理打包为单个 HTML 文件,用户只需打开网页即可运行完整代理流程。

这一创新大大降低了 AI 代理的使用门槛,为开发者提供了一个轻量、安全、可移植的执行环境。

传统的 AI 代理通常依赖复杂的运行时环境和工具链,限制了其在不同系统间的共享与测试。而 Wasm-Agents 的目标是:

这使得 AI 代理更易于教学、演示和实验性应用落地。

Wasm-Agents 的核心在于 WebAssembly + Pyodide 技术组合:

具体流程如下:

micropip 安装所需 Python 依赖整个过程都发生在浏览器内部,无需后端服务器或 API 调用。

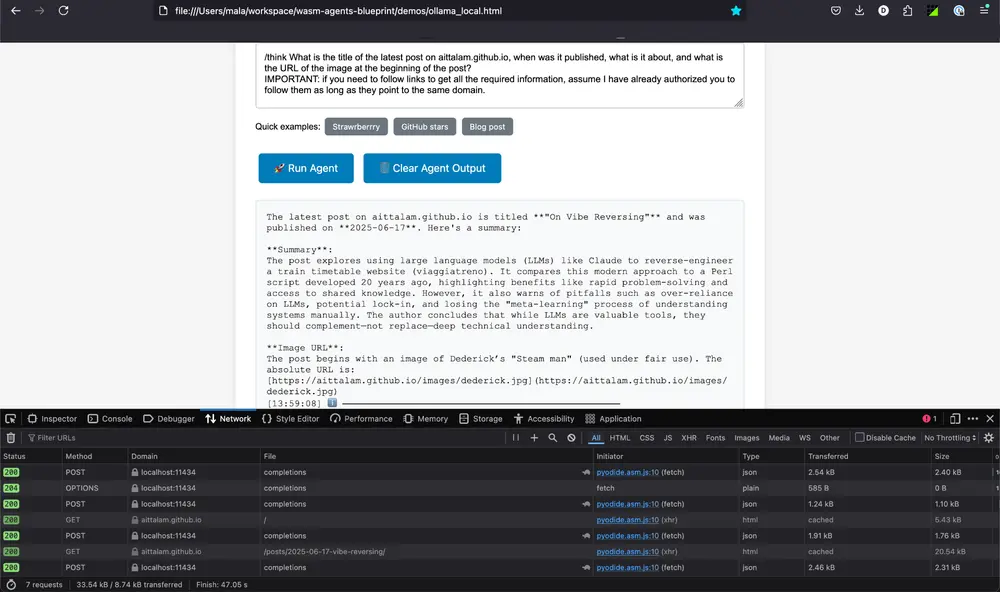

Wasm-Agents 提供了多个 HTML 演示文件,帮助用户快速上手:

| 文件名 | 功能说明 |

|---|---|

hello_agent.html | 最基础的对话代理,支持自定义指令 |

handoff_demo.html | 多代理系统,自动根据提示选择专业代理 |

tool_calling.html | 支持内置工具(如网页访问、字符计数) |

ollama_local.html | 使用本地模型(如 Ollama 上的 qwen3:8b) |

这些示例展示了代理如何完成从基本交互到复杂任务调用的全过程。

/config.js 中的密钥ollama pull qwen3:8b)⚠️ 注意:若需访问外部资源(如网页),请确保目标服务启用了 CORS。

尽管 Wasm-Agents 具有开创性意义,但仍存在一些局限:

Wasm-Agents 目前还只是一个原型项目,但它代表了一种新的方向:在浏览器中运行完整的 AI 代理工作流。

随着 WebAssembly 生态的发展和浏览器计算能力的提升,未来或许我们可以看到: