Meta AI新应用因重大隐私缺陷暴露数百条私人聊天

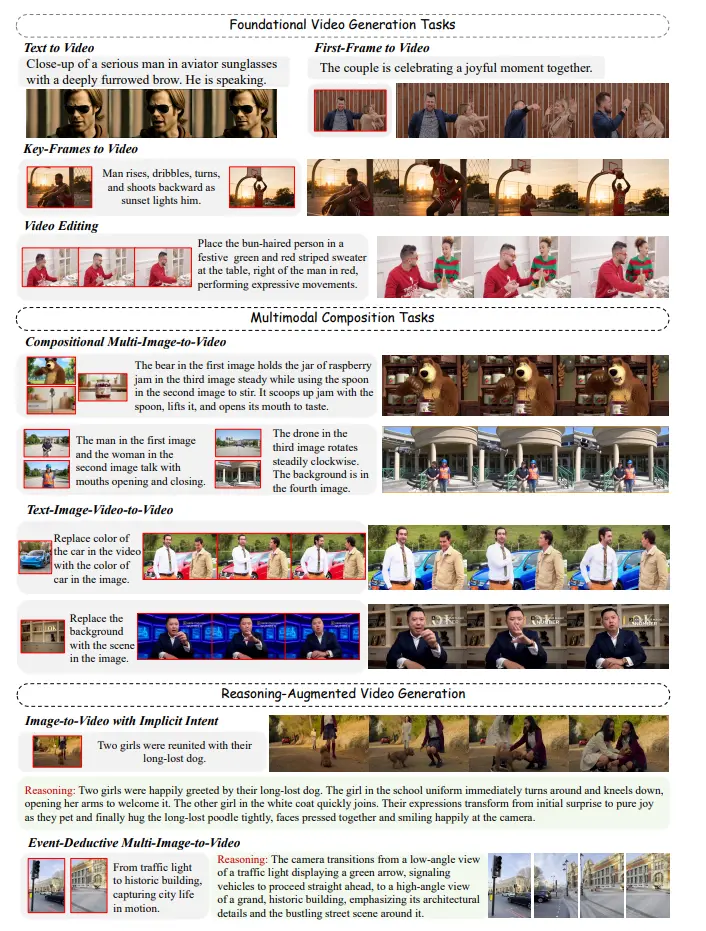

今年4月,Meta推出了一款新的独立Meta AI应用,提供此前通过Messenger、Instagram或WhatsApp访问的多种AI聊天机器人功能,包括写作辅助、图像生成和用户偏好记忆,由其Llama模型驱动。然而,几个月后,该应用因重大隐私缺陷受到严格审查:据报道,数百名用户的私人对话被意外发布到公共动态中,包括音频记录、图片和高度敏感的内容。

暴露数据的范围广泛。涉及心理健康危机、私人医疗诊断、承认出轨、法律问题、逃税、性相关内容,甚至家庭地址或社会保障号码等个人话题,均连同真实用户名一起被公开,通常还伴有语音消息。任何人都可以评论这些帖子,增加了骚扰、羞辱或身份盗窃的风险。许多受影响的用户在被陌生人警告后才意识到他们的帖子是公开的,凸显了通知的严重缺失。一些用户在X上整理了数十条明显私密的对话,显示了公开暴露的敏感信息程度。

此次隐私泄露源于严重的用户体验设计失败,因为Meta AI的“分享”按钮未提供清晰警告,用户很容易在未察觉的情况下公开发布内容。与ChatGPT或Google Gemini提供私有链接和清晰控件不同,Meta默认公开分享,仅有一个易被忽略的小型免责声明。用户可通过进入“设置-数据与隐私-管理您的信息”隐藏过去输入的内容并禁用在Facebook和Instagram上的建议功能。然而,Meta尚未对分享流程做出任何清晰或透明的更改,用户必须手动调整设置以避免公开暴露,这进一步凸显了缺陷的严重性。

暂无评论...