【财富杂志独家】 全球顶尖 AI 公司 Anthropic(Claude 系列模型的开发者)遭遇了一起严重的数据泄露事件。由于内容管理系统(CMS)的配置失误,大量本应保密的内部文件、未发布的模型细节以及高管活动信息被暴露在公开网络中,任何具备基本技术知识的人均可访问。

尽管 Anthropic 在接到《财富》杂志通知后迅速封锁了数据,但此次事件不仅揭示了这家以“安全”为核心卖点的公司在内部运维上的疏忽,更引发了业界对于 AI 自动化工具如何降低黑客门槛 的深层担忧。

泄露了什么?敏感信息一览

剑桥大学网络安全研究员 Alexandre Pauwels 受《财富》委托对泄露数据进行了审查。他发现,约有 3000 个资产(包括图片、PDF 文档、草稿页面等)存储在 Anthropic 的中央内容库中,且处于完全公开、无需认证的状态。

泄露的核心敏感信息包括:

- 未发布的“最强模型”细节:

- 文档中详细描述了一款尚未发布的新型 AI 模型,Anthropic 内部称其为“迄今训练过的最强大模型”。

- 该模型被描述为在 推理、编码和网络安全 领域具有“阶梯式变化(step-change)”的性能提升,远超现有 Claude 模型。

- 目前该模型已向部分早期接入客户进行测试。

- CEO 专属静修会信息:

- 泄露文件包含了一场即将在英国举行的 欧洲大型企业 CEO 静修会 的详细安排。

- 该活动为严格邀请制,仅限少数高层参加。文件泄露可能导致参会者隐私暴露及活动安全风险。

- 内部运营资料:

- 包括标记为员工“育儿假”的内部宣传图片。

- 大量过往博客文章的废弃草稿、未使用的设计资产及内部沟通文档。

漏洞成因:CMS 默认公开的“人为错误”

Anthropic 发言人向《财富》杂志确认,此次事件与 AI 无关,既不是 Claude 生成的代码错误,也不是 AI 智能体(Cowork)的自主行为。

- 根本原因:公司使用的外部 内容管理系统(CMS) 存在配置缺陷。

- 机制缺陷:该系统默认将上传的所有资产设为公开访问,除非手动设置为私密。

- 操作失误:Anthropic 团队在上传上述敏感文档时,忘记修改其访问权限,导致它们直接暴露在公共数据池中。

- 访问方式:任何知道如何构造特定 API 请求的技术人员,均可直接从该公共系统中检索并下载这些未发布文件。部分文件甚至拥有可直接在浏览器中打开的公开 URL。

细思极恐:AI 工具让“挖洞”变得前所未有的简单

虽然漏洞本身是人为配置错误,但安全专家指出,现代 AI 编码工具极大地加剧了此类风险被发现的可能性和速度。

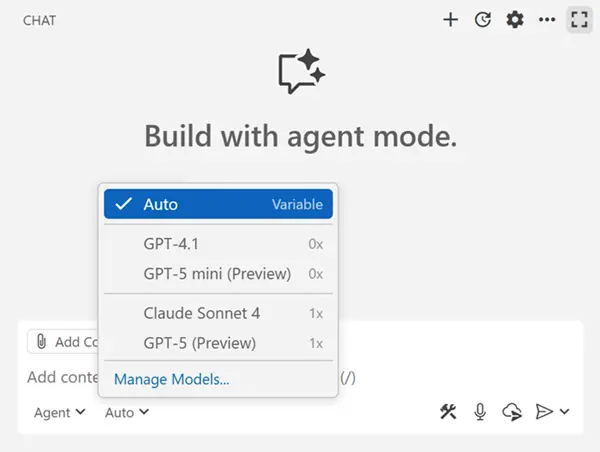

- 自动化扫描:传统的漏洞挖掘需要人工编写脚本遍历目录。而现在,利用 Claude Code、Codex 或 OpenClaw 等工具,攻击者只需输入自然语言指令(如“扫描该域名下所有可公开访问的 PDF 和 JSON 文件,并提取包含‘confidential’关键词的内容”),AI 即可自动生成高效的爬虫脚本。

- 模式识别:AI 能快速分析文件命名惯例、目录结构规律,发现人类难以察觉的隐藏路径。

- 门槛降低:这使得即使是不具备深厚网络安全背景的“脚本小子”,也能借助 AI 轻松发现并利用此类配置错误。

专家观点:“以前发现这种泄露可能需要几天的手工测试,现在有了 AI 助手,可能只需要几分钟。”

官方回应与后续

- 紧急修复:在《财富》杂志于周四告知此事后,Anthropic 立即采取措施,将所有相关资产设为私密或移除,目前数据已不再可公开访问。

- 淡化影响:Anthropic 发言人试图降低事件的严重性,称泄露材料多为“早期草稿”,不涉及核心基础设施、AI 系统权重、客户数据或底层安全架构。

- 承认错误:公司明确将此归咎于“CMS 配置中的人为错误”,并承诺加强内部审核流程。

行业警示:安全无小事

此次事件给所有科技公司敲响了警钟:

- 默认即危险:云服务和 CMS 系统的“默认公开”策略是巨大的安全隐患,必须严格执行“默认拒绝(Default Deny)”原则。

- AI 双刃剑:在利用 AI 提升开发效率的同时,必须意识到攻击者也在利用同样的工具加速漏洞挖掘。防御体系必须跟上 AI 进化的速度。

- 信任危机:对于一家以“构建安全、可控 AI”为使命的公司,连自家的内容管理系统都未能守住,难免让外界对其宣称的“安全性”产生质疑。

在 AI 军备竞赛日益激烈的今天,Anthropic 的这次“裸奔”或许只是一个开始。如何确保在高速迭代中不留下安全后门,将是所有 AI 巨头面临的长期挑战。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...