在 AI 算力需求爆炸式增长的今天,硬件短缺和成本高昂成为了行业最大的痛点。然而,一家名为 Gimlet Labs 的初创公司提出了一种反直觉的解决方案:不再执着于单一类型的顶级 GPU,而是让 AI 工作负载同时在 CPU、GPU 和高内存系统等多种异构硬件上运行。

凭借这一创新的“多芯片推理云”理念,Gimlet Labs 刚刚完成了由 Menlo Ventures 领投的 8000 万美元 A 轮融资,累计融资额达 9200 万美元。

核心理念:没有万能芯片,但有万能软件

Gimlet Labs 的创始人、斯坦福大学兼职教授 Zain Asgar 指出,当前的 AI 推理流程并非铁板一块,不同阶段对硬件的需求截然不同:

- 推理计算(Inference):需要强大的算力(GPU 擅长)。

- 解码生成(Decoding):是内存密集型任务(高带宽内存系统更优)。

- 工具调用(Tool Calling):则是网络密集型任务(CPU 或专用网络芯片更高效)。

现状困境:目前大多数数据中心被迫使用昂贵且稀缺的高端 GPU 来处理所有步骤,导致资源错配。据统计,现有硬件的利用率仅为 15% 到 30%,这意味着数万亿美元的投资被闲置浪费。

Gimlet 的解法:

Gimlet Labs 打造了一层智能编排软件(即“多芯片推理云”),它能将 AI 智能体的工作流切片(Slice),自动分配给最适合该任务的硬件:

- 让 GPU 做它擅长的矩阵运算。

- 让 CPU 处理逻辑判断和网络请求。

- 让高内存系统承担解码任务。

- 甚至可以将单个模型的不同部分拆分到不同架构的芯片上并行运行。

性能与效益:提速 3-10 倍,变废为宝

通过这种“量才录用”的策略,Gimlet Labs 声称能在相同的成本和功耗下,将 AI 推理速度提升 3 到 10 倍。

- 激活闲置资源:它不仅支持最新的 NVIDIA H100/B200,还能重新部署老旧的 GPU、利用现有的 CPU 集群,甚至整合 AMD、Intel、Cerebras 和 d-Matrix 等不同厂商的芯片。

- 生态兼容:公司已与 NVIDIA、AMD、Intel、ARM、Cerebras、d-Matrix 等主流芯片巨头建立合作伙伴关系,确保软件能无缝调度各类硬件。

“我们的目标基本上是试图弄清楚如何让 AI 工作负载的效率比以往任何时候都提高 10 倍。” —— Zain Asgar

商业模式与市场反响

- 目标客户:不面向普通开发者,而是专注于大型 AI 模型实验室和超大规模云计算提供商。

- 增长迅猛:

- 去年 10 月公开发布后,首年即实现八位数收入。

- 过去四个月客户群翻倍,其中包括一家主要模型制造商和一家巨型云计算公司(虽未具名,但分量十足)。

- 资本追捧:本轮融资由 Menlo Ventures 领投,Factory、Eclipse Ventures、Prosperity7 等跟投。由于项目极具吸引力,融资过程迅速被超额认购。

团队背景:可观测性专家的重聚

Gimlet Labs 的核心团队曾共同创立了 Pixie(一家为 Kubernetes 提供开源可观测性工具的初创公司,2020 年被 New Relic 收购)。

- Zain Asgar (CEO):斯坦福教授,前 Google 基础设施专家。

- Michelle Nguyen, Omid Azizi, Natalie Serrino:均为 Pixie 时期的老搭档,深谙大规模分布式系统的调度与监控。

正是这种在系统可观测性和资源调度领域的深厚积累,让他们敏锐地发现了 AI 推理中硬件利用率低下的结构性问题,并用软件定义的方式给出了优雅的答案。

当前项目

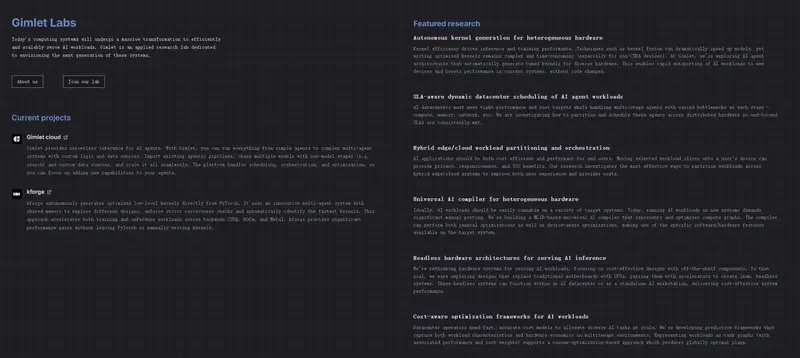

Gimlet Cloud

Gimlet 为 AI 智能体提供无服务器推理服务。使用 Gimlet,您可以运行从简单智能体到具有自定义逻辑和数据源的复杂多智能体系统。导入现有的智能体流水线,将多个模型与非模型阶段进行链式调用,并无缝扩展。该平台处理调度、编排和优化,让您专注于为智能体添加新功能。

kforge

kforge 直接从 PyTorch 自主生成优化的底层内核。它利用创新的多智能体系统与共享内存,探索不同的设计,严格执行正确性检查,并自动识别最快的内核。这种方法加速了跨 CUDA、ROCm 和 Metal 后端的训练和推理工作负载。kforge 无需离开 PyTorch 或手动编写内核即可带来显著的性能提升。

数据统计

相关导航

POML

Miro

CC-Connect

unsloth

RAPTOR

AiMaster

MineContext