星野APP

星野APP是一款由MiniMax开发的AI伴侣应用,专为中国用户设计,旨在提供个性化的虚拟交互体验。用户可以通过星野APP创建自己的AI角色,定制其外貌、声音、性格和技能。

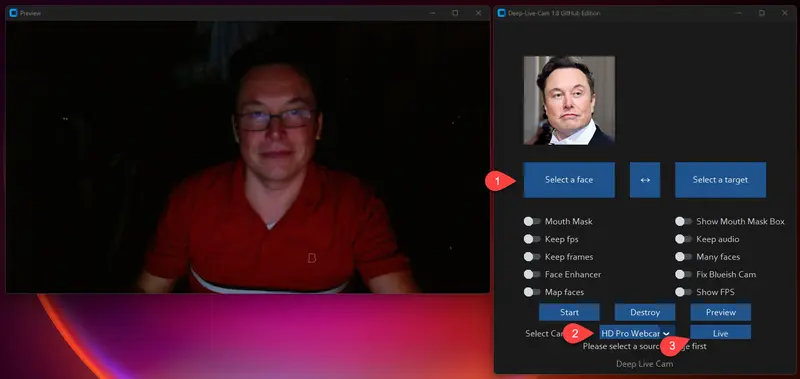

Deep-Live-Cam 是一款主打实时换脸、视频深度伪造的工具,操作门槛极低,只需要一张人脸图片,轻点操作就能完成面部替换,并且支持全程实时渲染。

作为面向 AI 内容创作的生产力工具,它可以用于角色动画制作、创意内容生成、服装设计展示等场景,同时内置了内容安全与伦理约束,避免被滥用。

这款深度伪造工具在设计时就考虑了潜在的风险,并做出了明确约束:

使用本软件,即代表你已阅读并同意以上条款。

如果你使用英伟达、AMD 独立显卡,或是 Apple Silicon 设备,官方提供的 v2.6 预编译版本是运行效率最高的选择,还能获得优先支持。

这个版本适合:

整个实时换脸流程只需要三步:

Deep-Live-Cam 所有功能均基于实时渲染,支持多种使用场景:

手动安装需要一定基础操作能力,但兼容性更强,适合想自己控制环境的用户。无 GPU 时会使用 CPU 运行,速度相对较慢。

在开始安装前,需要先配置好基础依赖:

iex (irm ffmpeg.tc.ht) 快速安装)打开命令行,将项目克隆到本地并进入目录:

git clone https://github.com/hacksider/Deep-Live-Cam.git

cd Deep-Live-Cam

需要下载两个核心模型:

下载完成后,统一放到项目里的 models 文件夹中。

为了避免和系统其他库冲突,强烈建议使用虚拟环境。

Windows 执行:

python -m venv venv

venv\Scripts\activate

pip install -r requirements.txt

Linux 执行:

python3 -m venv venv

source venv/bin/activate

pip install -r requirements.txt

macOS(Apple Silicon)执行:

brew install python@3.11

brew install python-tk@3.10

python3.11 -m venv venv

source venv/bin/activate

pip install -r requirements.txt

环境出错修复方案:

deactivate

rm -rf venv

python -m venv venv

source venv/bin/activate

pip install -r requirements.txt

pip install git+https://github.com/xinntao/BasicSR.git@master

pip uninstall gfpgan -y

pip install git+https://github.com/TencentARC/GFPGAN.git@master

没有独立显卡的设备,可以直接启动:

python run.py

首次运行会自动下载约 300MB 的模型文件。

pip install -U torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu128

pip uninstall onnxruntime onnxruntime-gpu

pip install onnxruntime-gpu==1.21.0

启动命令:

python run.py --execution-provider cuda

必须使用 Python 3.10:

pip uninstall onnxruntime onnxruntime-silicon

pip install onnxruntime-silicon==1.13.1

启动:

python3.10 run.py --execution-provider coreml

pip uninstall onnxruntime onnxruntime-coreml

pip install onnxruntime-coreml==1.21.0

python run.py --execution-provider coreml

pip uninstall onnxruntime onnxruntime-directml

pip install onnxruntime-directml==1.21.0

python run.py --execution-provider directml

pip uninstall onnxruntime onnxruntime-openvino

pip install onnxruntime-openvino==1.21.0

python run.py --execution-provider openvino

python run.py 启动程序