欧洲AI初创公司 Multiverse Computing 近日发布两款极小尺寸的高性能AI模型,分别命名为 ChickBrain(鸡脑) 和 SuperFly(苍蝇脑)。这一命名源自其参数规模与动物大脑的类比,也标志着该公司在“小模型、大能力”方向上的最新突破。

这两款模型是目前全球最小但仍具备实用性能的AI系统之一,专为设备端本地运行设计,可在智能手机、平板、笔记本甚至物联网设备上离线工作,无需依赖云端连接。

从量子物理到AI压缩:CompactifAI技术揭秘

Multiverse 的核心技术名为 CompactifAI——一种受量子物理启发的模型压缩算法。公司创始人 Román Orús 向 TechCrunch 表示:“我们的压缩方法不同于传统的机器学习压缩技术。我们来自量子物理背景,因此能实现更精细、更高效的压缩。”

该技术可在不牺牲性能的前提下,显著缩小现有大模型的体积。自2019年成立以来,Multiverse 已累计融资约 2.5亿美元,其中今年6月完成1.89亿欧元(约2.15亿美元)融资,由 Bullhound Capital 领投,HP Tech Ventures、东芝等机构参与。

两款新模型:小到极致,用在近处

1. SuperFly:苍蝇大脑,设备级智能

- 参数规模:9400万(原模型 SmolLM2-135 为1.35亿)

- 定位:极低资源环境下的语音交互与控制

- 应用场景:嵌入家电、可穿戴设备、Arduino等微控制器

SuperFly 专为在极小数据集上训练和运行而设计。Multiverse 展示了其在洗衣机上的应用:用户可通过语音指令“开始快速洗涤”或询问“为什么机器不启动?”进行交互。整个过程在设备本地完成,无需联网,响应迅速且隐私安全。

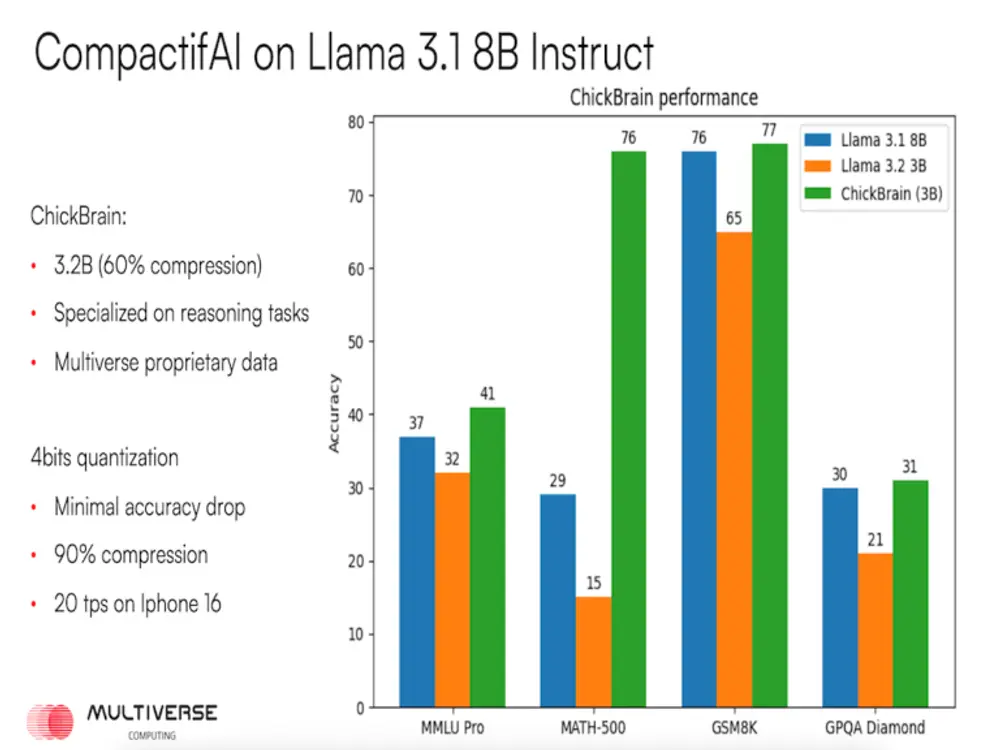

2. ChickBrain:鸡脑大小,推理在线

- 参数规模:32亿

- 定位:具备推理能力的本地化AI助手

- 基础模型:Meta Llama 3.1 8B 的压缩版本

尽管参数更少,ChickBrain 在多项基准测试中表现优于原始模型:

| 基准测试 | ChickBrain 表现 |

|---|---|

| MMLU-Pro(语言理解) | 略优于原模型 |

| Math 500 / GSM8K(数学推理) | 略优于原模型 |

| GPQA Diamond(通用知识) | 略优于原模型 |

更重要的是,它可在 MacBook 等消费级设备上流畅运行,完全离线,适合需要隐私保护或网络受限的场景。

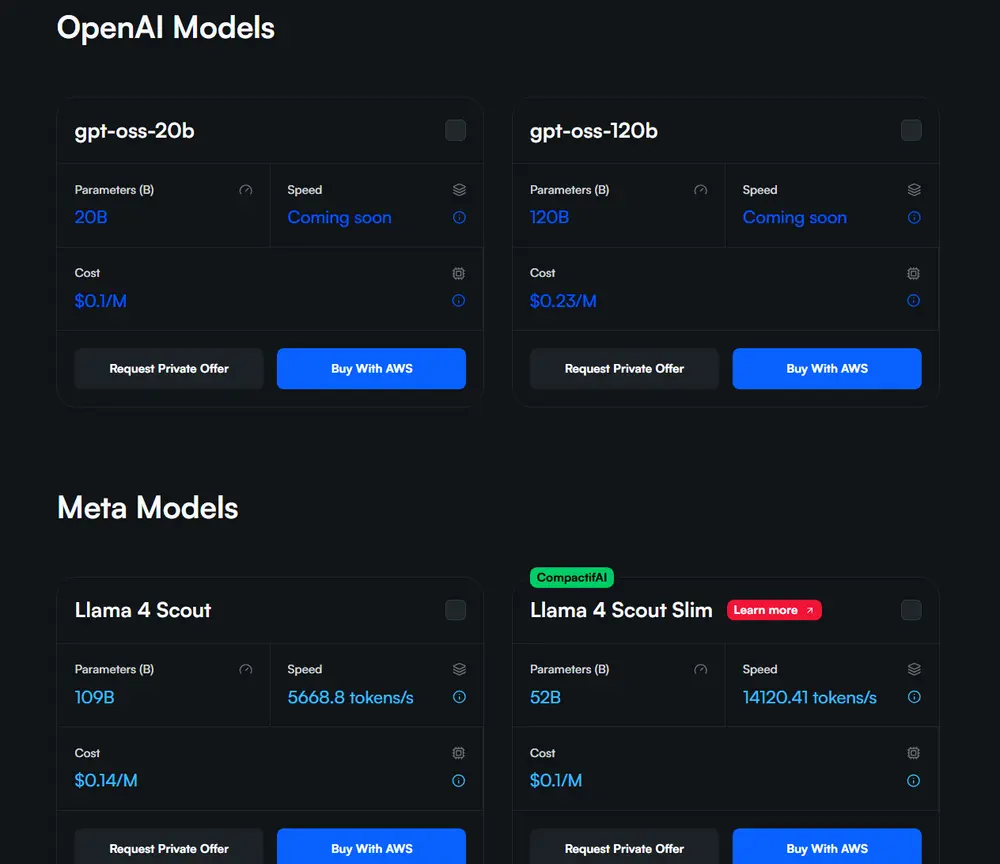

模型动物园:不止于聊天

Multiverse 并未止步于这两款模型。公司已开源一系列压缩版本,涵盖:

- Llama 4 Scout

- Mistral Small 3.1

- OpenAI 新开源模型的压缩版

- DeepSeek R1 Slim

其“模型动物园”战略旨在为不同硬件条件和应用场景提供定制化的小模型选择。

商业化路径:从设备制造商到开发者生态

Multiverse 正与多家全球领先的设备制造商洽谈合作,包括苹果、三星、索尼和惠普。其中,惠普已作为投资者参与其最新一轮融资。

除了直接向硬件厂商授权模型,Multiverse 还通过 AWS 托管 API 向开发者提供其压缩模型服务,按 token 计费,价格通常低于主流竞争对手。

此外,公司也为图像识别、工业预测等非语言类机器学习任务提供压缩解决方案,客户包括 BASF、Ally、Moody’s 和 Bosch。

小模型的未来:效率与隐私的平衡

Multiverse 的实践揭示了一个正在成型的趋势:AI 的未来不仅在云端巨兽,也在终端小模型。

当模型足够小、足够快、足够省电时,我们不再需要把每一次提问都上传到服务器。这不仅提升了响应速度,也从根本上增强了用户隐私与数据安全。

正如 Orús 所说:“我们不是要打败最大的模型,而是要让最好的模型能在你手中运行。”

数据统计

相关导航

Ripple(涟漪)

OpenClaw 极简安全实践指南

OxyGent

OpenClaw Killer

团子

闲鱼智能监控机器人

海螺AI