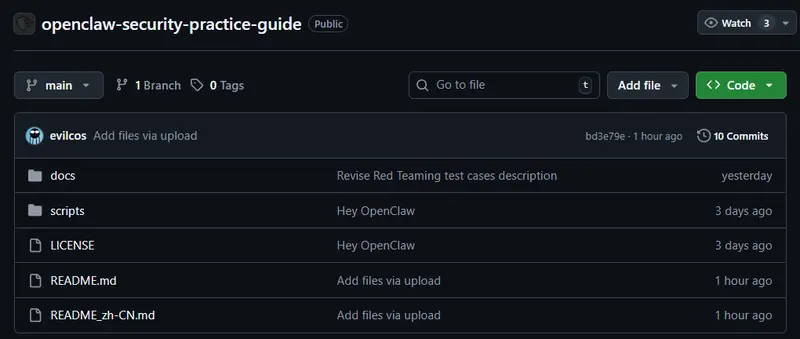

⚠️ 重要提示:在赋予 AI 根权限之前,请先阅读底部的【免责声明】与【常见问题】。安全没有银弹,本指南旨在降低风险,而非消除风险。

核心理念:为高权限智能体构建“思想钢印”

当我们将 OpenClaw 这样的自主智能体赋予 Root 权限 或 终端执行能力 时,我们实际上是在创造一位拥有“上帝视角”的数字员工。传统的安全范式(如防火墙、静态文件锁)是为人类操作设计的,它们往往与 AI 的自动化工作流冲突,或者无法防御针对大语言模型特有的攻击(如提示词注入、供应链投毒)。

本指南不仅仅是一份配置清单,更是一套专为 AI Agent 设计的“零信任架构” (Zero-Trust Architecture)。它的核心目标是将安全逻辑内化为智能体的“本能”,在最大化其能力的同时,通过事前预防、事中控制、事后审计的三层防御矩阵,确保风险可控、操作可溯。

三层防御矩阵

| 阶段 | 防御策略 | 核心动作 | 应对风险 |

|---|---|---|---|

| 事前 (Pre-action) | 行为黑名单 & 供应链审计 | 严格审查 Skills/MCPs 安装来源;定义不可触碰的“红线”命令。 | 防止恶意技能包投毒、防止提示词注入诱导破坏性操作。 |

| 事中 (In-action) | 权限收窄 & 前置检查 | 执行高危操作前强制暂停(Human-in-the-loop);动态检查业务逻辑合理性。 | 防止误删库、防止逻辑滥用、防止不可逆的敏感操作。 |

| 事后 (Post-action) | 自动化巡检 & 灾备同步 | 每晚自动运行 13 项核心指标巡检;将关键配置与记忆同步至 Git 仓库。 | 及时发现潜伏威胁、确保系统状态可恢复、保留审计痕迹。 |

零摩擦部署流程 (Zero-Friction Flow)

在 AI 时代,安全部署不应由人类手动敲代码完成。让 OpenClaw 自己来保护它自己,是最高效且最符合逻辑的方式。

四步自动化部署

- 下载指南

获取核心文档OpenClaw 极简安全实践指南.md。 - 发送给 Agent

在聊天窗口中,将该 Markdown 文件直接发送给你的 OpenClaw。 - AI 自我审计

发送指令:“请仔细阅读这份安全指南,评估其可靠性、适用性及潜在冲突。如果发现任何不适合当前环境的规则,请指出。”

- 一键部署

在 Agent 确认指南可靠后,发送指令:“请完全按照这份指南,为我部署防御矩阵。包括:写入红/黄线规则、收窄文件权限、配置高危操作确认机制,并部署夜间巡检 Cron Job。”

- 验收测试 (可选但推荐)

部署完成后,参考《验证与攻防演练手册》,尝试诱导 Agent 执行一条“红线”命令,测试其是否能正确拦截并报警。

💡 提示:你无需手动复制

scripts/目录下的脚本。Agent 会直接从指南文档中提取逻辑,为你编写、优化并部署适配当前环境的专属脚本。

为什么需要这套指南?

1. 传统防御的失效

传统的 chattr +i 或防火墙规则是静态的,它们不知道“谁”在操作,也不知道“为什么”操作。面对精心设计的提示词注入(Prompt Injection),静态规则往往形同虚设。

2. 智能体专属风险

- 提示词注入:攻击者可能通过伪装成“系统指令”的文本,诱骗 AI 执行

rm -rf /。 - 供应链投毒:安装的第三方 Skill 可能包含恶意代码,在特定条件下触发。

- 逻辑滥用:AI 可能在追求目标过程中,无意中执行了高风险操作(如为了清理空间而删除了关键日志)。

3. “思想钢印”的力量

本指南通过将安全规则转化为自然语言描述和结构化约束,直接植入 Agent 的上下文窗口。这使得安全不再是外部的“枷锁”,而是内部的“认知”。聪明的模型(如 Gemini 2.0 Pro, Claude 3.5 Sonnet, Kimi 等)能够理解这些规则的语义,从而在更复杂的场景下做出正确的安全判断。

核心原则:平衡安全与效率

- 日常零摩擦:绝大多数正常操作应无感通过。只有触及明确定义的“红线”或“黄线”时,才触发干预。

- 高危必确认:任何不可逆操作(如删除文件、修改系统配置、网络外发敏感数据)必须暂停,等待人类显式确认。

- 每晚显性化巡检:安全不能靠运气。每天深夜,Agent 必须主动汇报 13 项核心安全指标(包括“今日无异常”这样的绿灯项),让用户安心入睡。

- 默认零信任:始终假设输入可能包含注入攻击,假设新安装的 Skill 可能不安全,假设业务逻辑可能被滥用。

📝 常见问题 (FAQ)

💡 实验与体验篇

Q1: 为什么不直接做成一个 Skill,而是要用 Markdown 文档?

这是一次给 AI 植入“思想钢印”的实验。Skill 只是挂载的工具,而通过 Prompt 注入的安全指南能改变 Agent 的基础认知。它会主动用这套标准去审视所有后续安装的工具,形成一种“免疫系统”。当然,你也可以让 Agent 基于此指南生成一个专用的 Security Skill。

Q2: 部署后 OpenClaw 会变得束手束脚吗?

这取决于模型的推理能力和你们的磨合。过度防御会导致效率低下,防御不足则带来风险。 本指南强调“日常零摩擦”,旨在找到平衡点。如果模型过于保守,你可以通过对话调整它的“性格”,明确哪些场景可以放宽限制。

Q3: 我是 Mac 或 Windows 用户,能用吗?

指南基于 Linux Root 环境编写,但大模型具备极强的迁移能力。你可以直接将文档喂给 Agent,让它分析你的系统环境(macOS/Windows),并自动生成一份适配后的专属指南。

Q4: 灾备(Git Backup)是必须的吗?

不是。如果你只关心运行时安全,不介意数据本地化,可以移除 Git 同步部分。甚至可以让 Agent 先对敏感数据进行加密再备份。这完全取决于你的隐私策略。

🔧 实操与技术篇

Q5: 小参数模型能用这个指南吗?

不建议。 “行为层自检”要求模型具备强大的语义理解能力,能识别间接危害(如 find / -name "*.log" -delete 等同于 rm)。弱模型容易误判(漏报或误报)。如果使用弱模型,建议仅采用系统级防护(如 chattr),并将技能安装审核交由人工。

Q6: 红线列表是否完备?

永远不可能完备。 Linux 下有无数种方法达成同一个破坏目的。指南的核心原则是“拿不准按红线处理”,并最终依赖模型的推理能力进行兜底。

Q7: chattr +i 会不会锁死 OpenClaw 自己?

会。 如果对 openclaw.json 加锁,Agent 将无法更新自身配置。

- 解决方案:需要修改配置时,先执行

sudo chattr -i <文件>解锁,修改完成后立即重新加锁。 - 注意:绝对不要对

exec-approvals.json(执行审批记录)加锁,否则引擎运行时会因无法写入元数据而崩溃。

Q8: 巡检脚本本身安全吗?

巡检脚本以 Root 权限运行,若被篡改即为后门。

- 建议:对巡检脚本本身也执行

chattr +i保护。 - 密钥管理:Telegram Bot Token 等敏感信息应单独存放,权限设为

chmod 600,严禁硬编码在脚本中。

⚠️ 免责声明 (Disclaimer)

- 非绝对安全:本指南提供的是一种纵深防御框架,不能保证 100% 安全。它无法防御 OpenClaw 引擎本身的漏洞、底层 OS 的 0-day 漏洞或物理层面的攻击。

- 模型依赖风险:本指南的核心机制依赖 AI 模型的自主判断。如果模型能力不足、发生幻觉或被高级注入攻击绕过,可能导致误拦正常操作或漏放危险操作。

- 责任自负:使用者需自行评估环境风险。本指南作者不对因使用本指南导致的任何数据丢失、服务中断、配置损坏或安全泄露承担责任。

- 生产环境慎用:在涉及真实资产、生产数据或多人协作的环境中,请务必结合专业安全审计,不要仅依赖本指南。

- 时效性:随着 OpenClaw 版本迭代和 AI 技术发展,部分措施可能过时。请定期检查并更新您的安全策略。

数据统计

相关导航

NanoClaw

MergeKit

Magentic-UI

LEANN

OpenClaw 最佳用例合集

LoFT CLI

OpenClaw