Hyperlink - 最新版

Hyperlink 设计为完全本地化,是一个本地个人AI智能体,利用您的个人数据帮助您回忆和创建信息,就在您的设备上。

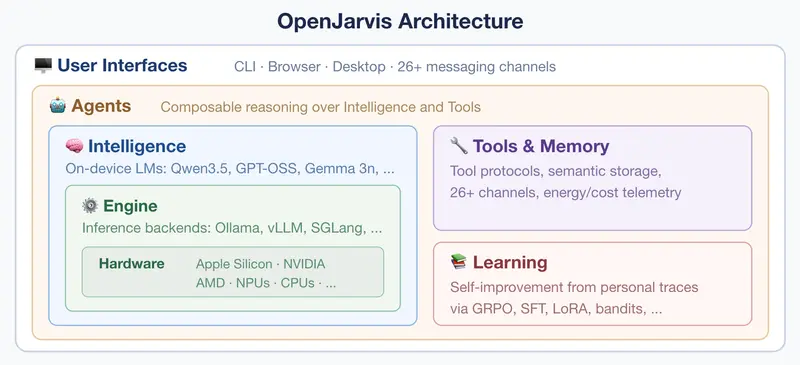

OpenJarvis 是一款聚焦设备端部署的 AI 框架,核心目标是让个人 AI 助手默认运行在自有硬件上,仅在必要时调用云端 API,彻底摆脱对第三方服务器的依赖。

7.43MB0 人已下载 手机查看

OpenJarvis 是一款聚焦设备端部署的AI框架,核心目标是让个人AI助手默认运行在自有硬件上,仅在必要时调用云端API,彻底摆脱对第三方服务器的依赖。

OpenJarvis 诞生的核心背景是,本地大语言模型已具备处理88.7%单轮对话与推理查询的能力,且2023-2025年智能效率提升5.3倍,硬件与模型已足够支撑本地化部署。

该框架围绕三大核心理念构建:

# 克隆仓库

git clone https://github.com/open-jarvis/OpenJarvis.git

cd OpenJarvis

# 仅安装核心框架

uv sync

# 如需FastAPI服务器(支持API调用)

uv sync --extra server

# 初始化配置(自动检测硬件)

uv run jarvis init

# 安装并启动Ollama推理后端

curl -fsSL https://ollama.com/install.sh | sh

ollama serve

# 下载模型(以通义千问8B为例)

ollama pull qwen3:8b

# 简单提问测试

uv run jarvis ask "法国的首都是哪里?"

# 诊断配置/连接问题

uv run jarvis doctor

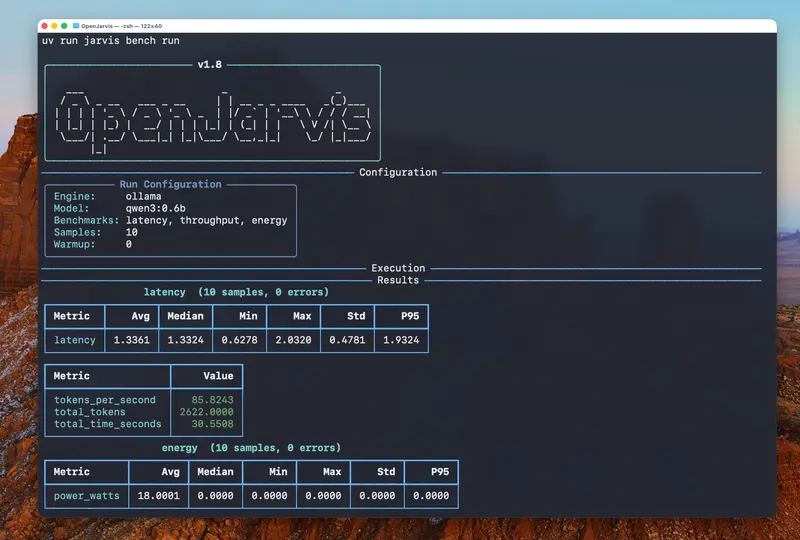

注:除Ollama外,还支持vLLM、SGLang、llama.cpp等推理后端,

jarvis init会自动推荐适配硬件的最优引擎。

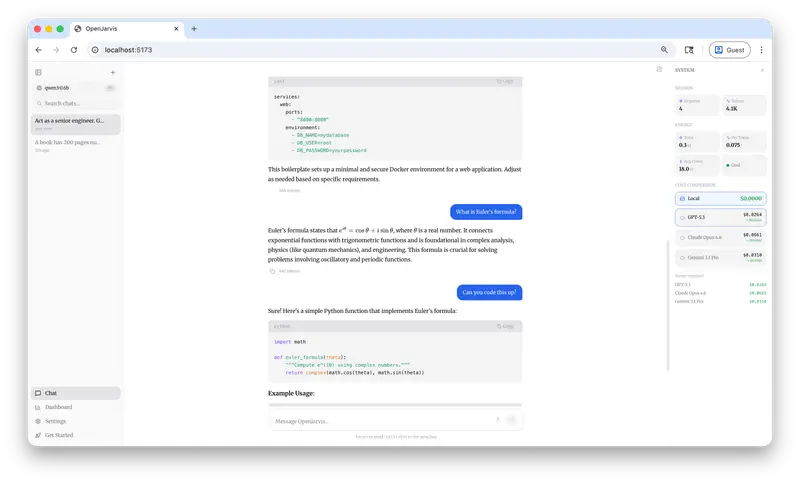

OpenJarvis 提供跨平台桌面应用,后端仍本地化运行,仅需两步即可使用:

git clone https://github.com/open-jarvis/OpenJarvis.git

cd OpenJarvis

./scripts/quickstart.sh

http://localhost:8000。xattr -cr /Applications/OpenJarvis.appOpenJarvis 采用分层设计,各层接口清晰、可独立替换:

jarvis serve可提供SSE流式传输的FastAPI服务,直接替换OpenAI客户端;