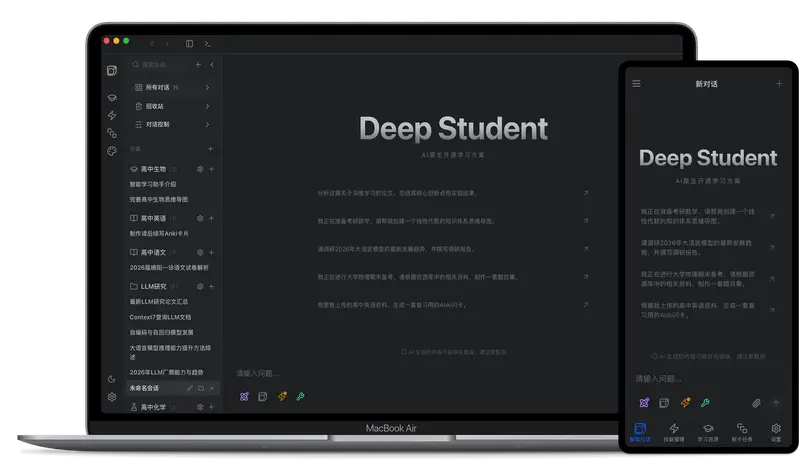

在 AI 工具泛滥的今天,我们拥有了强大的模型,却缺乏一个能将它们有机整合、真正服务于深度学习的系统。DeepStudent不仅仅是一个聊天机器人或笔记软件,而是一套AI 原生(AI-Native)、本地优先(Local-First)的开源学习操作系统。

- 官网:https://deepstudent.cn

- GitHub:https://github.com/helixnow/deep-student

从智能对话到 Anki 制卡,从深度调研到论文管理,DeepStudent 通过统一的虚拟文件系统 (VFS) 和灵活的技能系统 (Skills),将分散的学习动作串联成完整的知识闭环。最重要的是:所有数据存储在你的本地,隐私与安全完全由你掌控。

核心架构:以数据为中心的 AI 原生设计

DeepStudent 摒弃了传统应用“功能孤岛”的设计,采用了一套严密的三层架构:

1. 📂 统一数据层:虚拟文件系统 (VFS)

这是系统的单一事实来源 (SSOT)。

- 全格式收纳:笔记、PDF 教材、题库、导图、翻译稿、作文等所有学习资产统一存入 VFS。

- 自动化流水线:资源导入后自动进入队列,执行

OCR → 分块 → Embedding → LanceDB 索引。 - 结果:所有非结构化文档瞬间转化为 AI 可理解、可检索、可操作的标准化资产。

2. 🧩 驱动引擎:技能系统 (Skills Engine)

拒绝臃肿的 System Prompt,采用按需加载的技能架构。

- 封装能力:每个技能(如“制卡”、“调研”、“导师”)封装了特定的指令集与工具链。

- 动态调度:Chat V2 根据用户意图自动激活相应技能,通过后端 Pipeline 调用 VFS 数据执行任务。

- 无限扩展:支持三级加载(内置 → 全局 → 项目级),用户可通过

SKILL.md 自定义专属技能。

3. 🖥️ 交互界面:多视图应用

上层应用只是 VFS 数据的不同视图:

- Chat V2:对话即操作,通过 RAG 实时调用知识库。

- Learning Hub:像 Finder 一样管理所有学习资产。

- Essay:专注作文批改与润色的工作台。

🔒 本地优先承诺:

所有数据(SQLite 元数据 + LanceDB 向量库 + Blob 原始文件)均存储在本地。支持 AES-256-GCM 加密、完整审计日志及本地备份,彻底杜绝云端泄露风险。

🚀 七大核心功能模块

1. 💬 智能对话 (Chat V2):为深度学习而生

- 多模态与引用:拖拽上传 PDF/图片,直接选取知识库片段作为上下文,实时显示 Token 消耗。

- 深度推理:内置思维链 (CoT) 模式,展示 AI 解题全过程,适合复杂理科题。

- 会话分支:从任意消息创建平行宇宙,探索不同思路而不丢失原始上下文。

- 多模型对比:(实验性) 同时向多个模型发送问题,并排对比回答质量。

- 子代理执行:(实验性) 主代理自动拆解任务,分发给后台子代理执行并汇总结果。

2. 🃏 ChatAnki:从“输入”到“内化”的闭环

- 对话式制卡:一句“把这个文档做成卡片”,即可批量生成 Anki 卡片。

- 可视化模板:内置模板设计师,支持自然语言修改 HTML/CSS,实时 3D 预览。

- 无缝同步:生成结果一键同步至 Anki 桌面/移动端,打通记忆最后一公里。

3. 🔬 深度调研 & 📚 文献综述

- 多步 Agent:自动拆解任务(目标确认 → 联网搜索 → 本地检索 → 分析 → 报告)。

- 全网覆盖:支持配置 7 种搜索引擎 (Google, Tavily, 智谱等) 及学术库 (arXiv, OpenAlex)。

- 一站式论文管理:

- 智能搜索与元数据提取。

- 批量下载 (自动多源回退,SHA256 去重)。

- 引用格式化 (BibTeX, APA, GB/T 7714)。

- 综述自动生成:按学术规范输出结构化综述报告,直出毕业论文初稿。

4. 🎯 导师模式 & 🧠 知识导图

- 苏格拉底式教学:不直接给答案,通过引导式提问、微步骤拆解,让学生自己发现解法。严格遵循学术诚信,拒绝代写作业。

- AI 知识导图:一句话生成学科体系,支持多轮对话修正节点,切换大纲/导图视图,甚至开启“遮挡背诵”模式。

5. 📝 题目集 & ✍️ 作文批改

- 智能出题:上传教材一键生成题库,支持多种练习模式与模拟考试配置。

- 深度解析:AI 不仅判分,还分析知识点分布与解题思路,精准定位薄弱环节。

- 全能作文批改:覆盖高考/雅思/托福等标准,提供多维度评分、高亮标注、逐句润色对比。

6. 💾 智能记忆 (Self-Evolving Memory)

受 mem0/memU 启发,构建自进化用户画像:

- 自动提取:异步从对话中提取原子事实(偏好、目标、身份)。

- 智能决策:LLM 自动判定记忆的 ADD/UPDATE/DELETE,避免冗余。

- 动态衰减与强化:90 天未命中自动降权 (

_stale),高频命中自动升权 (_important)。 - 隐私模式:一键切断所有 API 调用,纯本地运行记忆逻辑。

7. 🌐 翻译工作台 & 📖 智能阅读器

- 分屏阅读:左侧对话,右侧 PDF/DOCX 阅读,点击页面自动注入上下文。

- 专业翻译:支持全文/逐段双语对照,内置学术/法律/医学等领域预设,自定义术语风格。

🛠️ 开放生态:MCP 与多模型支持

- MCP 兼容:原生支持 Model Context Protocol,轻松连接 Arxiv、Context7 等外部工具服务器。

- 9+ 模型供应商:预置 SiliconFlow, DeepSeek, 通义千问,智谱,豆包,MiniMax, Moonshot, OpenAI, Gemini。

- 最新适配:已完美支持 Gemini 3 (thought_signature), GPT-5.2 Pro, GLM-5, Kimi K2.5 等前沿模型。

- 自定义端点:支持任何兼容 OpenAI 协议的本地模型 (Ollama, LM Studio) 或私有部署。