如果你同时使用 Claude Code、GitHub Copilot(Codex)和 Google Gemini CLI,你可能深有体会:

- 每个工具都有自己的配置文件(

settings.json、auth.json、.env) - API 密钥散落在不同目录,切换模型时容易出错

- MCP 服务器、Skills、系统提示词无法跨工具复用

- 更换供应商后,旧配置丢失,调试成本高

CC Switch 的出现,正是为了解决这一“多 AI 工具配置碎片化”问题。它不是另一个 AI 客户端,而是一个跨平台、跨工具的配置中枢,让你在一个界面中管理所有主流 AI CLI 的核心设置。

核心能力:三大统一

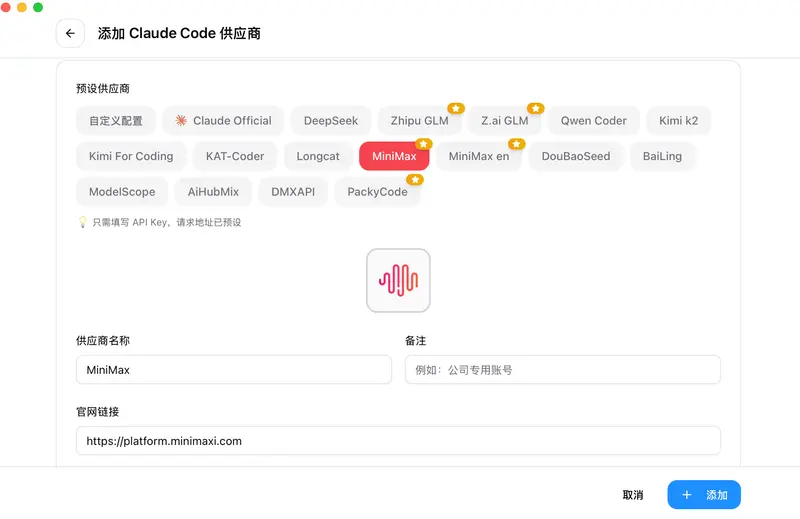

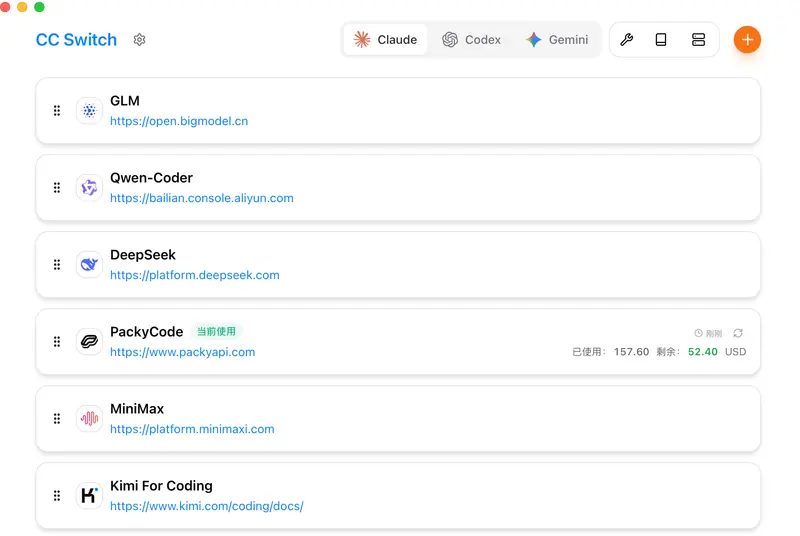

✅ 供应商统一管理

- 支持 Claude Code、Codex、Gemini CLI 三大客户端

- 可为每个客户端配置 官方 OAuth、自定义 API 端点、多模型映射(Haiku/Sonnet/Opus)

- 速度测试功能:测量 API 延迟,可视化选择最优端点

- 一键切换:通过主界面或系统托盘快速启用不同配置,重启客户端即生效

✅ 生态统一同步

- MCP 服务器管理:在一个面板中配置 stdio/http/SSE 三种传输类型的 MCP 服务,并同步到各客户端的 live 配置

- Skills 管理(v3.7+):自动扫描 GitHub 仓库(如 Anthropic 官方、ComposioHQ),一键安装/卸载技能到

~/.claude/skills/ - Prompts 管理(v3.7+):用 Markdown 编辑器创建无限数量的系统提示词预设,分别同步到:

- Claude:

~/.claude/CLAUDE.md - Codex:

~/.codex/AGENTS.md - Gemini:

~/.gemini/GEMINI.md

支持智能回填,保留你手动修改的内容

✅ 配置安全保障

- 环境变量冲突检测:自动识别跨工具的密钥覆盖风险,提供解决建议

- 原子写入 + 回滚保护:配置更新失败时自动恢复

- 自动备份:保留最近 10 个配置版本,可随时回溯

架构升级:v3.8.0 的关键改进

最新版 CC Switch 迁移到 SQLite + JSON 双层存储架构:

- SQLite(

~/.cc-switch/cc-switch.db):存储可同步数据(供应商、MCP、Prompts、Skills),作为“单一事实源”(SSOT) - JSON(

~/.cc-switch/settings.json):存储设备级设置(窗口状态、本地路径) - 为云同步铺路:只需在设置中指定 Dropbox、OneDrive、iCloud 等同步目录,即可实现跨设备配置同步

此外,v3.8.0 还带来:

- 全新 UI:基于 Tailwind CSS 3.4 重构,提升浏览器兼容性

- 日语支持:现完整支持 中/英/日 三语

- 开机自启:通过平台原生 API(注册表/LaunchAgent/XDG)实现

- Skills 递归扫描:支持多层目录与同名技能共存

使用场景示例

场景 1:快速切换开发环境

- 前端项目:用 Claude Sonnet + Web Dev Skills

- 算法实验:切换到 Gemini Pro + Custom Prompt

- 本地调试:启用 Ollama via CCRouter + FileSystem MCP

只需点击托盘菜单,无需手动编辑任何文件。

场景 2:团队协作配置共享

- 通过

ccswitch:// 深度链接协议,分享预设供应商配置 - 新成员一键导入,确保环境一致

- 避免“在我机器上能跑”的配置差异

场景 3:安全实验新模型

- 创建“实验”供应商,配置自定义 API 端点

- 测试失败?直接删除,不影响主配置

- 所有修改均有备份,可随时还原

跨平台支持

| 平台 | 安装方式 |

|---|

| Windows | MSI 安装包 或 绿色版 ZIP |

| macOS | Homebrew (brew install --cask cc-switch) 或 手动解压 |

| Linux | DEB / RPM / AppImage / Flatpak 全格式支持 |

| Arch | paru -S cc-switch-bin |

macOS 首次运行需在“隐私与安全性”中手动允许(因无开发者签名)

技术亮点

- 前端:React + TypeScript + TanStack Query + shadcn/ui

- 后端:Tauri + Rust,确保本地安全与性能

- 测试:100% hooks 单元测试覆盖,集成 MSW 模拟 Tauri API

- 设计原则:SSOT、原子写入、并发安全、分层架构

适用人群

- 多 AI 用户:同时使用 Claude、Gemini、Codex 的开发者

- 配置管理者:希望标准化团队开发环境的 Tech Lead

- 本地模型探索者:通过自定义端点集成 Ollama、vLLM 等

- 效率追求者:拒绝重复配置,追求“一次设置,处处可用”