Anthropic 近期启动双重管控行动:一方面通过技术防护封杀伪装官方客户端的第三方工具,另一方面以商业条款为由,切断 xAI 等竞争对手对 Claude 模型的未授权访问。这一系列操作不仅冲击了 OpenCode 等开源工具用户的工作流,更折射出 AI 行业在商业模式与生态管控上的深层博弈。

技术封禁:针对第三方工具的“伪装攻防战”

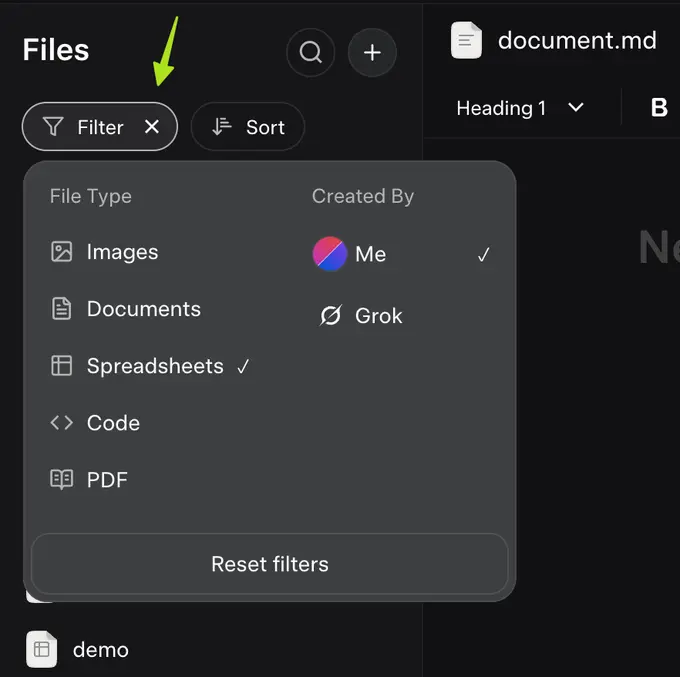

Anthropic 技术团队成员 Thariq Shihipar 于社交平台 X 澄清,公司已“强化对伪装 Claude Code 工具的防护”,明确针对通过 OAuth 驱动用户 Web 账户、实现自动化工作流的第三方软件包装器。这类工具的核心操作,是伪造请求头让 Anthropic 服务器误认为请求来自官方命令行界面(CLI),从而绕过官方限制。

此次防护措施虽针对性明确,却引发连带损害——部分合规用户账户因触发滥用过滤器被自动封禁,Anthropic 目前正逐步撤销这类误判封禁。但 Shihipar 强调,对第三方集成工具本身的阻止属于刻意行为,核心原因有二:

- 技术稳定性风险:未授权工具会引入 Anthropic 无法诊断的错误与异常使用模式,一旦出现问题,用户往往将责任归咎于 Claude 模型,损害平台信任度;

- 商业利益维护:这也是开发者社区热议的核心——第三方工具打破了官方速率限制,形成成本套利。

经济核心:“自助餐式订阅”的成本漏洞

Hacker News 上的讨论用“自助餐比喻”精准概括了矛盾点:Anthropic 个人订阅(Max 版 200 美元/月)提供“吃到饱”的服务,但通过官方 Claude Code 设定速率限制,控制 Token 消耗成本。而 OpenCode 等工具可移除该限制,让自主智能体执行整夜编码、测试、修复的高强度循环。

正如 Hacker News 用户 dfabulich 所指,这类自动化操作一个月消耗的 Token,若按 API 按量计费,成本可能超 1000 美元。Anthropic 此次封禁,本质是强制高流量自动化需求回归两条官方路径:一是按 Token 计费的商业 API,精准覆盖成本;二是官方托管的 Claude Code 环境,通过沙箱与速率限制掌控消耗。

社区反击:猫鼠游戏即刻上演

封禁消息一出,开发者社区反应两极。Ruby on Rails 框架创始人 David Heinemeier Hansson 直言“这对客户极不友好”,但也有声音表示理解——开发者 Artem K 称,Anthropic 仅打击滥用行为,未直接封禁账户或追溯收费,已是“相对温和的处理方式”。

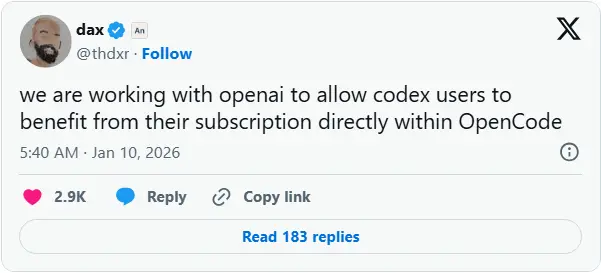

OpenCode 团队则迅速反击,推出每月 200 美元的高级版 OpenCode Black,宣称通过企业 API 网关路由流量绕过个人版 OAuth 限制;同时宣布与 OpenAI 合作,让 Codex 模型用户可直接在 OpenCode 中使用订阅权益,创始人更用《角斗士》的经典场景 GIF 表态,暗示这场攻防战将持续升级。

商业封禁:切断竞争对手的未授权访问通道

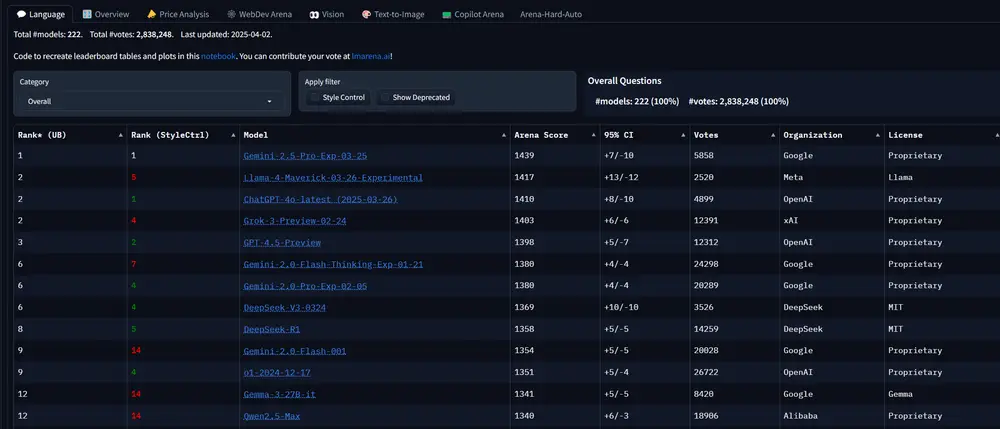

与第三方工具封禁并行的,是 Anthropic 对竞争对手的针对性限制——埃隆·马斯克旗下 xAI 实验室已失去对 Claude 模型的访问权限。这并非技术误伤,而是基于商业条款的独立执法行动,集成开发环境 Cursor 成为关键触发点。

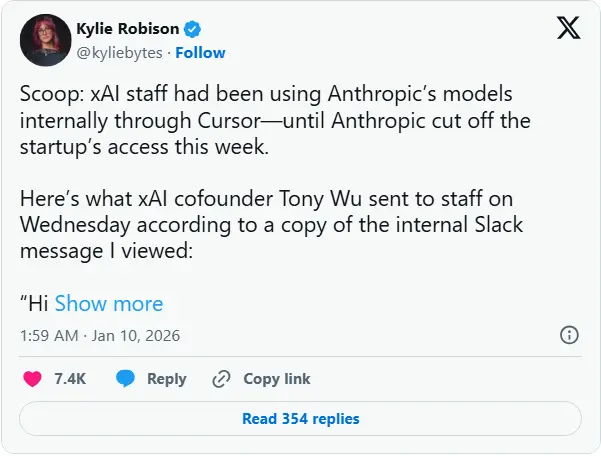

据科技记者 Kylie Robison 报道,xAI 员工长期通过 Cursor IDE 使用 Claude 模型加速自身开发,此举违反了 Anthropic 商业服务条款 D.4 节:明确禁止客户利用其服务“构建竞争性产品或服务(包括训练竞争 AI 模型)”或“逆向工程、复制服务”。xAI 联合创始人 Tony Wu 在内部备忘录中确认,Cursor 方面表示这是 Anthropic 针对所有主要竞争对手的新政策。

封禁先例:Anthropic 的生态管控惯性

此次双线打击并非孤例,Anthropic 自 2025 年起便逐步构建严格的生态管控体系,多次对违规行为采取断供措施:

- 2025年8月:断供 OpenAI:Anthropic 撤销 OpenAI 对 Claude API 的访问权限,理由是 OpenAI 利用 Claude 评估自身模型、测试安全响应,违反竞争限制条款;

- 2025年6月:限制 Windsurf:编程环境 Windsurf 收到不到一周的通知后,被切断对 Claude 3.x 模型的大部分第一方访问权限,被迫为免费用户切换至“自带密钥(BYOK)”模式,同时推广谷歌 Gemini 作为替代方案,直至数周后才为付费用户恢复访问。

这些案例共同勾勒出 Anthropic 的管控逻辑:允许工具与实验室共存,但一旦触及“威胁竞争优势”或“破坏商业模式”的红线,便会果断切断访问通道。

催化剂:Claude Code 的病毒式崛起与成本压力

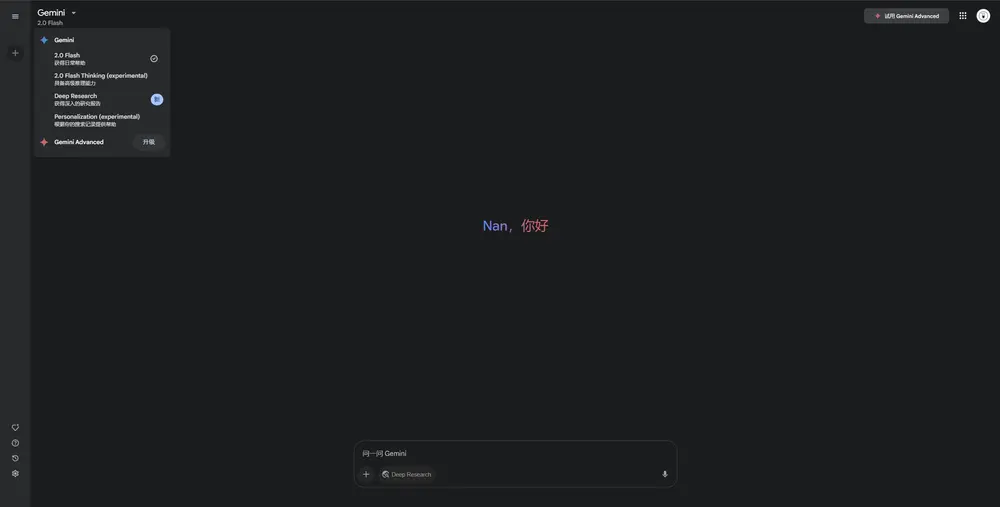

此次行动的时间点,与 Claude Code 的人气飙升高度契合。这款 2025 年初发布的原生终端工具,长期处于小众状态,直至 2025 年 12 月至 2026 年 1 月初,因社区“Ralph Wiggum”现象爆发式走红。

以《辛普森一家》角色命名的 Ralph Wiggum 插件,推行“暴力编码法”——将 Claude 困在自修复循环中,把失败反馈回上下文窗口,直至代码通过测试,这种方式能实现接近 AGI 的开发效果。而争议的核心并非 Claude Code 界面本身(不少高级用户认为其功能有限),而是其底层的 Claude Opus 4.5 模型。

第三方工具通过伪装客户端,让开发者以 200 美元/月的个人订阅价,无限使用企业级模型进行高强度自动化循环,本质是对定价体系的套利。Anthropic 的管控行动,正是为了将这种失控的需求拉回官方认可的合规渠道。

对企业开发者的核心启示

Anthropic 的双线打击,为依赖专有 AI 模型的企业开发者敲响警钟,带来三大关键提醒:

- 架构重构优先稳定性:未授权工具虽能节约成本,但存在不可控的封禁风险与技术漏洞,建议将自动化工作流迁移至官方 API 或 Claude Code 客户端,以稳定性换取生产环境保障;

- 预算模型迭代升级:需从固定月度订阅,转向按 Token 计费的可变预算模式,用财务可预测性替代短期成本节约;

- 排查“影子 AI”合规风险:安全主管需全面审计内部工具链,禁止通过个人账户、伪装 Token 访问竞品模型,避免因违规使用导致全组织访问权限突发中断。

相关文章