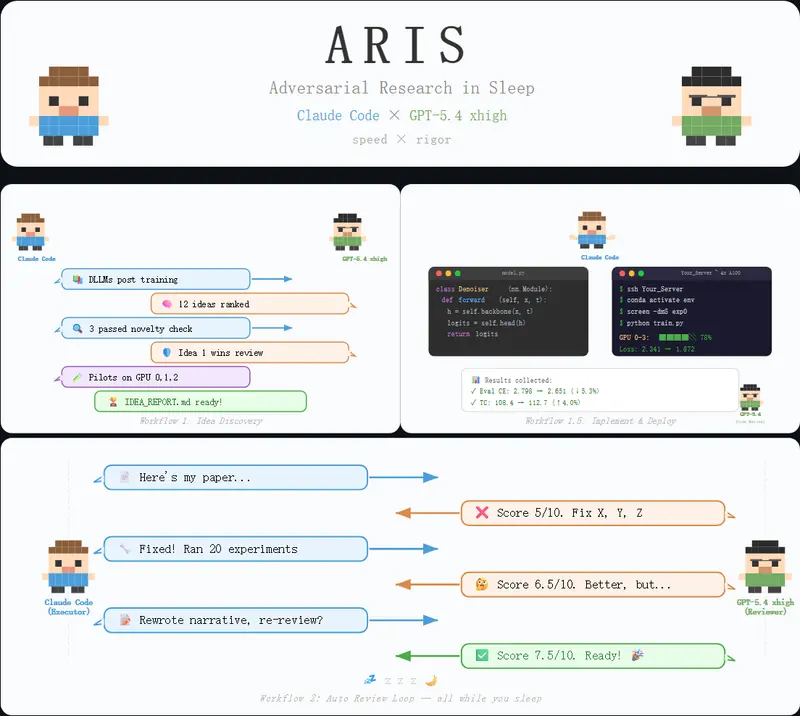

ARIS 是一套基于 Claude Code Skills 的自主机器学习科研工作流系统。它的核心理念极其简单却强大:“你睡觉,它科研”。

当你入睡时,ARIS 自动执行从文献调研、Idea 发现、代码实现、实验运行、论文撰写到 Rebuttal 回复的全流程。当你醒来,面对的是一份已被多轮“ adversarial(对抗式)”评审打磨过、实验数据详实、叙事逻辑严密的完整论文草稿。

核心哲学:跨模型对抗式协作

ARIS 拒绝单模型“自问自答”的自我博弈,因为它容易陷入局部最优和盲区。ARIS 采用了双模型对抗机制:

- 执行者 (Executor):通常由 Claude Code 担任。

- 特长:快速、丝滑地读取文件、编写代码、部署环境、运行实验、收集数据。

- 审稿人 (Reviewer):通常由 Codex (GPT-5.4 xhigh) 或 Gemini 担任。

- 特长:严谨、深入地发现逻辑漏洞、设计压力测试、提出尖锐的修改意见。

为什么是双模型?

这模拟了真实的学术同行评审(Peer Review)。执行者负责“攻”,审稿者负责“守”。这种 Adversarial Bandit(对抗性多臂老虎机) 模式比单模型的 Stochastic Bandit 更难被“欺骗”,能更有效地发现盲点,推动研究质量从Borderline Reject提升至Accept水平。

全链路工作流:从 Idea 到讲台

ARIS 将科研过程拆解为可自由组合的模块化 Skills,既支持全自动流水线,也支持按需调用。

1. Idea 发现与验证 (/idea-discovery)

- 输入:一个具体的研究方向(如“离散扩散语言模型的 factorized gap”)。

- 过程:

- 多源文献调研(Zotero, Obsidian, arXiv, Semantic Scholar)。

- 头脑风暴生成 8-12 个候选 Idea。

- 跨模型查新验证,剔除重复。

- 自动运行 GPU Pilot 实验进行初步可行性验证。

- 输出:带评分排序的 Idea 报告。

2. 实验桥接与执行 (/experiment-bridge)

- 功能:将选定的 Idea 转化为可运行的代码。

- 自动化:

- 克隆基础代码库 (

base repo)。 - 根据审稿意见自动编写消融实验脚本。

- 通过 SSH/Screen 远程部署到 GPU 服务器。

- 集成 W&B (Weights & Biases) 自动记录训练曲线。

- 实验完成后自动拉取结果并更新报告。

- 克隆基础代码库 (

3. 自动评审循环 (/auto-review-loop)

- 核心机制:执行 4 轮自主评审。

- Reviewer 打分并指出弱点(如“指标脱钩”、“声明不可复现”)。

- Executor 针对性修复代码、重跑实验、重写叙事。

- 效果:真实案例显示,可在无人干预下将论文评分从 5.0/10 提升至 7.5/10,期间自动运行 20+ 组 GPU 实验。

4. 论文写作与出版 (/paper-writing)

- 流程:研究叙事 → 大纲生成 → 图表绘制 (Gemini/Mermaid) → LaTeX 编译 → PDF 生成。

- 防幻觉:强制通过 DBLP/CrossRef 获取真实 BibTeX,杜绝虚假引用。

- 输出:符合目标会议(ICLR, NeurIPS, ICML 等)格式要求的完整论文。

5. Rebuttal 助手 (/rebuttal)

- 场景:收到审稿意见后。

- 功能:

- 解析每条意见,制定回复策略。

- 自动运行补充实验以回应质疑。

- 起草 PASTE_READY.txt (精确字数,可直接粘贴) 和 REBUTTAL_DRAFT_rich.md (详细版)。

- 三道安全门:不编造、不过度承诺、全覆盖。

6. 展示准备 (/paper-slides & /paper-poster)

- 一键生成:Beamer PDF, PPTX, 演讲稿,Q&A 预案,以及 A0/A1 海报。

极致轻量:零依赖,纯 Markdown

ARIS 不是一个沉重的平台,而是一套方法论。

- 零框架:没有复杂的 Python 包依赖,没有 Docker 容器,没有守护进程。

- 纯文本:每个 Skill 只是一个

SKILL.md文件。任何 LLM 都能读懂,任何支持 Custom Instructions/Skills 的 IDE (Claude Code, Cursor, Trae, Windsurf, Codex CLI) 都能运行。 - 可移植:Fork 仓库,复制

skills/文件夹到你的~/.claude/skills/,即刻生效。

支持的模型组合

虽然默认推荐 Claude Code (执行) + GPT-5.4 (审稿),但 ARIS 完全开放:

- 免费方案:MiniMax-M2.7 + GLM-5 (通过 ModelScope 接入)。

- 其他组合:Kimi, LongCat, DeepSeek 等任意支持 MCP 或 API 的模型。

- 角色互换:也可配置为 Codex 执行,Claude/Gemini 审稿。

快速开始

1. 安装 Skills

git clone https://github.com/wanshuiyin/Auto-claude-code-research-in-sleep.git

cp -r Auto-claude-code-research-in-sleep/skills/* ~/.claude/skills/

2. 配置审稿人 (以 Codex 为例)

npm install -g @openai/codex

codex setup # 选择 gpt-5.4 模型

claude mcp add codex -s user -- codex mcp-server

(注:需在 ~/.codex/config.toml 中确认 model = "gpt-5.4")

3. 启动全流程

在 Claude Code 中输入:

/research-pipeline "离散扩散语言模型的 factorized gap" — AUTO_PROCEED: false

AUTO_PROCEED: false:在 Idea 选择等关键节点暂停,让你人工确认,避免浪费 GPU 资源。human checkpoint: true:每轮评审后暂停,让你查看分数并给出额外指导。

真实效果案例

在某 ML 研究项目中,ARIS 自主运行了 4 轮循环:

| 轮次 | 评分 | 关键进展 |

|---|---|---|

| 初始 | 5.0/10 | Borderline Reject,逻辑薄弱 |

| 第 1 轮 | 6.5/10 | 补充标准指标,发现指标脱钩问题 |

| 第 2 轮 | 6.8/10 | 核心声明被证伪,被迫转换叙事方向 |

| 第 3 轮 | 7.0/10 | 大规模 Seed 研究推翻了原有改善声明 |

| 第 4 轮 | 7.5/10 ✅ | 诊断证据确立,叙事稳固,达到投稿标准 |

全程无人干预,自动运行 20+ 次 GPU 实验,彻底重构了论文逻辑。

高级特性

- 飞书集成:支持推送实验完成通知,甚至直接在飞书聊天窗口审批 Idea 或下达指令。

- 领域扩展:社区已贡献

dse-loop(体系结构/EDA) 等专用 Skill,欢迎提交 PR 扩展你的领域。 - 灵活参数:所有行为均可通过内联参数控制(如

sources: zotero, web,venue: CVPR,illustration: gemini)。

“科研的本质是探索未知,而不是重复劳动。”

把繁琐的代码调试、实验跑分和格式调整交给 ARIS,你只需要专注于那个最核心的 Idea。

数据统计

相关导航

Taste-Skill

Frontend Slides

Interface Design

Obsidian 可视化 Skills 套装

Claude-Mem

Paperclip

Awesome OpenClaw(Moltbot(Clawdbot)) Skills