Shiken

Shiken 是一款创新的 AI 学习平台,通过个性化和互动性工具增强学习体验。它适合个人学习者、教育机构和企业用户,提供从测验到课程的多种功能,帮助用户更高效地学习。

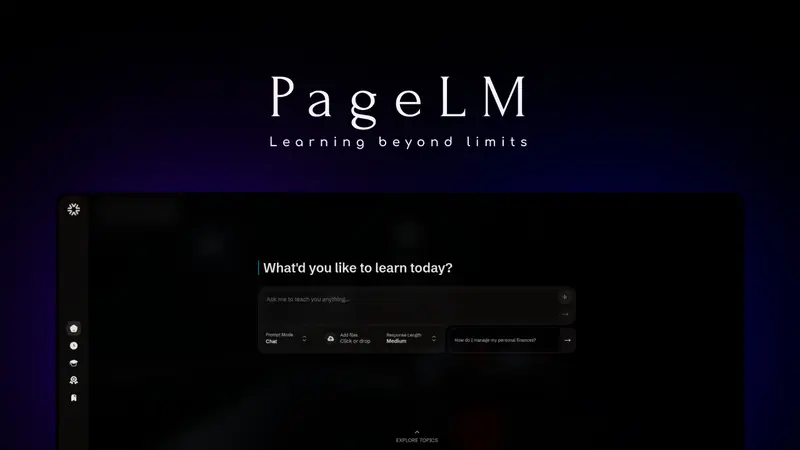

PageLM是一个开源的AI驱动教育平台,将学习材料转化为互动学习体验,灵感部分源自NotebookLM。PageLM 将学习材料转换为互动资源,包括测验、闪卡、结构化笔记和播客。该平台为学生、教育者和研究人员提供了一个现代化界面,利用最先进的LLM和TTS系统来提升学习效率。

PageLM 是一个开源的 AI 驱动教育平台,能将你上传的学习资料(如 PDF、Word、Markdown 等)自动转化为多种互动学习资源。它的设计思路部分受到 Google NotebookLM 的启发,但更注重功能扩展和本地部署能力,适合学生、教师和研究人员自主搭建、私有化使用。

PageLM 不只是“问答机器人”,它提供一整套学习辅助工具链:

这些功能全部围绕“将静态材料转化为动态学习体验”展开,不依赖单一模型,强调实用性与可组合性。

PageLM 支持多种主流大模型和本地部署选项:

你可以根据隐私需求、成本或性能,在 .env 配置文件中自由切换后端服务。例如,敏感资料可完全使用本地 Ollama 模型处理,不上传任何数据。

| 模块 | 技术选型 |

|---|---|

| 后端 | Node.js + TypeScript,基于 LangChain 与 LangGraph 构建 |

| 前端 | Vite + React + TailwindCSS,响应式界面 |

| 数据存储 | 默认使用 JSON 文件(无需数据库),可选向量数据库(如 Chroma、Pinecone) |

| 音频合成 | Edge TTS、Google TTS、ElevenLabs(需 API) |

| 文档解析 | pdf-lib、mammoth(处理 Word)、pdf-parse |

| 部署 | 支持 Docker 一键部署,也支持本地开发运行 |

git clone https://github.com/caviraOSS/pagelm.git

cd pagelm

# Linux 用户

chmod 777 ./setup.sh && ./setup.sh

# Windows 用户(需先设置执行策略)

Set-ExecutionPolicy -ExecutionPolicy RemoteSigned -Scope CurrentUser

./setup.ps1

# 或手动安装

cd backend && npm install

cd ../frontend && npm install

cp .env.example .env # 配置你的 API 密钥

分别在两个终端运行:

# 后端

cd backend && npm run dev

# 前端

cd frontend && npm run dev

访问 http://localhost:5173 即可开始使用。

# 开发模式

docker compose up --build

# 生产模式(后台运行)

docker compose -f docker-compose.yml -f docker-compose.prod.yml up -d --build

前端服务端口:5173(开发) / 8080(生产)

后端 API 端口:5000

所有功能均可通过环境变量精细控制:

生成的内容默认以文件形式持久化存储在本地,不依赖第三方云服务,适合对数据隐私有要求的用户。