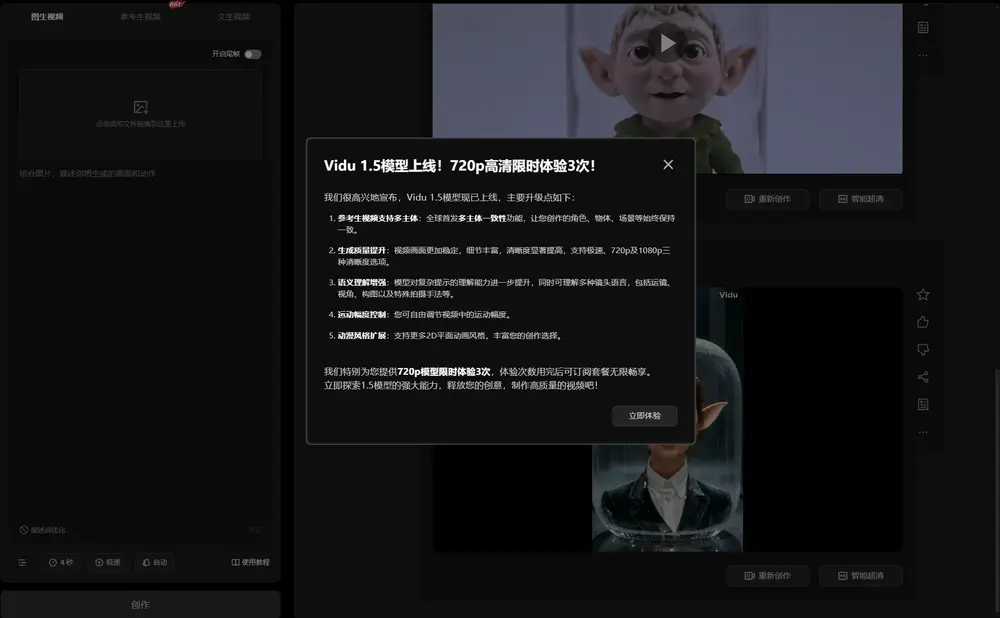

生数科技旗下的文生视频大模型 Vidu 宣布,Vidu 1.5 新版本正式上线。这一版本实现了“世界领先水平”的突破,能够理解多样化的输入,突破了“一致性”的难题。Vidu 在上线之初就具备角色一致性生成能力,通过锁定人物面部特征解决了视频生成的关键痛点。此次更新中,Vidu 首次展现了上下文学习的能力,提升了整体视频模型的可控性,通过灵活的多元输入实现了多角度、多主体、多元素的一致性生成。

技术突破

Vidu 1.5 在以下几个方面直观呈现了“技术突破”:

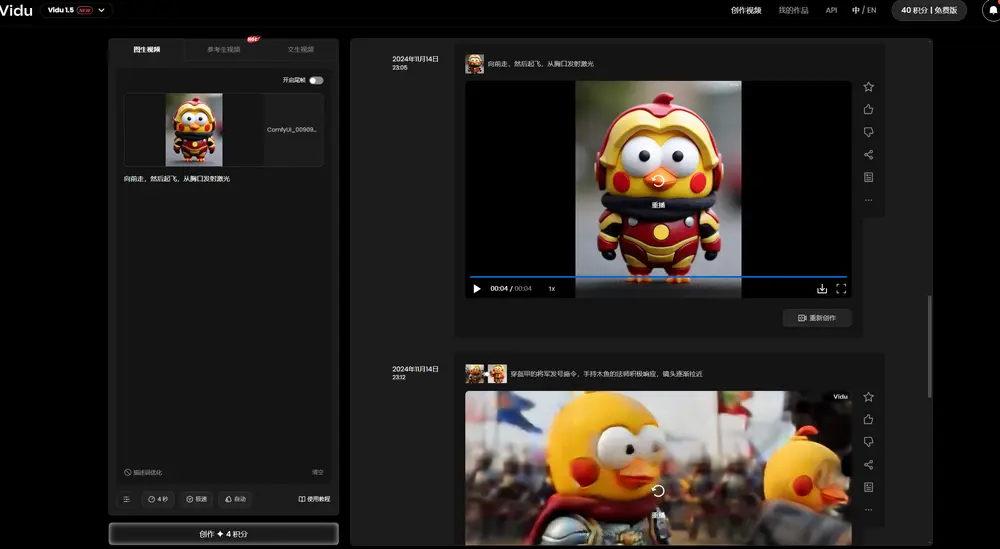

1、复杂主体的精准控制

-

多视角一致性:无论是细节丰富的角色,还是复杂的物体,Vidu 都能确保其在多个不同视角下的一致性。例如,对于造型复杂的 3D 动画风格角色,无论视角如何变化,Vidu 都能始终确保头型、服饰的全角度细节一致,避免了传统视频模型在复杂视角切换时产生的瑕疵。

2、人物面部特征和动态表情的自然一致

-

特写镜头中的连贯性:在人物特写镜头中,Vidu 能够自然且流畅地保持人物面部特征和表情的连贯性,避免了面部僵硬或失真的现象。这使得生成的视频更加自然和真实。

3、多主体一致性

-

多元素交互:用户可以上传多个主题图像,包括人物角色、道具物体、环境背景等,并在视频生成中实现这些元素的交互。例如,用户可以上传主体、客体和环境的图片,创建定制角色身穿特定服装、在定制空间内自由动作的场景。这为用户提供了更高的创作自由度和灵活性。

用户体验

-

多样化输入:用户可以通过文字、图片等多种形式输入内容,Vidu 能够理解和生成高质量的视频。 -

高度可控性:用户可以灵活控制视频中的各个元素,确保生成的视频符合预期。 -

自然流畅:生成的视频在人物面部特征、表情和动作等方面表现自然,提高了观看体验。

评论0