Fellou - 最新版

Fellou 是全球首款智能体浏览器,旨在成为用户的数字伙伴。它不仅能浏览网页,还能自动执行复杂任务,如总结文章、安排会议或发布社交媒体内容。研究表明,它通过深度搜索和 AI 驱动的自动化,帮助用户更高效地处理信息。

在本地运行大语言模型(LLM)时,你是否常面临这样的困惑:

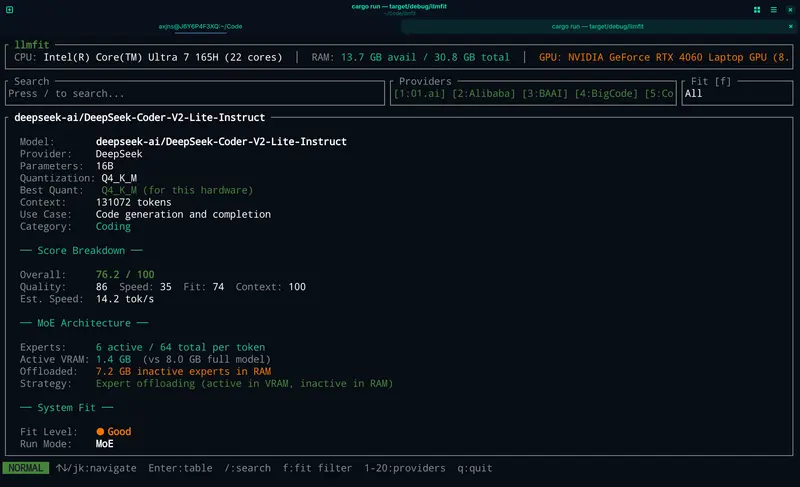

手动计算显存需求、查阅评测、尝试不同量化版本不仅耗时,还容易出错。llmfit 是一款专为终端打造的智能工具,它能自动检测你的 CPU、RAM 和 GPU 配置,从全球 206 个热门模型(涵盖 57 个提供商)中,精准筛选出能在你机器上完美运行的模型,并给出速度与质量的最佳平衡建议。

llmfit 不仅仅是看显存大小。它通过 sysinfo 和底层工具深入探测你的系统:

每个模型都会经过严苛的四维评估,生成综合推荐分:

d 键调用 Ollama 下载,无需切换窗口。已安装的模型会自动标记绿色对勾。

最简单的方式是一键安装脚本:

curl -fsSL https://llmfit.axjns.dev/install.sh | sh

或者使用 Homebrew:

brew tap AlexsJones/llmfit

brew install llmfit

如果你已安装 Rust 环境:

cargo install llmfit

Windows 用户也可从 GitHub Releases 下载预编译的二进制文件。

直接在终端输入:

llmfit

你将看到一个按综合分数排序的模型列表。顶部显示你的硬件概览(CPU、RAM、GPU、VRAM)。

常用快捷键:

/:搜索模型(支持名称、提供商、参数量)。f:切换适配度过滤器(只看“完美”运行的模型)。d:下载选中模型到 Ollama。t:切换颜色主题。Enter:查看模型详细信息(量化建议、预计显存占用、速度估算)。llmfit --memory=24G

# 获取前 3 个最适合编程的模型(JSON 格式)

llmfit recommend --json --use-case coding --limit 3

llmfit-advisor。安装后,你可以直接问你的 AI 助手:“帮我选一个适合写代码的本地模型”,它会自动调用 llmfit 分析硬件并配置好 Ollama。llmfit 的强大源于其严谨的计算逻辑:

tok/s,让你对运行速度有心理预期。