AutoResearchClaw 是一款革命性的开源科研自动化框架,基于 OpenClaw 构建。它彻底改变了传统科研流程,让用户只需输入一个研究灵感(如“研究 X”),即可全自动完成从文献调研、假设生成、代码实验、数据分析到论文撰写的全过程,最终交付一篇符合 NeurIPS/ICML/ICLR 等顶会标准的完整学术论文。

只需与 OpenClaw 对话:“研究 X”,剩下的交给系统

pip install -e . && researchclaw setup && researchclaw init && \

researchclaw run --topic "Your research idea here" --auto-approve

这是什么?

你提供一个灵感,AutoResearchClaw 将其转化为完整的学术成果。

输入一个研究主题,系统将自动输出一篇结构严谨的学术论文。它不仅仅是文本生成,更是一个具备真实文献检索、硬件感知沙箱实验、统计分析、多 Agent 同行评审以及顶会级 LaTeX 排版能力的完整科研智能体。

- 无需时刻盯着屏幕

- 无需手动复制粘贴数据

- 杜绝幻觉引用与伪造数据

交付物清单

运行结束后,你将在 deliverables/ 文件夹中获得所有可立即使用的成果:

| 文件/目录 | 内容描述 |

|---|---|

📄 paper_draft.md | 完整学术论文草稿(含引言、相关工作、方法、实验、结果、结论) |

📐 paper.tex | 适配顶会模板的 LaTeX 源码(支持 NeurIPS / ICLR / ICML) |

📚 references.bib | 来自 OpenAlex、Semantic Scholar 和 arXiv 的真实 BibTeX 引用,自动精简至与正文一致 |

🔍 verification_report.json | 四层引用完整性核查报告(arXiv ID + CrossRef/DataCite DOI + 标题匹配 + LLM 相关性评分) |

🧪 experiment_runs/ | 生成的实验代码、沙箱运行日志及结构化 JSON 指标 |

📊 charts/ | 自动生成的对比图表(含误差线与置信区间) |

📝 reviews.md | 多 Agent 同行评审报告(包含方法论与证据一致性检查) |

🧬 evolution/ | 从本次运行中提取的自学习教训,用于优化未来任务 |

📦 deliverables/ | 最终产出汇总,可直接上传 Overleaf 编译或提交期刊 |

全流程端到端自动化: 实验失败自动修复,假设不成立自主转向,发现引用造假自动剔除。

快速开始

1. 克隆与安装

git clone https://github.com/aiming-lab/AutoResearchClaw.git

cd AutoResearchClaw

python3 -m venv .venv && source .venv/bin/activate

pip install -e .

2. 初始化环境

交互式安装 OpenCode Beast Mode,自动检查 Docker 与 LaTeX 环境依赖。

researchclaw setup

3. 配置项目

交互式选择 LLM 提供商并生成配置文件,或手动复制示例配置。

researchclaw init

# 或手动:cp config.researchclaw.example.yaml config.arc.yaml

4. 启动研究

export OPENAI_API_KEY="sk-..."

researchclaw run --config config.arc.yaml --topic "Your research idea" --auto-approve

输出路径: artifacts/rc-YYYYMMDD-HHMMSS-<hash>/deliverables/

此处包含所有可编译的 LaTeX 文件、BibTeX 库、实验代码及图表。

⚙️ 最小必要配置 (config.arc.yaml)

project:

name: "my-research"

research:

topic: "Your research topic here"

llm:

base_url: "https://api.openai.com/v1"

api_key_env: "OPENAI_API_KEY"

primary_model: "gpt-4o"

fallback_models: ["gpt-4o-mini"]

experiment:

mode: "sandbox"

sandbox:

python_path: ".venv/bin/python"

核心差异化能力

AutoResearchClaw 并非简单的文本生成器,它内置了复杂的科研逻辑引擎:

| 能力模块 | 工作原理与价值 |

|---|---|

| 🔄 PIVOT / REFINE 循环 | 在第 15 阶段具备自主决策权:根据实验结果选择 PROCEED (继续)、REFINE (调参优化) 或 PIVOT (转换方向)。所有产物自动版本化,确保可追溯。 |

| 🤖 多 Agent 辩论机制 | 在假设生成、结果分析及同行评审阶段,引入结构化多视角辩论,避免单一模型偏见,提升结论可靠性。 |

| 🧬 自学习进化系统 | 每次运行自动提取教训(决策理由、运行时警告、指标异常),采用 30 天时间衰减机制。后续运行将从历史错误中学习,避免重蹈覆辙。 |

| 📚 结构化知识库 | 自动构建涵盖决策、实验、发现、文献、问题、评审六大类别的结构化知识库,沉淀科研资产。 |

| 🛡️ Sentinel 看门狗 | 后台实时质量监控:检测 NaN/Inf 异常、校验论文与证据的一致性、评估引用相关性、部署反数据捏造守卫。 |

深度集成 OpenClaw

AutoResearchClaw 是 OpenClaw 兼容服务。既可作为独立 CLI 工具运行,也可无缝嵌入 OpenClaw 生态,实现“一句话科研”。

🚀 推荐用法:通过 OpenClaw 调用

如果你已在使用 OpenClaw 作为 AI 助手:

- 将 GitHub 仓库地址分享给 OpenClaw。

- OpenClaw 自动读取

RESEARCHCLAW_AGENTS.md,理解流水线编排逻辑。 - 直接指令:“帮我研究 [你的主题]”。

- 完成 — OpenClaw 自动执行克隆、安装、配置、运行,并返回最终论文。

底层流程透明化:

- OpenClaw 解析 Agent 角色与流水线结构。

- 自动复制并配置

config.yaml。 - 调用 LLM API(支持环境变量或交互式输入)。

- 执行

pip install与researchclaw run。 - 交付论文、LaTeX 源码及实验数据。

🔌 OpenClaw Bridge 高级扩展

内置 Bridge 适配器系统,通过配置文件即可激活 6 种集成能力,无需修改代码:

# config.arc.yaml

openclaw_bridge:

use_cron: true # ⏰ 定时研究任务

use_message: true # 💬 进度通知 (Discord/Slack/Telegram)

use_memory: true # 🧠 跨会话知识持久化

use_sessions_spawn: true # 🔀 为并行阶段派生子会话

use_web_fetch: true # 🌐 文献检索中的实时网络搜索

use_browser: false # 🖥️ 基于浏览器的深度论文采集

每个标志激活一个类型化适配器协议。当 OpenClaw 提供对应能力时,适配器自动消费,实现功能无缝扩展。

🔌 灵活的后端支持:ACP (Agent Client Protocol)

AutoResearchClaw 支持使用任何 ACP 兼容的编码 Agent 作为 LLM 后端,无需配置 API Key。Agent 通过 acpx 通信,在全部 23 个流水线阶段中维持单个持久会话。

| Agent | 命令 | 提供商 |

|---|---|---|

| Claude Code | claude | Anthropic |

| Codex CLI | codex | OpenAI |

| Copilot CLI | gh | GitHub |

| Gemini CLI | gemini | |

| OpenCode | opencode | SST |

| Kimi CLI | kimi | Moonshot |

配置示例:

# config.yaml

llm:

provider: "acp"

acp:

agent: "claude" # 任意 ACP 兼容命令

cwd: "." # 工作目录

# 无需 base_url 或 api_key,Agent 自行处理认证

运行方式多样化:

- 独立 CLI:

researchclaw run --topic "..." --auto-approve - Python API:

from researchclaw.pipeline import Runner; Runner(config).run() - Claude Code/Copilot: 读取上下文文件后直接自然语言交互。

- 任意 AI CLI: 提供

RESEARCHCLAW_AGENTS.md作为上下文,自动引导执行。

🔬 23 阶段科研流水线详解

整个流程被拆解为 8 个阶段组,共 23 个精细步骤,确保科研严谨性。

流程全景图

- 阶段组 A:研究定义

1. TOPIC_INIT: 主题初始化2. PROBLEM_DECOMPOSE: 问题树分解- (+) 硬件检测: 自动识别 GPU (NVIDIA CUDA / Apple MPS) 或 CPU,动态调整代码策略。

- 阶段组 B:文献发现

3. SEARCH_STRATEGY: 搜索策略制定4. LITERATURE_COLLECT: 真实 API 多源采集 (OpenAlex → Semantic Scholar → arXiv)5. LITERATURE_SCREEN: [门控] 相关性筛选6. KNOWLEDGE_EXTRACT: 知识卡片提取

- 阶段组 C:知识综合

7. SYNTHESIS: 研究发现聚类8. HYPOTHESIS_GEN: 多 Agent 辩论 生成可验证假设

- 阶段组 D:实验设计

9. EXPERIMENT_DESIGN: [门控] 方案设计10. CODE_GENERATION: 硬件感知代码生成11. RESOURCE_PLANNING: 资源需求估算

- 阶段组 E:实验执行

12. EXPERIMENT_RUN: 沙箱执行13. ITERATIVE_REFINE: 自修复 循环 (检测 NaN/Inf,定向修复)

- 阶段组 F:分析与决策

14. RESULT_ANALYSIS: 多 Agent 结果分析15. RESEARCH_DECISION: PIVOT/REFINE 自主决策点

- 阶段组 G:论文撰写

16. PAPER_OUTLINE: 大纲构建17. PAPER_DRAFT: 分段撰写 (5,000-6,500 词)18. PEER_REVIEW: 证据审查 同行评审19. PAPER_REVISION: 带长度保障的修订

- 阶段组 H:终稿发布

20. QUALITY_GATE: [门控] 最终质量验收21. KNOWLEDGE_ARCHIVE: 知识归档22. EXPORT_PUBLISH: LaTeX 导出 (顶会模板)23. CITATION_VERIFY: 相关性审查 与幻觉清洗

注: 门控阶段(5、9、20)默认暂停等待人工审批,可通过

--auto-approve跳过。若审批拒绝,流水线自动回滚。

决策循环: 第 15 阶段可根据结果触发REFINE(返回第 13 阶段) 或PIVOT(返回第 8 阶段),并自动版本化旧产物。

✨ 关键功能亮点

- 📚 多源真实文献: 集成 OpenAlex、Semantic Scholar 和 arXiv API,具备查询扩展、去重及三态熔断器机制,优雅降级,确保文献真实性。

- 🔍 四层引用核查:

arXiv ID→CrossRef/DataCite DOI→Semantic Scholar 标题→LLM 相关性评分。发现幻觉引用自动删除,确保学术诚信。 - 🖥️ 硬件感知执行: 自动检测本地算力(NVIDIA/Apple/CPU),据此动态调整依赖包、Import 语句及实验规模,最大化资源利用率。

- 🦾 OpenCode Beast Mode: 复杂实验自动路由至

OpenCode,生成包含自定义架构、训练循环和消融实验的多文件项目。 - 🧪 沙箱实验环境: 基于 AST 的代码验证、不可变 Harness、NaN/Inf 快速失败机制、自修复循环(最多 10 轮)及部分结果捕获。

- 📝 顶会级写作标准: 原生支持 NeurIPS/ICML/ICLR 模板,分段撰写长文,内置反数据捏造守卫与修订长度保障。

- 📐 模板灵活切换: 支持

neurips_2025,iclr_2026,icml_2026等模板,完美处理数学公式、表格、图片交叉引用及\cite{}。 - 🚦 严格质量门控: 设置 3 个人工审批节点,支持全流程回滚,确保关键决策可控。

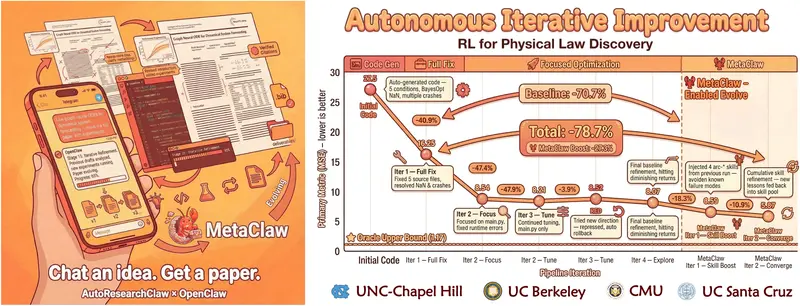

🧠 MetaClaw 集成:让系统越用越聪明

AutoResearchClaw + MetaClaw = 具备记忆与进化能力的科研流水线。

启用 MetaClaw 后,系统能将每次运行的失败与警告转化为可复用的“技能”,并在后续任务中自动注入,实现跨运行的知识迁移。

工作原理

- 运行 N 执行 → 捕获失败/警告为

Lessons。 - 转化 → MetaClaw 将 Lesson 转换为

Skill。 - 存储 →

arc-*技能文件存入~/.metaclaw/skills/。 - 运行 N+1 →

build_overlay()将技能注入每个 LLM 提示。 - 结果 → LLM 规避已知陷阱,重试率降低,产出质量提升。

快速配置

# config.arc.yaml

metaclaw_bridge:

enabled: true

proxy_url: "http://localhost:30000" # MetaClaw 代理 (可选)

skills_dir: "~/.metaclaw/skills" # 技能存储位置

lesson_to_skill:

enabled: true

min_severity: "warning" # 转换 warning 及以上级别

max_skills_per_run: 3

📊 实测效果 (A/B 测试)

在相同主题、模型与配置下的对照实验显示:

| 指标 | 基线 | 启用 MetaClaw | 改善幅度 |

|---|---|---|---|

| 阶段重试率 | 10.5% | 7.9% | -24.8% |

| Refine 循环次数 | 2.0 | 1.2 | -40.0% |

| 流水线完成率 | 18/19 | 19/19 | +5.3% |

| 综合鲁棒性得分 | 0.714 | 0.845 | +18.3% |

> 综合鲁棒性得分由阶段完成率 (40%)、重试减少 (30%) 和 Refine 效率 (30%) 加权计算。

向后兼容性保证:

- 默认关闭: 若未配置

metaclaw_bridge,行为与旧版本完全一致。 - 无新依赖: MetaClaw 为可选组件,核心流水线独立运行不受影响。

- 测试通过: 所有 1,634 项现有测试(含集成代码)均通过验证。

数据统计

相关导航

StepClaw

AstronClaw

Codebase to Course

OpenMAIC

Star Office UI

MaxClaw

新Follow Builders, Not Influencers